【Datawhale动手学数据分析笔记】第五章 数据建模及评估

【摘要】 数据建模及模型评估 环境配置#引入包import pandas as pdimport numpy as npimport seaborn as snsimport matplotlib.pyplot as pltfrom IPython.display import Image#设置mathplotlib参数%matplotlib inlineplt.rcParams['font.san...

数据建模及模型评估

环境配置

#引入包

import pandas as pd

import numpy as np

import seaborn as sns

import matplotlib.pyplot as plt

from IPython.display import Image

#设置mathplotlib参数

%matplotlib inline

plt.rcParams['font.sans-serif'] = ['SimHei'] # 用来正常显示中文标签

plt.rcParams['axes.unicode_minus'] = False # 用来正常显示负号

plt.rcParams['figure.figsize'] = (10, 6) # 设置输出图片大小

#读取数据集

train = pd.read_csv('train_chinese.csv')

train.shape

结果:(891, 12)

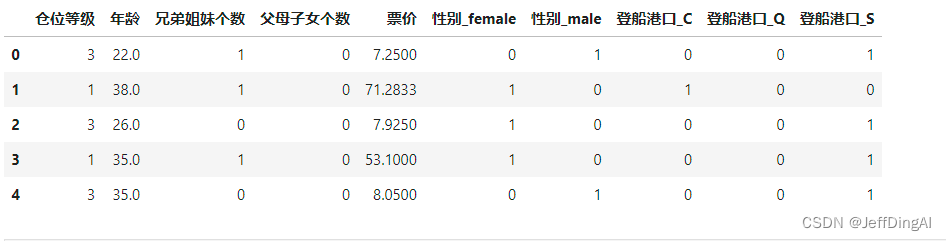

train.head()

运行结果:

特征工程

缺失值填充

- 对分类变量缺失值:填充某个缺失值字符(NA)、用最多类别的进行填充

- 对连续变量缺失值:填充均值、中位数、众数

# 对分类变量进行填充

train['客舱'] = train['客舱'].fillna('NA')

train['登船港口'] = train['登船港口'].fillna('S')

# 对连续变量进行填充

train['年龄'] = train['年龄'].fillna(train['年龄'].mean())

# 检查缺失值比例

train.isnull().sum().sort_values(ascending=False)

运行结果:

乘客ID 0

是否幸存 0

仓位等级 0

姓名 0

性别 0

年龄 0

兄弟姐妹个数 0

父母子女个数 0

船票信息 0

票价 0

客舱 0

登船港口 0

dtype: int64

编码分类变量

# 取出所有的输入特征

data = train[['仓位等级','性别','年龄','兄弟姐妹个数','父母子女个数','票价', '登船港口']]

# 进行虚拟变量转换

data = pd.get_dummies(data)

data.head()

运行结果:

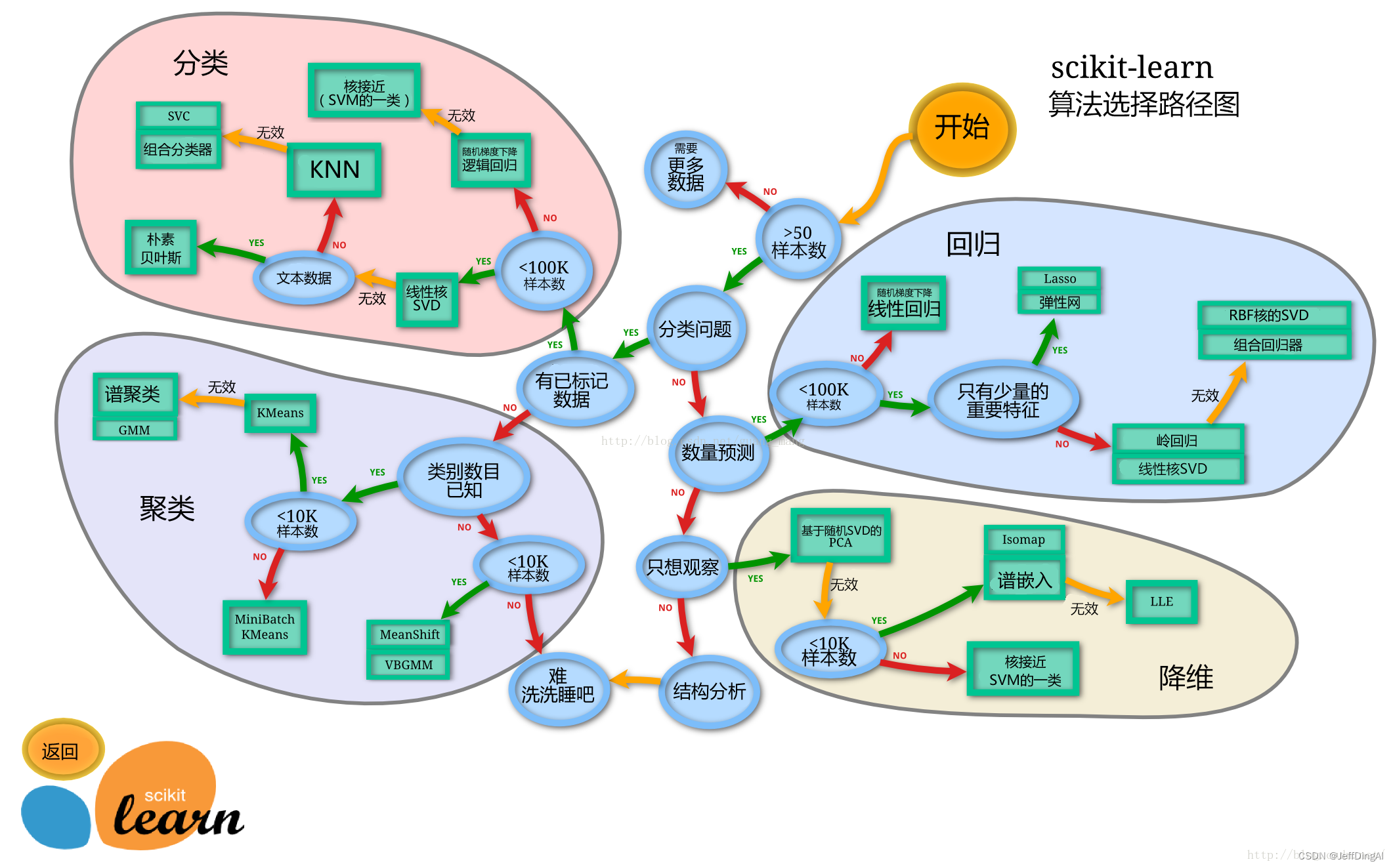

模型搭建

- 处理完前面的数据我们就得到建模数据,下一步是选择合适模型

- 在进行模型选择之前我们需要先知道数据集最终是进行监督学习还是无监督学习

- 除了根据我们任务来选择模型外,还可以根据数据样本量以及特征的稀疏性来决定

- 刚开始我们总是先尝试使用一个基本的模型来作为其baseline,进而再训练其他模型做对比,最终选择泛化能力或性能比较好的模型

sklearn模型算法选择路径图

切割训练集和测试集

- 按比例切割训练集和测试集(一般测试集的比例有30%、25%、20%、15%和10%)

- 按目标变量分层进行等比切割

- 设置随机种子以便结果能复现

提示

- 切割数据集是为了后续能评估模型泛化能力

- sklearn中切割数据集的方法为

train_test_split - 查看函数文档可以在jupyter noteboo里面使用

train_test_split?后回车即可看到 - 分层和随机种子在参数里寻找

from sklearn.model_selection import train_test_split

# 一般先取出X和y后再切割,有些情况会使用到未切割的,这时候X和y就可以用

X = data

y = train['是否幸存']

# 对数据集进行切割

X_train, X_test, y_train, y_test = train_test_split(X, y, stratify=y, random_state=0)

# 查看数据形状

X_train.shape, X_test.shape

运行结果:((668, 10), (223, 10))

模型创建

- 创建基于线性模型的分类模型(逻辑回归)

- 创建基于树的分类模型(决策树、随机森林)

- 查看模型的参数,并更改参数值,观察模型变化

提示

- 逻辑回归不是回归模型而是分类模型,不要与

LinearRegression混淆 - 随机森林其实是决策树集成为了降低决策树过拟合的情况

- 线性模型所在的模块为

sklearn.linear_model - 树模型所在的模块为

sklearn.ensemble

from sklearn.linear_model import LogisticRegression

from sklearn.ensemble import RandomForestClassifier

# 默认参数逻辑回归模型

lr = LogisticRegression()

lr.fit(X_train, y_train)

# 查看训练集和测试集score值

print("默认参数逻辑回归模型")

print("Training set score: {:.2f}".format(lr.score(X_train, y_train)))

print("Testing set score: {:.2f}".format(lr.score(X_test, y_test)))

# 调整参数后的逻辑回归模型

lr2 = LogisticRegression(C=100)

lr2.fit(X_train, y_train)

print("调整参数后的逻辑回归模型")

print("Training set score: {:.2f}".format(lr2.score(X_train, y_train)))

print("Testing set score: {:.2f}".format(lr2.score(X_test, y_test)))

# 默认参数的随机森林分类模型

rfc = RandomForestClassifier()

rfc.fit(X_train, y_train)

print("默认参数的随机森林分类模型")

print("Training set score: {:.2f}".format(rfc.score(X_train, y_train)))

print("Testing set score: {:.2f}".format(rfc.score(X_test, y_test)))

# 调整参数后的随机森林分类模型

rfc2 = RandomForestClassifier(n_estimators=100, max_depth=5)

rfc2.fit(X_train, y_train)

print("调整参数后的随机森林分类模型")

print("Training set score: {:.2f}".format(rfc2.score(X_train, y_train)))

print("Testing set score: {:.2f}".format(rfc2.score(X_test, y_test)))

运行结果:

默认参数逻辑回归模型

Training set score: 0.80

Testing set score: 0.78

调整参数后的逻辑回归模型

Training set score: 0.81

Testing set score: 0.78

默认参数的随机森林分类模型

Training set score: 0.99

Testing set score: 0.82

调整参数后的随机森林分类模型

Training set score: 0.86

Testing set score: 0.83

输出模型预测结果

- 输出模型预测分类标签

- 输出不通分类标签的预测概率

提示

- 一般监督模型在sklearn里面有个

predict能输出预测标签,predict_proba则可以输出标签概率

# 预测标签

pred = lr.predict(X_train)

# 此时我们可以看到0和1的数组

pred[:10]

# 预测标签概率

pred_proba = lr.predict_proba(X_train)

pred_proba[:10]

运行结果:

array([[0.61850002, 0.38149998],

[0.13850617, 0.86149383],

[0.462075 , 0.537925 ],

[0.19167532, 0.80832468],

[0.86645856, 0.13354144],

[0.90891554, 0.09108446],

[0.12699159, 0.87300841],

[0.90464646, 0.09535354],

[0.04934116, 0.95065884],

[0.12648267, 0.87351733]]

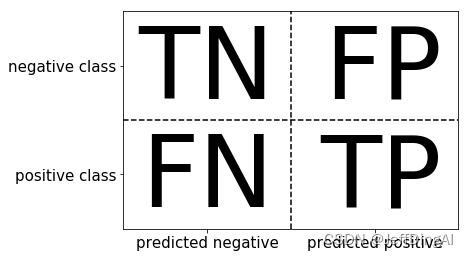

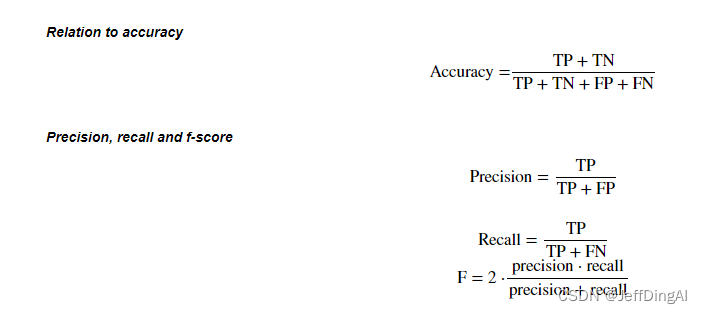

模型评估

- 模型评估是为了知道模型的泛化能力。

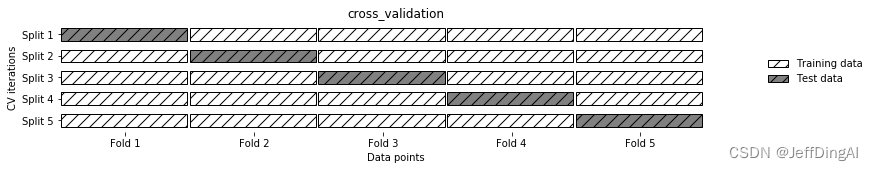

- 交叉验证(cross-validation)是一种评估泛化性能的统计学方法,它比单次划分训练集和测试集的方法更加稳定、全面。

- 在交叉验证中,数据被多次划分,并且需要训练多个模型。

- 最常用的交叉验证是 k 折交叉验证(k-fold cross-validation),其中 k 是由用户指定的数字,通常取 5 或 10。

- 准确率(precision)度量的是被预测为正例的样本中有多少是真正的正例

- 召回率(recall)度量的是正类样本中有多少被预测为正类

- f-分数是准确率与召回率的调和平均

交叉验证

- 用10折交叉验证来评估逻辑回归模型

- 计算交叉验证精度的平均值

提示

- 交叉验证在sklearn中的模块为

sklearn.model_selection

from sklearn.model_selection import cross_val_score

lr = LogisticRegression(C=100)

scores = cross_val_score(lr, X_train, y_train, cv=10)

# k折交叉验证分数

print(scores)

# 平均交叉验证分数

print("Average cross-validation score: {:.2f}".format(scores.mean()))

运行结果:

[0.82089552 0.7761194 0.82089552 0.79104478 0.85074627 0.86567164

0.73134328 0.86567164 0.75757576 0.6969697 ]

Average cross-validation score: 0.80

混淆矩阵

- 计算二分类问题的混淆矩阵

- 计算精确率、召回率以及f-分数

提示

- 混淆矩阵的方法在sklearn中的

sklearn.metrics模块 - 混淆矩阵需要输入真实标签和预测标签

from sklearn.metrics import confusion_matrix

# 训练模型

lr = LogisticRegression(C=100)

lr.fit(X_train, y_train)

# 模型预测结果

pred = lr.predict(X_train)

# 混淆矩阵

confusion_matrix(y_train, pred)

from sklearn.metrics import classification_report

# 精确率、召回率以及f1-score

print(classification_report(y_train, pred))

运行结果:

precision recall f1-score support

0 0.83 0.86 0.84 412

1 0.76 0.72 0.74 256

accuracy 0.81 668

macro avg 0.80 0.79 0.79 668

weighted avg 0.80 0.81 0.80 668

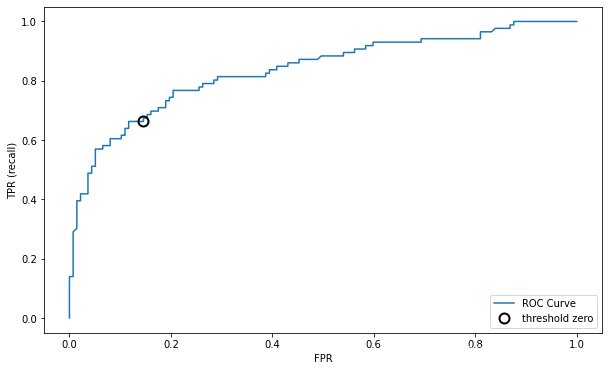

ROC曲线

- 绘制ROC曲线

提示

- ROC曲线在sklearn中的模块为

sklearn.metrics - ROC曲线下面所包围的面积越大越好

from sklearn.metrics import roc_curve

fpr, tpr, thresholds = roc_curve(y_test, lr.decision_function(X_test))

plt.plot(fpr, tpr, label="ROC Curve")

plt.xlabel("FPR")

plt.ylabel("TPR (recall)")

# 找到最接近于0的阈值

close_zero = np.argmin(np.abs(thresholds))

plt.plot(fpr[close_zero], tpr[close_zero], 'o', markersize=10, label="threshold zero", fillstyle="none", c='k', mew=2)

plt.legend(loc=4)

运行结果:

【声明】本内容来自华为云开发者社区博主,不代表华为云及华为云开发者社区的观点和立场。转载时必须标注文章的来源(华为云社区)、文章链接、文章作者等基本信息,否则作者和本社区有权追究责任。如果您发现本社区中有涉嫌抄袭的内容,欢迎发送邮件进行举报,并提供相关证据,一经查实,本社区将立刻删除涉嫌侵权内容,举报邮箱:

cloudbbs@huaweicloud.com

- 点赞

- 收藏

- 关注作者

评论(0)