结合反应式与慎思式机制的 Agent 架构及其工程适用性分析

解释混合式 Agent 的设计理念—融合反应式与慎思式架构

一、背景:单一 Agent 架构为何不够用?

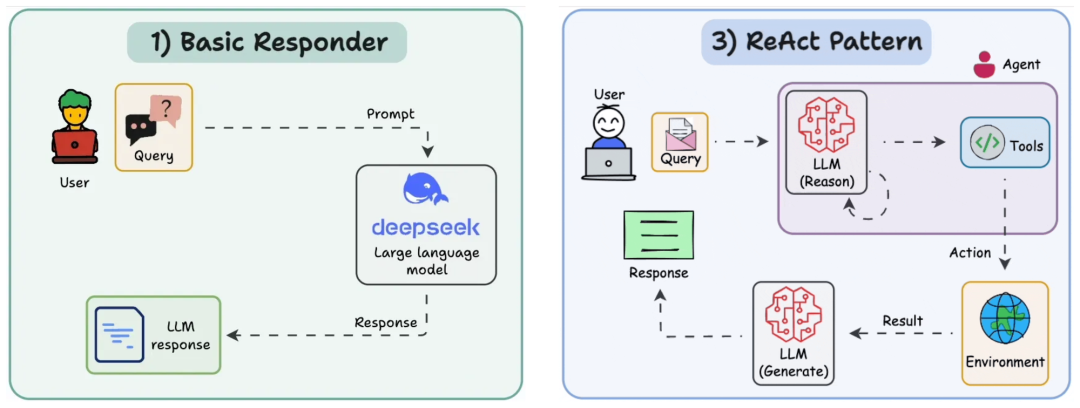

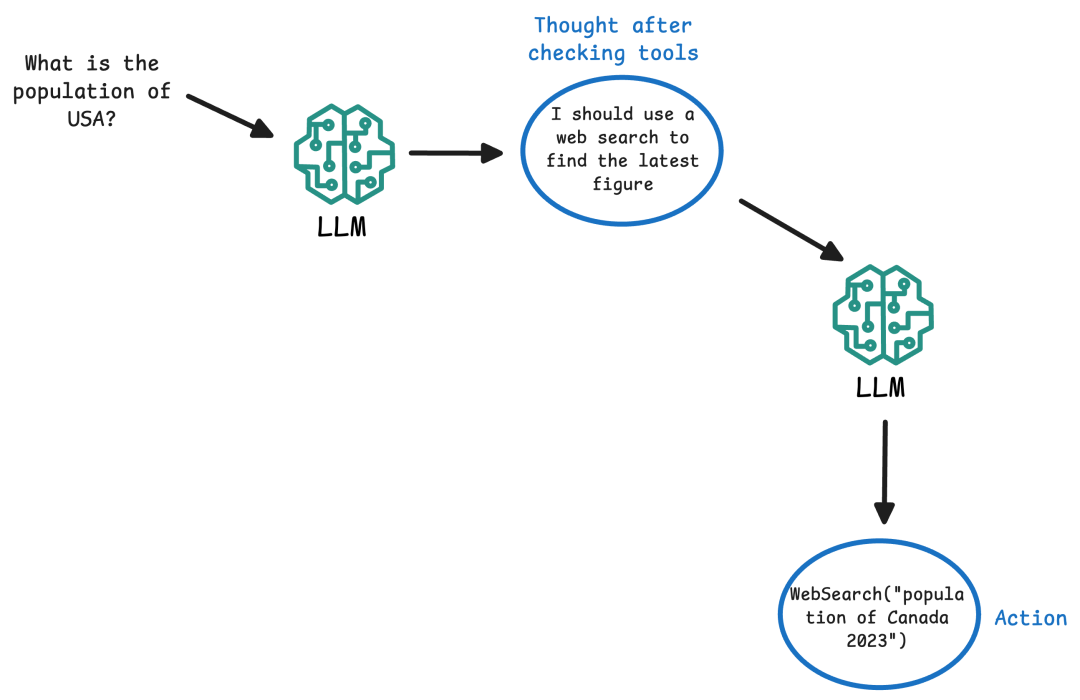

随着大模型(LLM)与 Agent 技术的成熟,越来越多的系统开始从“被动问答”演进为具备感知、决策与行动能力的智能体(Agent)。

然而,在真实工程场景中,我们很快会发现一个问题:

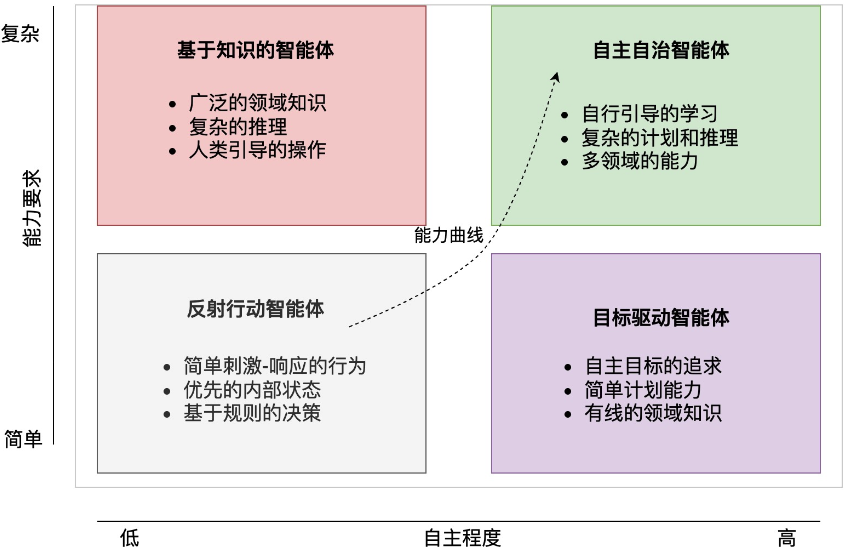

单一的 Agent 架构,很难同时满足“实时响应”与“复杂推理”这两类需求。

-

反应式 Agent(Reactive Agent)

- 优点:响应快、结构简单、实时性强

- 缺点:无全局规划,容易“头痛医头、脚痛医脚”

-

慎思式 Agent(Deliberative Agent)

- 优点:可规划、可推理、决策质量高

- 缺点:推理成本高,响应慢,不适合高频交互

这正是**混合式 Agent(Hybrid Agent)**诞生的现实背景。

二、什么是混合式 Agent?

混合式 Agent 并不是简单地“二选一”,而是:

在同一个 Agent 系统中,同时引入反应式与慎思式两种决策机制,并通过清晰的分工与调度实现协同。

其核心思想可以概括为一句话:

简单问题快速反应,复杂问题深度思考。

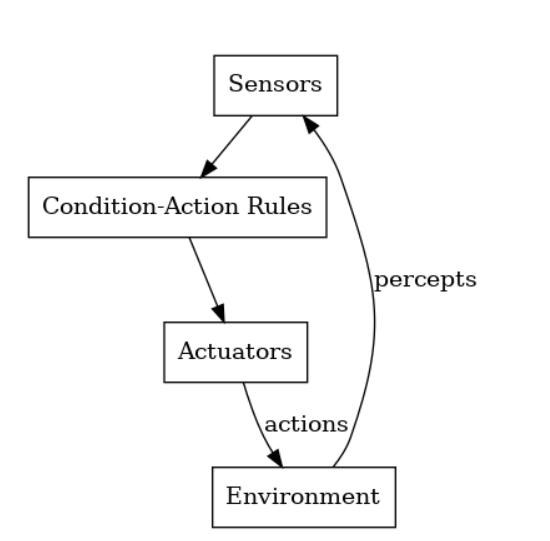

三、混合式 Agent 的典型架构设计

一个经典的混合式 Agent 通常包含以下几个核心模块:

┌─────────────┐

│ 环境感知层 │ ← 输入(用户请求 / 传感器 / 事件)

└──────┬──────┘

│

┌──────▼──────┐

│ 反应式层 │ ← 规则 / Pattern / 快速策略

└──────┬──────┘

│(无法处理)

┌──────▼──────┐

│ 慎思式层 │ ← 规划 / 推理 / LLM

└──────┬──────┘

│

┌──────▼──────┐

│ 行动执行层 │ ← Tool / API / 系统操作

└─────────────┘

关键设计原则

-

反应式层优先

- 能用规则解决的,不进入推理

-

慎思式层兜底

- 仅处理高价值、高复杂度任务

-

两者解耦

- 规则系统 ≠ 推理系统,避免互相污染

四、一个直观示例:混合式对话 Agent

场景设定

我们设计一个简单的智能助手,具备以下能力:

- 对固定问题(如寒暄、帮助指令)立即响应

- 对开放问题(如“帮我设计一个方案”)进入深度推理

五、代码示例:混合式 Agent 的最小实现(Python)

1️⃣ 定义反应式模块(Rule-Based)

class ReactiveAgent:

def __init__(self):

self.rules = {

"你好": "你好!有什么可以帮你?",

"help": "你可以问我技术问题或让我帮你做规划。",

"时间": "我暂时无法获取实时系统时间。"

}

def respond(self, user_input: str):

return self.rules.get(user_input, None)

2️⃣ 定义慎思式模块(Deliberative)

这里用一个 模拟的 LLM 推理模块 表示(真实项目中可接入 GPT / DeepSeek / Qwen 等)。

class DeliberativeAgent:

def think(self, user_input: str):

# 模拟复杂推理

return f"这是一个需要深入思考的问题,我正在分析:{user_input}"

3️⃣ 混合式 Agent 调度器(核心)

class HybridAgent:

def __init__(self):

self.reactive = ReactiveAgent()

self.deliberative = DeliberativeAgent()

def handle(self, user_input: str):

# Step 1: 先尝试反应式处理

reactive_response = self.reactive.respond(user_input)

if reactive_response:

return reactive_response

# Step 2: 进入慎思式推理

return self.deliberative.think(user_input)

4️⃣ 使用示例

agent = HybridAgent()

print(agent.handle("你好"))

print(agent.handle("帮我设计一个混合式 Agent 架构"))

输出示例:

你好!有什么可以帮你?

这是一个需要深入思考的问题,我正在分析:帮我设计一个混合式 Agent 架构

六、混合式 Agent 的工程价值

✅ 优势总结

| 维度 | 反应式 | 慎思式 | 混合式 |

|---|---|---|---|

| 响应速度 | 快 | 慢 | 快 |

| 决策质量 | 低 | 高 | 高 |

| 成本控制 | 低 | 高 | 可控 |

| 工程可扩展性 | 一般 | 好 | 最优 |

七、适用场景分析

混合式 Agent 特别适合以下场景:

-

企业级智能助手

- FAQ → 反应式

- 方案设计 / 分析 → 慎思式

-

自动化运维 Agent

- 告警处理 → 规则

- 故障定位 → 推理

-

多 Agent 系统中的执行节点

- 快速动作 + 高层规划分离

八、总结

混合式 Agent 并不是“折中方案”,而是一种更符合真实世界复杂性的工程设计哲学:

让机器像人一样:

能条件反射,也能深思熟虑。

在未来的 Agent 系统中,反应式负责效率,慎思式负责智慧,而混合式负责平衡。

混合式 Agent 并非对反应式或慎思式架构的简单叠加,而是一种面向真实工程场景的理性取舍。它通过“反应优先、慎思兜底”的分层决策机制,在保证系统实时性的同时,引入必要的全局规划与复杂推理能力,从而兼顾效率、成本与智能水平。在大模型推理成本依然较高、业务对稳定性和可控性要求不断提升的背景下,混合式 Agent 提供了一条可落地、可扩展、可演进的技术路径,正在成为新一代智能体系统的主流设计范式。

- 点赞

- 收藏

- 关注作者

评论(0)