基于 YOLOv8 的驾驶员疲劳状态识别系统实战(含完整源码与可视化界面)

基于 YOLOv8 的驾驶员疲劳状态识别系统实战(含完整源码与可视化界面)

一、项目背景与研究意义

随着汽车保有量的持续增长,疲劳驾驶已成为交通事故的重要诱因之一。据统计,在高速公路和长途驾驶场景中,由于驾驶员长时间保持同一姿态,容易出现注意力下降、反应迟钝、频繁眨眼、打哈欠等疲劳特征,从而显著提升事故风险。

传统的疲劳检测方法多依赖以下方式:

- 车载方向盘行为分析

- 心率、脑电等生理传感器

- 人工巡查与事后分析

这些方法或成本较高,或依赖额外硬件,或难以规模化部署。相比之下,基于计算机视觉的疲劳状态识别具备以下优势:

- 仅依赖摄像头即可工作

- 可实时分析驾驶员面部行为

- 易于与现有车载系统或监控系统集成

基于此,本文实现并完整落地了一套 基于 YOLOv8 的驾驶员疲劳状态识别系统,并通过 PyQt5 图形化界面 实现真正意义上的“开箱即用”。

源码下载与效果演示

哔哩哔哩视频下方观看:

https://www.bilibili.com/video/BV1noKpzNEvQ/

包含:

📦完整项目源码

📦 预训练模型权重

🗂️ 数据集地址(含标注脚本

二、系统总体设计方案

2.1 系统架构概览

整个系统采用典型的 “模型推理 + GUI 展示” 架构,核心流程如下:

输入源(图片 / 视频 / 摄像头)

↓

YOLOv8 疲劳行为检测模型

↓

行为状态判定(闭眼 / 打哈欠 / 正常)

↓

PyQt5 图形界面实时展示

↓

检测结果保存与回放

系统既可以作为 独立桌面应用运行,也可作为 疲劳检测模块嵌入到其他项目中。

2.2 功能模块划分

系统主要包含以下几个核心功能模块:

| 模块名称 | 功能说明 |

|---|---|

| 模型加载模块 | 支持加载训练好的 YOLOv8 权重 |

| 图像检测模块 | 单张或批量图片疲劳识别 |

| 视频检测模块 | 视频逐帧分析并保存结果 |

| 摄像头模块 | 实时疲劳行为检测 |

| 阈值控制模块 | 动态调整置信度阈值 |

| 结果保存模块 | 自动保存检测图片与视频 |

三、疲劳状态识别思路设计

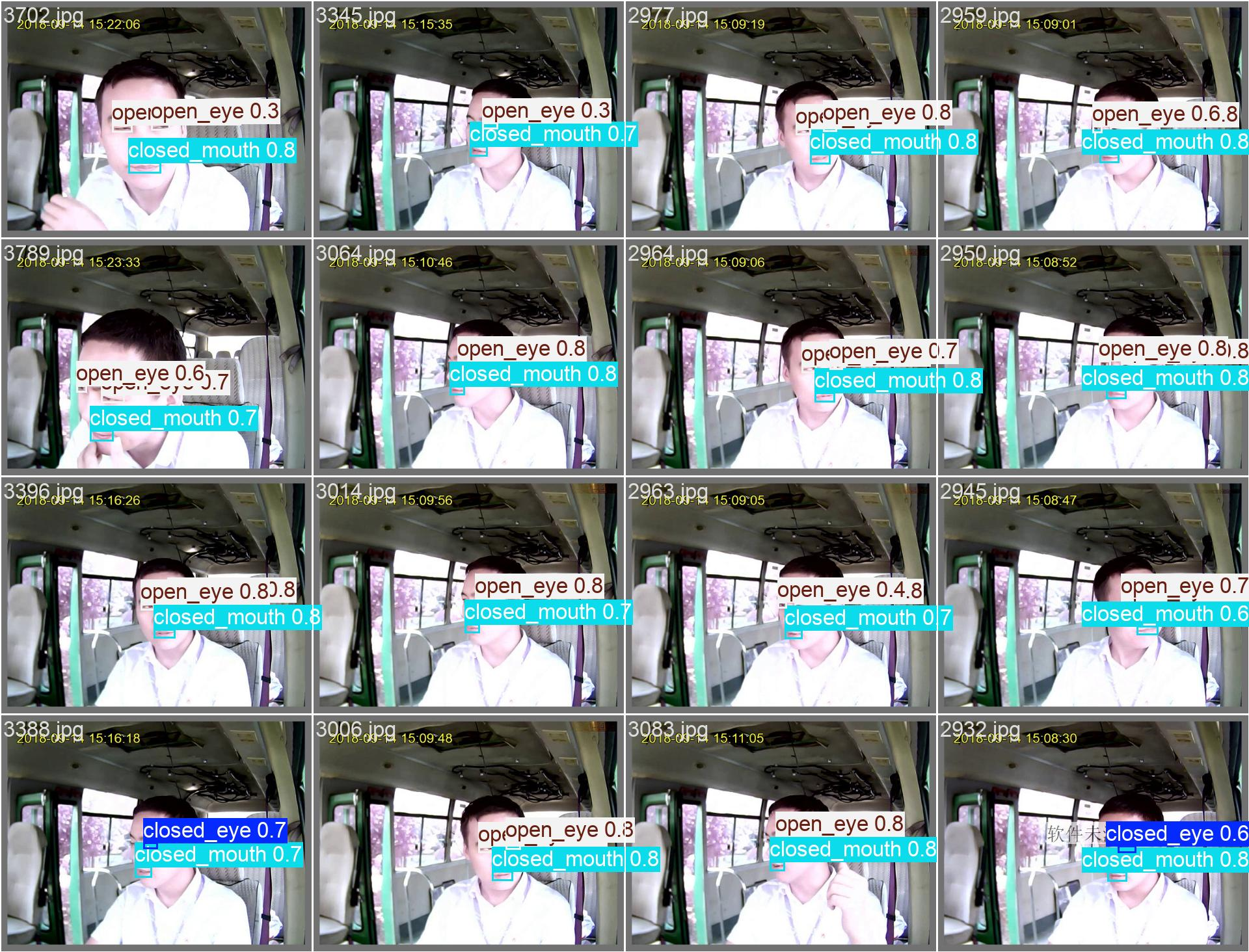

3.1 疲劳行为建模思路

本项目并非直接做“疲劳 / 非疲劳”二分类,而是采用 更具工程可解释性的行为检测策略,即:

先检测具体疲劳行为,再综合判断驾驶状态

主要检测以下关键目标:

- 闭眼(Eye Closed)

- 打哈欠(Yawning)

通过对 眼睛状态 + 嘴部张开程度 的组合分析,可以有效区分:

- 正常驾驶

- 轻度疲劳

- 明显疲劳

该方式相比纯分类模型,更适合后续扩展(如分神检测、低头玩手机等)。

3.2 模型选择原因:YOLOv8

YOLOv8 是 Ultralytics 推出的新一代目标检测模型,具有以下优势:

- Anchor-Free 架构,训练更稳定

- 推理速度快,适合实时视频流

- 原生支持 ONNX / TensorRT 导出

- 生态成熟,工程资料丰富

在疲劳驾驶这种 实时性要求极高 的场景中,YOLOv8 非常适合部署在边缘端或本地端。

四、数据集构建与训练流程

4.1 数据集结构设计

项目采用标准 YOLO 数据集格式,结构如下:

dataset/

├── images/

│ ├── train

│ └── val

├── labels/

│ ├── train

│ └── val

每一张图片都对应一个 .txt 标注文件,记录目标类别与归一化后的边框信息。

4.2 标注类别说明

本项目标注的核心类别包括:

eye_closeyawn

可根据实际需求继续扩展:

eye_openphone_usehead_down

4.3 模型训练命令示例

使用 Ultralytics 官方 CLI 即可完成训练:

yolo detect train \

data=datasets/expression/loopy.yaml \

model=yolov8n.pt \

epochs=100 \

batch=16 \

lr0=0.001

训练完成后,将自动生成:

- 最优权重

best.pt - 损失函数曲线

- mAP 评估指标

- 混淆矩阵

五、模型推理与结果解析

5.1 推理代码示例

模型推理基于 PyTorch 与 Ultralytics API:

from ultralytics import YOLO

model = YOLO("best.pt")

results = model("test.jpg", conf=0.25)

for box in results[0].boxes:

cls = int(box.cls)

score = float(box.conf)

模型输出包括:

- 目标类别

- 置信度

- 边框坐标

5.2 状态判定逻辑

在工程实现中,可以采用如下逻辑:

- 连续多帧检测到闭眼 → 疲劳预警

- 间歇性打哈欠 → 疲劳趋势提示

- 长时间无异常 → 正常状态

这种 时序融合策略 可有效降低误报率。

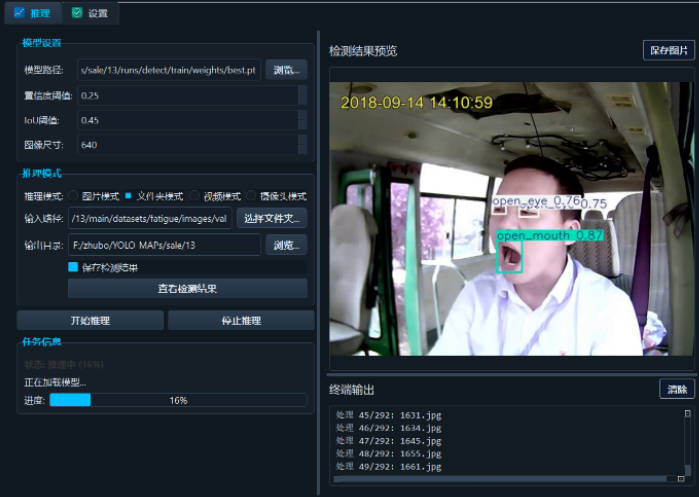

六、PyQt5 图形界面设计

6.1 GUI 设计目标

在实际落地中,很多用户并不具备深度学习背景,因此 GUI 设计的目标是:

- 不需要写代码即可运行

- 操作流程简单直观

- 支持一键检测与保存

6.2 界面功能说明

PyQt5 界面主要包括:

- 模型加载按钮

- 图片 / 视频选择按钮

- 摄像头开关

- 检测结果显示区域

- 日志与状态提示区域

多线程推理机制保证了 检测过程中界面不卡顿。

七、系统部署与运行方式

7.1 一键运行

项目已完成完整打包,运行方式非常简单:

python main.py

无需重新训练即可体验完整功能。

7.2 可扩展部署方向

该系统可进一步部署到:

- 车载嵌入式设备

- 智能驾驶辅助系统

- 安全监控终端

- 教学与科研实验平台

八、项目总结与未来展望

本文完整介绍了一套 基于 YOLOv8 的疲劳驾驶识别系统,从算法原理、数据集构建、模型训练到 GUI 工程落地,形成了完整闭环。

项目核心优势总结:

- 🚗 面向真实驾驶场景,实用性强

- 🧠 行为级检测,结果可解释

- 💻 PyQt5 图形界面,零代码运行

- ⚡ YOLOv8 实时推理,性能稳定

- 📦 项目完整打包,开箱即用

后续可扩展方向:

- 引入时序模型(LSTM / Transformer)

- 增加分神、低头、抽烟等行为

- 联合多摄像头多视角分析

- 与语音报警、CAN 总线联动

- 点赞

- 收藏

- 关注作者

评论(0)