智能体三大核心模块解构:从感知建模到执行控制的底层技术

智能体三大核心模块解构:从感知建模到执行控制的底层技术

引言:智能体的技术全景

在人工智能飞速发展的当下,智能体作为该领域的关键概念,正逐渐渗透到各个行业,从工业制造到医疗健康,从智能家居到智能交通,其身影无处不在。智能体是一种能够感知环境,并根据感知信息自主决策,进而执行相应行动以实现特定目标的系统。它可以是软件程序,如智能客服;也可以是硬件实体,如智能机器人。智能体的出现,极大地推动了人工智能从单纯的数据分析和模型训练,向具备自主交互和任务执行能力的方向发展。

以工业制造为例,智能体能够实时感知生产线上设备的运行状态,如温度、压力、振动等参数,通过分析这些数据自主判断设备是否存在故障隐患,并及时做出决策,如调整设备运行参数、安排维护计划等,从而有效提高生产效率和产品质量,降低生产成本和设备故障率。在医疗领域,智能体可以辅助医生进行疾病诊断,通过分析患者的病历、影像资料等信息,为医生提供诊断建议和治疗方案参考,帮助医生更准确、快速地做出诊断和治疗决策,提高医疗服务水平和患者治愈率。

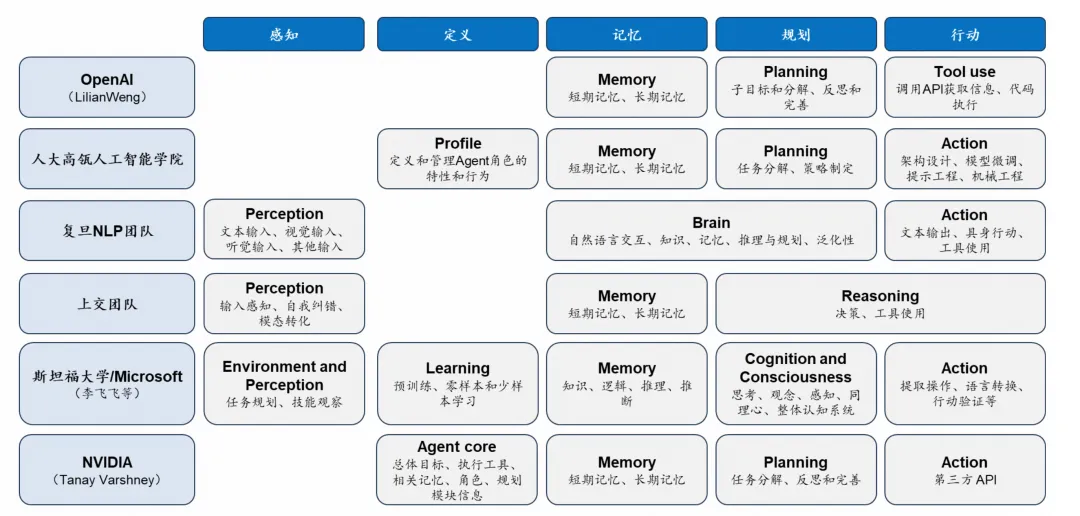

智能体之所以能够实现如此强大的功能,其核心在于包含感知、决策与执行三大关键模块,每个模块都承担着不可或缺的作用,共同构成了智能体的智能基础。这三大模块相互协作,使得智能体能够像人类一样与环境进行交互,理解外界信息,做出合理判断,并采取有效行动 ,它们各自的底层实现机制,也正是智能体研究的关键所在。

一、感知模块:智能体的 “感官”

(一)多模态感知技术的底层实现

感知模块是智能体与外部环境交互的首要环节,其功能类似于人类的感官系统,负责收集周围环境的各种信息。在智能体中,多模态感知技术的底层实现涉及多种信息获取方式。

视觉信息获取主要依赖于摄像头及相关图像识别技术。摄像头通过光学镜头将环境中的光学信号聚焦在图像传感器上,图像传感器再将光信号转换为电信号或数字信号,形成图像数据。以常见的电荷耦合器件(CCD)和互补金属氧化物半导体(CMOS)图像传感器为例,CCD 传感器具有较高的灵敏度和图像质量,能够捕捉到更细微的图像细节,在一些对图像质量要求极高的专业摄影、天文观测等领域应用广泛;而 CMOS 传感器则具有功耗低、成本低、集成度高的优势,被广泛应用于手机、监控摄像头等消费级电子产品中 ,成为智能体获取视觉信息的重要工具。

图像识别技术则利用卷积神经网络(CNN)对这些图像数据进行处理。CNN 中的卷积层通过卷积核在图像上滑动进行卷积操作,提取图像的局部特征,如边缘、纹理等;池化层则对卷积层提取的特征进行降采样,减少数据量,同时保留重要特征;全连接层将池化后的特征进行分类或回归,实现对图像中物体的识别和定位。例如,在智能安防系统中,通过摄像头采集监控画面,利用 CNN 技术可以识别出画面中的人物、车辆、异常行为等信息,为后续的决策提供依据。

听觉信息获取依靠麦克风和语音识别技术。麦克风将声音信号转换为电信号,经过放大、滤波等预处理后,转换为数字信号供计算机处理。语音识别技术通常基于深度学习框架,如基于循环神经网络(RNN)及其变体长短时记忆网络(LSTM)、门控循环单元(GRU)等。这些网络能够处理语音信号的时序特征,通过对大量语音数据的学习,将语音信号转换为文本信息。例如,智能语音助手通过麦克风接收用户的语音指令,利用语音识别技术将其转换为文本,再进行语义理解和相应的操作。

位置信息获取常常借助全球定位系统(GPS)、北斗卫星导航系统等。这些卫星导航系统通过卫星与地面接收设备之间的信号传输,计算出接收设备的地理位置信息,包括经度、纬度和海拔高度等。在智能交通领域,车辆通过车载 GPS 设备获取自身位置信息,结合地图数据和交通信息,实现导航、路径规划等功能,为智能体在空间中的行动提供定位支持。

(二)跨模态投影技术解析

不同模态的信息具有不同的特征和表示方式,这就导致了它们之间存在语义鸿沟,难以直接进行融合和处理。跨模态投影技术旨在将不同模态的数据映射到统一的语义空间,使得智能体能够更好地理解和处理多模态信息。

以图像和文本这两种常见的模态为例,图像是一种高维的视觉信息,以像素矩阵的形式表示,包含丰富的视觉特征;而文本是一种离散的符号序列,以词向量或字符向量的形式表示,蕴含语义信息。跨模态投影技术通过构建映射函数,将图像特征和文本特征投影到同一个低维语义空间中。在这个语义空间中,来自不同模态但语义相关的数据点距离较近,而语义无关的数据点距离较远。

具体实现上,通常使用深度神经网络来学习这种映射关系。例如,可以使用卷积神经网络提取图像特征,使用循环神经网络或 Transformer 模型提取文本特征,然后通过一个或多个全连接层将这两种特征映射到统一的语义空间。在训练过程中,通过设计合适的损失函数,如对比损失、交叉熵损失等,来优化映射函数的参数,使得语义相关的图像和文本在投影后的空间中具有较高的相似度,从而实现跨模态信息的融合和理解。例如,在图像描述生成任务中,通过跨模态投影技术将图像特征和文本特征进行融合,能够生成与图像内容相符的文字描述。

(三)代码示例:模拟感知模块

下面通过一段 Python 代码,展示如何使用简单的库实现一个基本的多模态感知模块,这里以视觉和听觉感知为例:

import cv2

import speech_recognition as sr

# 视觉感知函数

def visual_perception():

# 打开摄像头

cap = cv2.VideoCapture(0)

while True:

ret, frame = cap.read()

if not ret:

break

# 简单的图像显示,可在此处添加图像识别处理

cv2.imshow('Camera Feed', frame)

if cv2.waitKey(1) & 0xFF == ord('q'):

break

cap.release()

cv2.destroyAllWindows()

# 听觉感知函数

def auditory_perception():

r = sr.Recognizer()

with sr.Microphone() as source:

print("请说话...")

audio = r.listen(source)

try:

# 使用Google语音识别服务,需联网

text = r.recognize_google(audio, language='zh-CN')

print("识别结果: ", text)

except sr.UnknownValueError:

print("无法识别语音")

except sr.RequestError as e:

print(f"请求错误: {e}")

if __name__ == "__main__":

visual_perception()

auditory_perception()

在这段代码中,visual_perception函数使用cv2.VideoCapture打开摄像头,实时读取并显示摄像头捕捉到的画面,这里只是简单展示了图像,实际应用中可在这部分添加基于卷积神经网络的图像识别代码,对图像中的物体、场景等进行识别和分析。auditory_perception函数使用speech_recognition库中的Recognizer和Microphone实现语音识别功能,通过麦克风录制语音,然后调用 Google 的语音识别 API 将语音转换为文本,若识别过程中出现错误,会进行相应的错误提示。通过这两个函数,初步模拟了智能体的视觉和听觉感知过程,展示了多模态感知模块的基本实现方式。

二、决策模块:智能体的 “大脑”

(一)主流决策框架剖析

决策模块是智能体的核心组件,如同人类的大脑,负责根据感知模块获取的信息进行分析、判断和决策,决定智能体的行动方向。在人工智能领域,存在多种决策框架,每种框架都有其独特的原理、实现细节和应用场景。

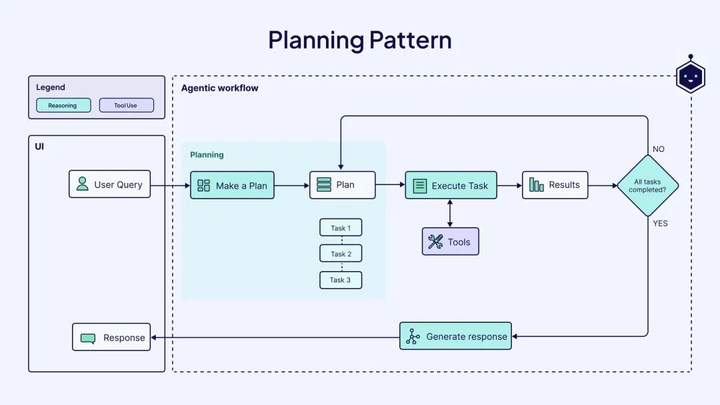

ReAct(Reasoning and Acting)框架由 Yao 等人在 2022 年提出 ,它创新性地将推理和行动融合在一个统一的循环中。其核心机制包括思考阶段、行动阶段和观察阶段。在思考阶段,智能体基于当前观察和历史信息进行推理,分析问题、制定策略,并决定下一步需要执行的动作。例如,当智能体接到 “查询明天北京的天气并告知” 的任务时,在思考阶段,它会分析出需要先获取北京的天气预报信息,然后再组织语言告知用户。在行动阶段,智能体根据思考结果选择并执行具体的动作,如调用天气查询 API,并传入 “明天北京天气” 的参数。观察阶段,智能体获取动作执行后的反馈信息,即天气查询 API 返回的天气数据。然后,智能体进入下一轮思考,根据观察结果判断是否完成任务,若未完成则继续循环,直到给出最终答案。

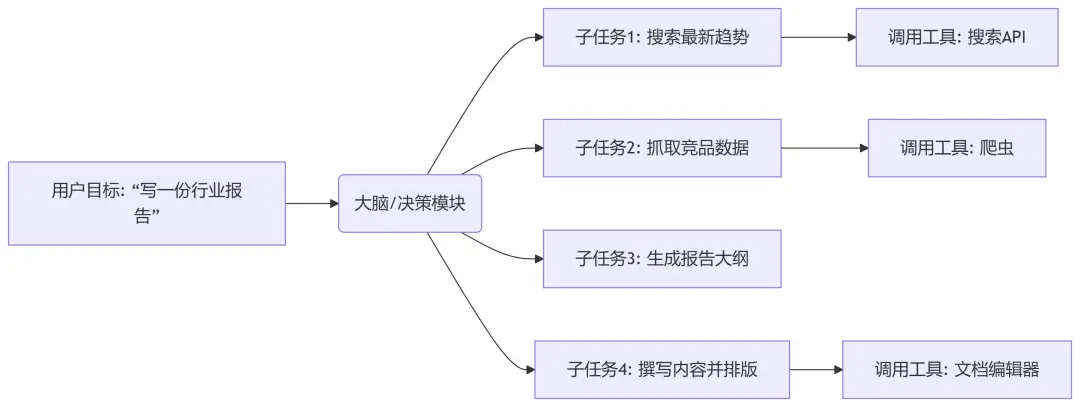

Plan-and-Execute 模式采用分层决策架构,将复杂任务分解为可管理的子任务序列,在处理长期目标和多步骤任务时表现出色。以智能物流配送系统为例,当接到 “将一批货物从仓库 A 运送到客户 B 手中” 的任务时,在规划阶段,智能体首先对任务进行整体分析,将其分解为多个子任务,如 “查询仓库 A 中货物的库存情况”“安排运输车辆”“规划运输路线”“通知客户收货时间” 等,并确定这些子任务的执行顺序和依赖关系。在执行阶段,智能体按照规划好的子任务序列逐一执行,在执行每个子任务时,可采用标准的 ReAct 循环来处理具体细节,如在 “安排运输车辆” 子任务中,通过调用车辆调度系统(这相当于 ReAct 中的工具调用),查询可用车辆信息,并根据货物数量和运输要求选择合适的车辆。若某个子任务执行失败,如 “规划运输路线” 时发现道路拥堵,智能体则会重新评估当前计划,动态调整计划或返回规划阶段进行修正,如重新规划一条避开拥堵路段的路线。

(二)决策过程中的推理与规划

在决策过程中,智能体基于当前观察和历史信息进行推理和规划,以做出最优决策。推理是智能体根据已知的事实、规则或数据,推导出新的结论或选择的过程。逻辑推理基于形式逻辑规则进行,例如,若已知 “所有的鸟都会飞”(前提 1),“麻雀是鸟”(前提 2),通过演绎推理可以得出 “麻雀会飞”(结论)。在智能体决策中,逻辑推理常用于处理确定性问题,能够提供明确且可验证的推理路径。概率推理则通过概率模型来处理不确定性问题,在许多实际应用场景中,智能体面临的信息往往是不确定的,如在自动驾驶中,智能体需要根据传感器获取的不确定信息,如周围车辆的位置、速度、行驶方向等,结合概率模型来评估不同驾驶决策(如加速、减速、转弯等)的风险和可能性,从而选择最合适的行动。

规划是智能体为实现目标而制定的行动步骤和策略。在面对复杂任务时,智能体通常会将任务分解为一系列子任务,并确定子任务的执行顺序和依赖关系。以智能家庭助手为例,当接到 “准备一顿晚餐” 的任务时,智能体可能会将其分解为 “查看冰箱食材”“制定菜谱”“采购食材(若食材不足)”“烹饪菜肴” 等子任务。在规划过程中,智能体需要考虑各种因素,如时间、资源、成本等。例如,在 “制定菜谱” 子任务中,智能体可能会根据冰箱中现有的食材、家庭成员的口味偏好以及烹饪时间等因素来选择合适的菜谱;在 “采购食材” 子任务中,智能体需要考虑采购成本和时间,选择性价比高且配送时间短的购物平台。

(三)代码示例:决策模块实现

下面以 Python 代码展示基于 ReAct 框架的简单决策模块实现,使用langchain库来简化开发过程:

from langchain.agents import AgentExecutor, Tool, initialize_agent

from langchain_core.prompts import PromptTemplate

from langchain_openai import ChatOpenAI

# 模拟搜索工具的API调用

def search_api(query):

# 实际应用中应替换为真实的搜索API调用

return f"模拟搜索结果: {query}的相关信息"

# 模拟数学计算工具

def math_calculator(expression):

try:

result = eval(expression)

return f"计算结果: {result}"

except Exception as e:

return f"计算错误: {str(e)}"

# 定义工具集

tools = [

Tool(

name="Search",

func=search_api,

description="通用搜索引擎,用于查找各类信息"

),

Tool(

name="Calculator",

func=math_calculator,

description="数学计算器,用于进行数学计算,输入为数学表达式"

)

]

# 创建ReAct提示模板

react_prompt = PromptTemplate.from_template("""你是一个智能助手,请严格按以下格式响应:

Thought: 思考当前问题和可用工具

Action: 工具名称(必须是{tool_names}之一)

Action Input: 工具输入参数

Observation: 工具返回结果

...(重复直到得出结论)

Final Answer: 最终答案

问题:{input}

""")

# 初始化语言模型,这里使用ChatOpenAI,需安装openai库并配置API key

llm = ChatOpenAI(model="gpt-3.5-turbo", temperature=0)

# 初始化ReAct智能体

agent = initialize_agent(

tools,

llm,

agent="react-docstore",

prompt=react_prompt,

max_iterations=5 # 防止无限循环

)

# 执行任务

response = agent.invoke({"input": "计算3加5的结果,再查询结果的平方相关信息"})

print(response["output"])

在这段代码中,首先定义了两个模拟工具Search和Calculator,分别用于模拟搜索和数学计算功能。然后创建了一个PromptTemplate模板,用于定义 ReAct 智能体的响应格式,包括思考、行动、行动输入、观察和最终答案等部分。接着初始化了ChatOpenAI语言模型,并使用initialize_agent函数创建了 ReAct 智能体,将工具集、语言模型、提示模板和最大迭代次数等参数传入。最后,通过agent.invoke方法执行任务,传入用户的问题 “计算 3 加 5 的结果,再查询结果的平方相关信息”,智能体根据 ReAct 框架的流程,先调用Calculator工具计算 3 加 5 的结果,再调用Search工具查询结果的平方相关信息,最终返回包含最终答案的响应 。

三、执行模块:智能体的 “手脚”

(一)执行模块的工作原理

执行模块是智能体将决策结果转化为具体行动,与环境进行交互的关键部分,其工作原理涉及多个方面。在智能体做出决策后,执行模块接收决策指令,将这些抽象的决策转化为可操作的物理动作或系统指令。以智能机器人为例,若决策模块决定机器人需要抓取某个物体,执行模块会控制机器人的机械臂运动,通过电机驱动、关节控制等技术,使机械臂按照预定的轨迹移动到物体位置,然后利用夹具或吸附装置抓取物体,完成决策指令的执行。

执行模块还需要实时反馈执行结果和状态信息给决策模块,以便决策模块根据实际情况进行调整和优化。在机器人抓取物体的过程中,执行模块会通过传感器(如力传感器、位置传感器等)实时监测机械臂的位置、力度等信息。若发现抓取力度不足可能导致物体掉落,执行模块会及时将这一信息反馈给决策模块,决策模块则会重新调整抓取策略,增加抓取力度或调整抓取位置,确保任务的顺利完成。

(二)ReAct 架构下的执行流程

在 ReAct 架构中,执行模块在整个智能体的运作流程里扮演着不可或缺的角色,其执行流程具有清晰的步骤和逻辑。当智能体接收任务后,决策模块会进行推理,确定需要执行的动作,并将动作指令传递给执行模块。例如,当智能体接到 “查询明天北京的天气并告知” 的任务时,决策模块经过思考,确定需要调用天气查询 API 这一动作,并将该指令发送给执行模块。

执行模块收到动作指令后,会根据指令调用相应的外部工具或执行具体操作。在上述例子中,执行模块调用天气查询 API,并传入 “明天北京天气” 的查询参数,以获取天气信息。在调用过程中,执行模块需要处理与外部工具的交互细节,如构建正确的请求格式、处理网络通信、解析返回结果等。若天气查询 API 返回 JSON 格式的天气数据,执行模块需要对其进行解析,提取出关键信息,如天气状况、温度、湿度等。

执行模块将执行结果返回给决策模块,决策模块根据结果判断任务是否完成。若未完成,决策模块会继续推理并生成下一个动作指令,再次传递给执行模块执行,直到任务完成。若天气查询 API 返回的结果不完整或存在错误,决策模块可能会决定重新调用 API 或尝试其他查询方法,执行模块则根据新的指令再次执行相应操作 。

(三)代码示例:执行模块代码实现

下面以 Python 代码展示执行模块如何根据决策结果调用外部工具,这里继续使用前面基于 ReAct 框架的例子,增加执行模块的具体实现:

import requests

# 模拟搜索工具的API调用

def search_api(query):

# 实际应用中应替换为真实的搜索API调用

response = requests.get(f"https://api.example.com/search?q={query}")

if response.status_code == 200:

return response.json()

else:

return f"搜索失败,状态码: {response.status_code}"

# 模拟数学计算工具

def math_calculator(expression):

try:

result = eval(expression)

return f"计算结果: {result}"

except Exception as e:

return f"计算错误: {str(e)}"

# 定义工具集

tools = [

{

"name": "Search",

"func": search_api,

"description": "通用搜索引擎,用于查找各类信息"

},

{

"name": "Calculator",

"func": math_calculator,

"description": "数学计算器,用于进行数学计算,输入为数学表达式"

}

]

# 执行模块函数

def execute_action(action, action_input):

for tool in tools:

if tool["name"] == action:

return tool["func"](action_input)

return f"未知动作: {action}"

# 模拟决策结果

action = "Search"

action_input = "人工智能发展趋势"

result = execute_action(action, action_input)

print(f"执行结果: {result}")

在这段代码中,execute_action函数是执行模块的核心部分。它接收决策模块传来的动作名称action和动作输入参数action_input,通过遍历工具集tools,找到与动作名称匹配的工具,并调用该工具对应的函数func,将动作输入参数传入,实现根据决策结果调用外部工具的功能。这里的search_api函数模拟了实际的搜索 API 调用,使用requests库发送 HTTP GET 请求,并根据返回的状态码判断请求是否成功,若成功则返回解析后的 JSON 数据,否则返回错误信息。math_calculator函数用于模拟数学计算工具,通过eval函数执行数学表达式计算。最后,通过调用execute_action函数,传入模拟的决策结果,展示执行模块的工作过程和输出结果。

四、案例分析:智能体在自动驾驶中的应用

(一)感知层面:路况信息获取

在自动驾驶领域,智能体的感知层面对于车辆获取路况信息至关重要,主要依赖于多种先进的传感器技术,它们如同车辆的 “感官”,为自动驾驶提供关键的数据支持。

摄像头是自动驾驶汽车获取视觉信息的重要传感器,通过光学成像原理,将车辆周围的场景转化为图像数据。不同类型的摄像头,如前视、后视、环视摄像头等,安装在车辆的不同位置,以获取全方位的视觉信息。前视摄像头可用于识别前方的道路标志、交通信号灯、车辆和行人等,在车辆行驶过程中,当接近交通信号灯时,摄像头捕捉到信号灯的图像,利用基于深度学习的目标检测算法,如 Faster R-CNN、YOLO 系列等,对图像中的信号灯进行识别和分类,判断其颜色(红、黄、绿)和状态(常亮、闪烁等),从而为后续的决策提供依据。

雷达技术在自动驾驶感知中也占据着重要地位,其中毫米波雷达利用毫米波频段的电磁波来探测目标物体。它能够实时测量目标物体的距离、速度和角度信息,在恶劣天气条件下(如暴雨、大雾、沙尘等),摄像头的视觉感知能力会受到严重影响,而毫米波雷达受天气影响较小,依然能够稳定地工作。当自动驾驶汽车在高速公路上行驶时,毫米波雷达可以持续监测前方车辆的距离和速度变化,通过计算相对速度和距离,判断前车的行驶状态,如是否在加速、减速或保持匀速行驶,为车辆的安全行驶提供重要的距离和速度信息。

激光雷达通过发射激光束并接收反射光,构建出车辆周围环境的三维点云图,能够精确地测量物体的形状、位置和距离,提供高精度的环境感知。在复杂的城市道路场景中,激光雷达可以识别出道路上的各种障碍物,如路边停放的车辆、突然闯入道路的行人、坑洼的路面等。通过对三维点云数据的处理和分析,利用聚类算法(如 DBSCAN 算法)将不同的物体点云进行聚类,从而区分出不同的目标物体,并确定它们的位置和形状信息。

(二)决策层面:行驶策略制定

基于感知层面获取的路况信息,自动驾驶汽车的决策层面如同智能体的 “大脑”,负责分析这些信息并做出合理的行驶决策。

路径规划是决策过程中的重要环节,它根据车辆的当前位置、目的地以及实时路况信息,规划出一条安全、高效的行驶路径。全局路径规划通常使用 A * 算法、Dijkstra 算法等经典算法,以地图信息为基础,考虑道路的连通性、限速、交通规则等因素,计算出从起点到终点的大致路线。当车辆需要从城市的一端行驶到另一端时,全局路径规划算法会在电子地图上搜索出一条最优的路线,考虑到不同道路的通行状况和交通限制,选择一条距离较短且交通流量较小的路线。

局部路径规划则更加关注车辆周围的实时环境变化,实时调整行驶路径,以避免障碍物和应对突发情况,动态窗口法(Dynamic Window Approach)、快速探索随机树(RRT)及其变体(如 RRT*)等算法常被用于局部路径规划。当车辆行驶过程中前方突然出现障碍物时,局部路径规划算法会根据车辆的当前速度、加速度、转向能力以及障碍物的位置和速度等信息,在车辆周围的可行区域内搜索一条安全的避让路径,使车辆能够及时避开障碍物,确保行驶安全。

决策模块还需要综合考虑交通规则和其他交通参与者的行为,做出合理的行驶决策。在遇到红灯时,决策模块会根据车辆与信号灯的距离、车速等信息,判断是否需要提前减速停车;在与其他车辆交汇时,会考虑对方车辆的行驶意图和速度,合理调整自身的行驶速度和方向,确保安全通过交汇点。当车辆行驶到一个没有交通信号灯的十字路口时,决策模块会通过感知模块获取周围其他车辆的行驶方向、速度和距离等信息,根据交通规则(如让右原则等),判断自己是否具有优先通行权,若没有优先通行权,则会等待合适的时机再通过路口,避免发生碰撞事故。

(三)执行层面:车辆控制实现

自动驾驶汽车的执行层面是将决策结果转化为实际驾驶操作的关键环节,主要通过车辆控制系统来实现。

车辆的动力系统负责控制车辆的加速和减速。当决策模块决定加速时,车辆控制系统会向发动机或电机发送指令,增加燃油喷射量或提高电机的输出功率,使车辆加速行驶;当需要减速时,系统会控制发动机或电机降低输出功率,并根据情况启动制动系统。在电动汽车中,通过控制电机的电流和电压,实现对电机输出扭矩的调节,从而控制车辆的加速和减速过程;在燃油汽车中,则通过控制节气门的开度和变速器的换挡时机,实现对发动机输出功率的调节。

转向系统根据决策模块的指令控制车辆的行驶方向。电子助力转向(EPS)系统或线控转向系统接收来自决策模块的转向指令,通过控制电机或液压系统,精确调整方向盘的角度,使车辆按照预定的路径行驶。当车辆需要转弯时,决策模块会根据当前的车速、道路曲率以及车辆的行驶状态等信息,计算出合适的转向角度,并将该指令发送给转向系统,转向系统通过电机驱动转向机构,使车轮转向相应的角度,实现车辆的平稳转弯。

制动系统在车辆需要减速或停车时发挥重要作用。当决策模块判断需要制动时,车辆控制系统会控制制动管路中的压力,使刹车片与刹车盘紧密接触,产生摩擦力,从而使车辆减速或停车。防抱死制动系统(ABS)、电子稳定控制系统(ESC)等先进的制动辅助系统还能在制动过程中,根据车轮的转速和车辆的行驶状态,自动调节制动压力,防止车轮抱死,确保车辆在制动过程中的稳定性和可控性。当车辆在高速行驶中遇到紧急情况需要急刹车时,ABS 系统会快速地对车轮进行点刹,避免车轮因过度制动而抱死,导致车辆失控,同时 ESC 系统会根据车辆的侧滑情况,对各个车轮分别施加不同的制动力,保持车辆的行驶稳定性 。

五、挑战与展望

(一)当前技术面临的挑战

在智能体核心组件的实现过程中,面临着诸多复杂且关键的技术难题,这些挑战制约着智能体技术的进一步发展和广泛应用。

决策的可靠性是智能体面临的重要挑战之一。智能体的决策机制基于算法和模型,然而在复杂多变、充满不确定性的现实环境中,其决策可能出现偏差甚至错误。在自动驾驶场景下,当遇到极端天气、道路标识不清或突发意外情况时,自动驾驶智能体的决策模块可能无法准确判断路况和做出最优决策,导致交通事故的发生。这是因为智能体的决策依赖于大量的训练数据和复杂的算法模型,而现实世界中的情况千变万化,难以完全涵盖所有可能的场景和情况,使得智能体在面对未知或罕见情况时,决策的可靠性和稳定性受到严峻考验。

数据隐私与安全问题也不容忽视。智能体在感知和决策过程中,需要收集和处理大量的用户数据,这些数据包含个人隐私、敏感信息等。在医疗智能体中,涉及患者的病历、基因数据等高度敏感信息;在金融智能体中,包含用户的账户信息、交易记录等重要数据。若这些数据遭到泄露、篡改或滥用,将给用户带来巨大的损失和风险。随着智能体应用场景的不断拓展和数据量的持续增长,如何确保数据在收集、传输、存储和使用过程中的安全性和隐私性,成为亟待解决的问题。传统的数据加密和访问控制技术在应对智能体复杂的数据处理流程和多源数据交互时,存在一定的局限性,需要探索新的技术和方法来保障数据的安全和隐私。

智能体的可解释性同样是一个关键挑战。许多智能体模型,尤其是基于深度学习的模型,往往被视为 “黑盒”,其决策过程和输出结果难以被人类理解和解释。在医疗诊断智能体中,虽然它能够根据患者的症状和检查数据做出诊断建议,但医生和患者可能难以理解智能体是如何得出这些结论的,这在一定程度上影响了智能体决策的可信度和接受度。在一些关键领域,如医疗、金融、司法等,可解释性对于决策的合理性评估、责任界定以及用户信任至关重要。缺乏可解释性不仅可能导致用户对智能体的决策产生怀疑,还可能在法律和伦理层面引发争议,限制了智能体在这些领域的深入应用。

(二)未来发展趋势展望

尽管面临诸多挑战,但智能体技术未来的发展方向和应用前景依然十分广阔,有望在多个方面取得突破和创新。

在技术突破方面,智能体将朝着更加智能化、自主化和协同化的方向发展。随着人工智能技术的不断进步,如深度学习算法的改进、强化学习与其他技术的融合等,智能体的感知能力将更加精准和全面,能够理解和处理更加复杂的环境信息;决策能力将更加智能和高效,能够在短时间内做出更加合理的决策;执行能力将更加灵活和可靠,能够更好地完成各种复杂任务。多智能体系统的协同技术也将不断发展,使多个智能体能够在同一环境中相互协作、共同完成任务,实现更高效的资源利用和任务解决能力。在智能交通系统中,多个自动驾驶车辆作为智能体,通过协同技术可以实现更加高效的交通流量优化和道路资源利用,减少交通拥堵和事故发生。

智能体的应用领域将持续拓展,深入到更多行业和日常生活的各个方面。在工业制造领域,智能体将实现生产过程的全自动化和智能化控制,通过实时感知生产线上的各种数据,自主调整生产参数和流程,提高生产效率和产品质量,降低生产成本和资源消耗。在农业领域,智能体可以应用于精准农业,通过监测土壤湿度、肥力、气候等信息,自动控制灌溉、施肥、病虫害防治等农业生产环节,实现农业的智能化和可持续发展。在日常生活中,智能体将成为人们的得力助手,如智能家居智能体可以根据用户的生活习惯和需求,自动控制家电设备、调节室内环境,提供更加舒适和便捷的生活体验;智能健康管理智能体可以实时监测用户的健康数据,提供个性化的健康建议和疾病预警,帮助人们更好地管理自己的健康。

随着智能体技术的发展,还将催生新的产业和商业模式。智能体开发平台、智能体服务市场等新兴产业将逐渐兴起,为开发者和企业提供更加便捷的智能体开发和应用服务。企业可以基于智能体开发平台,快速开发出满足不同需求的智能体应用,并通过智能体服务市场将其推向市场,实现商业价值。智能体技术还将与其他新兴技术,如物联网、区块链、量子计算等深度融合,创造出更多创新的应用场景和商业模式,推动经济社会的数字化和智能化转型 。

结语:智能体技术的无限可能

智能体的感知、决策与执行模块,构成了其智能行为的基础架构,每个模块的底层实现都蕴含着丰富的技术内涵和创新空间。感知模块让智能体能够敏锐地捕捉和理解周围环境的信息,为后续的决策提供全面的数据支持;决策模块则如同智能体的智慧中枢,基于感知信息进行深入的推理和规划,做出合理且高效的决策;执行模块负责将决策转化为实际行动,精准地与环境进行交互,实现智能体的目标。

随着技术的不断发展,智能体在未来人工智能领域中必将扮演更为关键的角色。它有望推动人工智能从特定任务的执行向更通用、更自主的智能形态转变,实现人与机器之间更加自然、高效的协作。在智能家居、智能交通、医疗健康、工业制造等众多领域,智能体将持续发挥重要作用,提升各行业的智能化水平,改善人们的生活和工作方式。尽管目前智能体技术仍面临诸多挑战,但随着研究的深入和技术的突破,这些难题将逐步得到解决,智能体技术必将迎来更加辉煌的发展前景,为人类社会的进步带来无限可能 。

- 点赞

- 收藏

- 关注作者

评论(0)