融合符号推理与神经表示的认知智能体架构研究

一、引言

随着人工智能从“感知智能”向“认知智能”演进,智能体(Intelligent Agent) 的决策机制也在经历深度变革。传统强化学习或大语言模型(LLM)虽然能够做出行动选择,但往往缺乏对知识的系统理解与推理能力。

知识图谱(Knowledge Graph, KG) 的引入,为智能体提供了结构化的语义知识,使其能够进行更具解释性的、可迁移的智能决策。

本文将介绍一种融合知识图谱的认知智能体决策框架,并通过Python实战展示如何让智能体利用知识图谱辅助推理与决策。

二、框架总体设计

2.1 系统结构概述

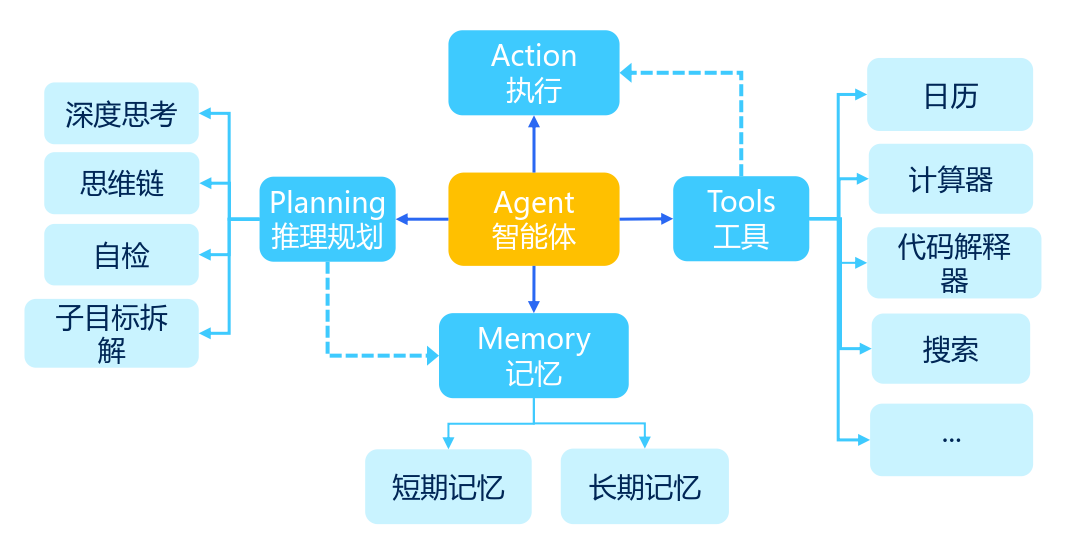

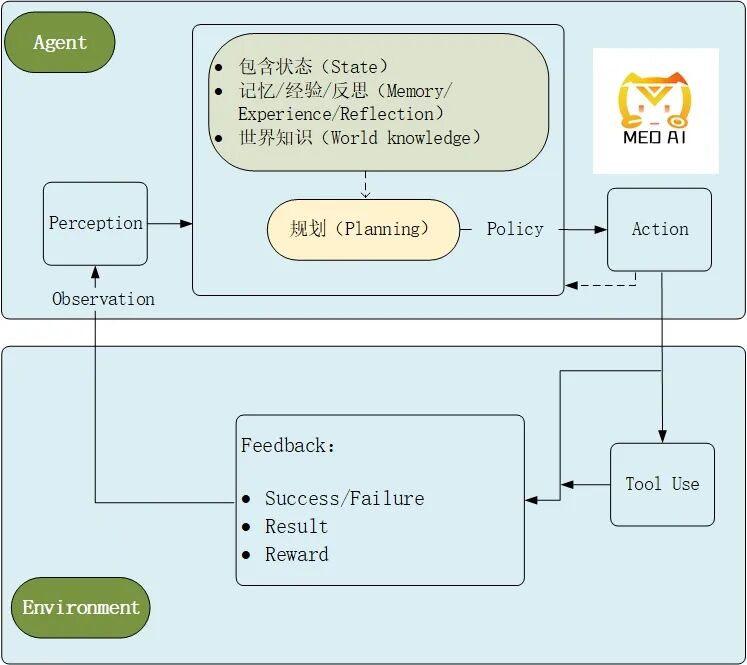

融合知识图谱的认知智能体主要包含以下模块:

-

感知层(Perception Layer)

负责接收外部环境信息,如文本、语音、图像等。 -

知识层(Knowledge Layer)

基于知识图谱构建实体关系网络,提供语义关联与逻辑推理能力。 -

决策层(Decision Layer)

将知识图谱中的推理结果作为上下文输入,结合强化学习或规则推理模型生成决策。 -

执行层(Action Layer)

输出具体动作或策略,并反馈执行结果用于迭代优化。

2.2 决策流程图

输入环境状态 → 知识检索 → 语义推理 → 行动生成 → 执行与反馈

这一流程与传统强化学习的“状态—动作—奖励”模型相融合,但增强了“语义推理”的环节,使智能体具备类人认知能力。

三、关键技术分析

3.1 知识图谱嵌入(Knowledge Graph Embedding)

知识图谱以三元组形式存储知识:

(head_entity, relation, tail_entity)

例如:

("感冒", "治疗方法", "喝姜汤")

嵌入模型(如TransE、DistMult、ComplEx)将实体与关系映射到向量空间,使智能体可以利用向量运算完成语义相似性与逻辑推理。

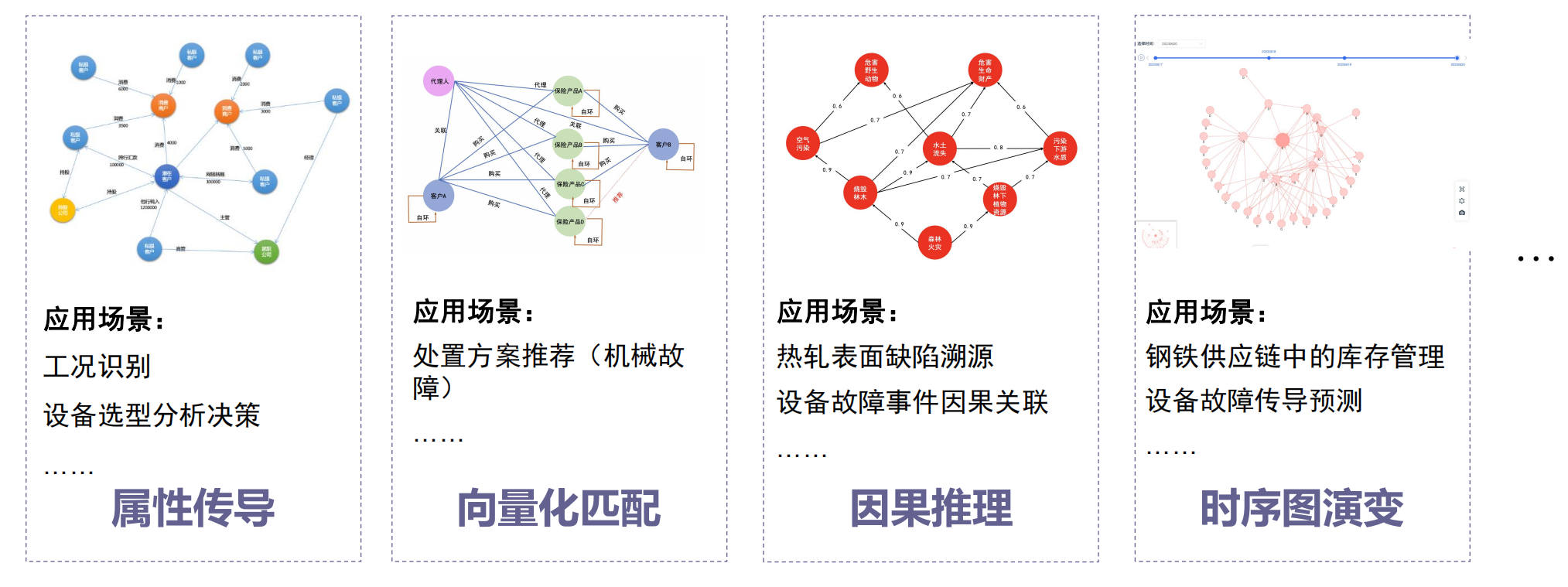

3.2 基于图的推理机制

智能体通过图搜索算法(如BFS、DFS、GraphSAGE)探索关联实体,从而辅助决策。例如,当输入“病人发烧”时,智能体可沿着知识图谱检索出与“退烧”相关的药物与方案。

3.3 知识增强决策

决策模块可以将知识图谱的推理结果作为状态增强输入,例如:

state = [环境特征, 知识图谱推理结果]

action = policy(state)

这种融合使得智能体能够在未知场景下进行基于知识的迁移决策。

四、代码实战:构建一个基于知识图谱的认知智能体

我们用Python构建一个简化的原型系统,让智能体根据知识图谱进行推理决策。

4.1 环境准备

!pip install networkx numpy

4.2 构建知识图谱

import networkx as nx

# 创建知识图谱

KG = nx.DiGraph()

# 添加实体关系(三元组)

triples = [

("感冒", "症状", "发烧"),

("感冒", "症状", "咳嗽"),

("发烧", "治疗方法", "退烧药"),

("咳嗽", "治疗方法", "止咳糖浆"),

("退烧药", "副作用", "嗜睡"),

("止咳糖浆", "副作用", "胃不适")

]

for h, r, t in triples:

KG.add_edge(h, t, relation=r)

print("知识图谱节点数:", KG.number_of_nodes())

4.3 知识检索与推理模块

def query_knowledge(graph, entity):

"""检索给定实体的直接关系"""

if entity not in graph:

return []

relations = []

for neighbor in graph[entity]:

r = graph[entity][neighbor]["relation"]

relations.append((entity, r, neighbor))

return relations

def reasoning_path(graph, start, target, max_depth=3):

"""在知识图谱中进行简单的关系推理"""

try:

path = nx.shortest_path(graph, source=start, target=target)

return path

except nx.NetworkXNoPath:

return None

# 示例查询

print(query_knowledge(KG, "感冒"))

print(reasoning_path(KG, "感冒", "退烧药"))

4.4 决策智能体

import random

class CognitiveAgent:

def __init__(self, knowledge_graph):

self.KG = knowledge_graph

def perceive(self, symptom):

"""感知输入"""

print(f"当前症状:{symptom}")

return symptom

def think(self, symptom):

"""基于知识图谱推理决策"""

relations = query_knowledge(self.KG, symptom)

actions = [t for (_, r, t) in relations if r == "治疗方法"]

if not actions:

# 尝试间接推理

for node in self.KG.nodes:

path = reasoning_path(self.KG, symptom, node)

if path and "治疗方法" in [self.KG[u][v]["relation"] for u, v in zip(path[:-1], path[1:])]:

actions.append(node)

return actions or ["暂无合适方案"]

def act(self, decision):

"""执行动作"""

action = random.choice(decision)

print(f"智能体决策执行:建议使用『{action}』进行治疗")

# 实例化智能体

agent = CognitiveAgent(KG)

symptom = agent.perceive("感冒")

decision = agent.think(symptom)

agent.act(decision)

五、结果分析

运行上面的代码后,智能体将基于知识图谱进行推理,例如输出:

当前症状:感冒

智能体决策执行:建议使用『退烧药』进行治疗

这意味着智能体通过知识图谱理解了“感冒 → 发烧 → 退烧药”的隐性关系,实现了知识驱动的智能决策。

六、未来展望

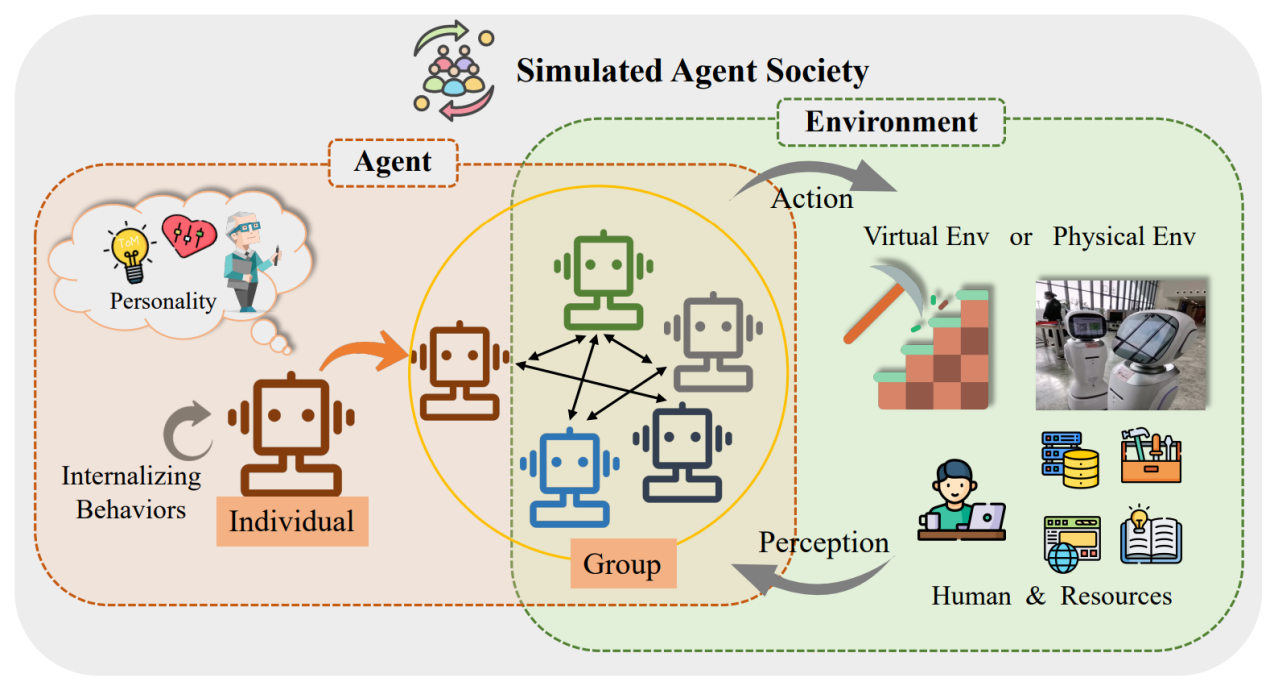

未来的认知智能体将不仅停留在静态知识检索上,而是向以下方向演进:

- 动态知识图谱:实时更新世界状态,支持在线学习。

- LLM + KG 融合推理:将大语言模型的自然语言理解能力与知识图谱的符号推理结合。

- 多模态知识增强:融合文本、图像、语音等跨模态知识进行决策。

- 可解释性强化:通过知识路径追溯解释决策依据。

七、总结

本文构建了一个融合知识图谱的认知智能体框架,从理论上分析了感知、推理、决策的全流程,并通过Python实现了一个知识增强型智能体原型。

这种框架在医疗诊断、金融风控、智能客服等领域都有广泛的应用前景,标志着从“数据驱动”到“知识驱动”的智能决策时代正在到来。

- 点赞

- 收藏

- 关注作者

评论(0)