AI自主决策时代如何构建具备记忆与工具调用的智能体

AI自主决策时代如何构建具备记忆与工具调用的智能体

一、引言:从大语言模型到智能体的时代跃迁

自GPT、Claude、Gemini等大型语言模型(LLM)问世以来,人工智能的能力已远超传统自然语言处理的范畴。

如今,AI正从“被动应答”走向“自主决策”,而这一变革的关键在于——Agent(智能体)架构的崛起。

智能体不仅能理解人类指令,还能主动调用工具、执行任务、管理状态,从而形成一个具备思考、执行与反馈的闭环系统。

二、LLM的局限与Agent架构的提出

2.1 LLM的核心优势

- 大规模预训练语料,具备强大的语言理解与生成能力

- 能在多任务场景中进行迁移学习

- 无需大量特定任务数据即可推理与回答

2.2 LLM的核心瓶颈

尽管LLM强大,但它缺乏真实行动力与持久记忆,无法跨任务维持状态,也不能主动获取外部信息。

例如,GPT模型无法自行调用API或访问数据库,这使其在复杂任务(如自动化办公、智能决策)中存在局限。

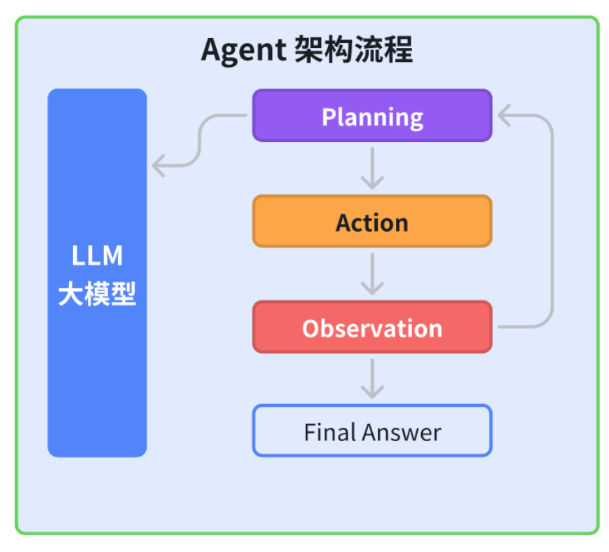

2.3 Agent架构的提出

为解决这些问题,Agent应运而生。

Agent不仅具备LLM的推理能力,还能集成:

- 记忆系统(Memory)

- 工具调用(Tool Use)

- 环境感知(Environment Perception)

- 行动规划(Action Planning)

通过上述模块,AI能够执行从“理解 → 计划 → 行动 → 学习”的全流程。

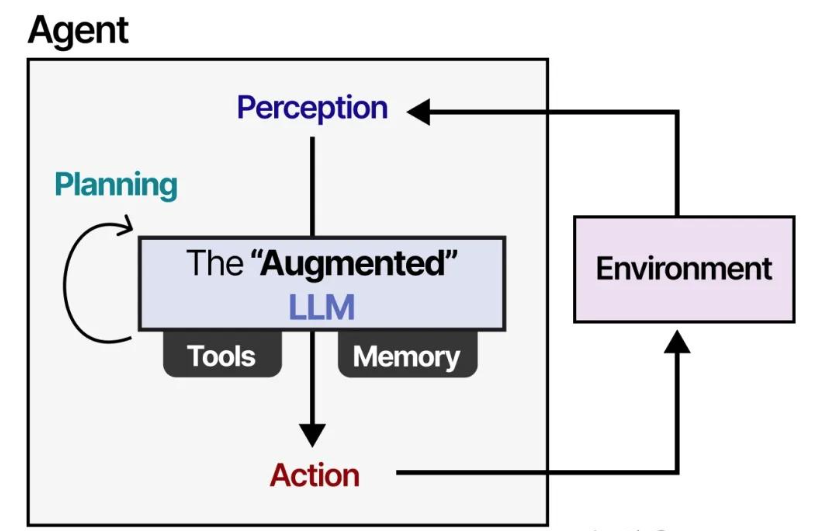

三、智能体AI的系统架构

3.1 基本组成

一个典型的Agent系统包括以下四个核心模块:

| 模块 | 功能 |

|---|---|

| Perception | 感知输入,解析任务与上下文 |

| Memory | 存储交互历史与外部知识 |

| Reasoning & Planning | 生成推理路径与任务执行计划 |

| Action & Tool Use | 通过API或脚本执行实际动作 |

3.2 系统架构图(文字描述)

用户指令 → 感知模块解析 → 记忆模块检索相关信息 → 推理规划模块生成方案 → 调用工具执行 → 输出结果 → 反馈记忆更新

四、代码实战:构建一个简易的AI Agent系统

下面,我们利用Python + OpenAI接口,构建一个具备思考、记忆和工具调用的简易Agent。

4.1 实战目标

实现一个Agent,它能:

- 理解用户指令;

- 自动判断是否需要调用外部工具;

- 执行计算或搜索;

- 将结果反馈给用户。

4.2 环境准备

pip install openai requests

4.3 核心代码实现

import openai

import requests

openai.api_key = "your_api_key_here"

# 定义工具函数

def search_web(query):

print(f"🔍 正在搜索: {query}")

response = requests.get(f"https://api.duckduckgo.com/?q={query}&format=json")

data = response.json()

return data.get("AbstractText", "未找到结果")

# 定义一个简易Agent类

class SimpleAgent:

def __init__(self):

self.memory = []

def think(self, prompt):

"""调用LLM思考"""

response = openai.ChatCompletion.create(

model="gpt-4o-mini",

messages=self.memory + [{"role": "user", "content": prompt}]

)

reply = response.choices[0].message.content

self.memory.append({"role": "user", "content": prompt})

self.memory.append({"role": "assistant", "content": reply})

return reply

def act(self, prompt):

"""执行指令"""

if "搜索" in prompt:

query = prompt.replace("搜索", "").strip()

return search_web(query)

elif "计算" in prompt:

expr = prompt.replace("计算", "").strip()

try:

return str(eval(expr))

except:

return "无法计算该表达式。"

else:

return self.think(prompt)

# 实例化Agent并交互

agent = SimpleAgent()

print(agent.act("你好,帮我搜索人工智能的最新发展"))

print(agent.act("计算 12 * 8 + 7"))

print(agent.act("总结一下人工智能的三大发展阶段"))

4.4 实战结果分析

该Agent能够根据任务内容:

- 识别是否为搜索任务或计算任务;

- 调用相应的外部函数;

- 若无法识别任务类型,则自动调用语言模型进行总结或解释。

这正是智能体最基础的行为模式:感知-决策-执行-反馈。

五、Agent的智能化演进方向(扩展)

智能体AI的出现仅仅是人工智能系统“自我进化”的起点。随着模型规模、工具生态与算力基础的共同发展,Agent正在逐步从单一任务执行者,进化为具备持续学习、长期记忆、跨系统协作的智能生态体。以下几个方向,构成了智能体架构未来演进的关键路径。

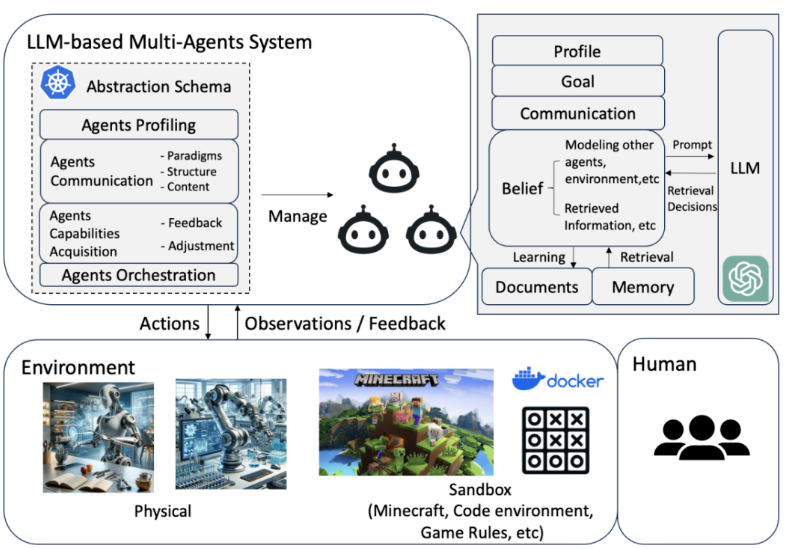

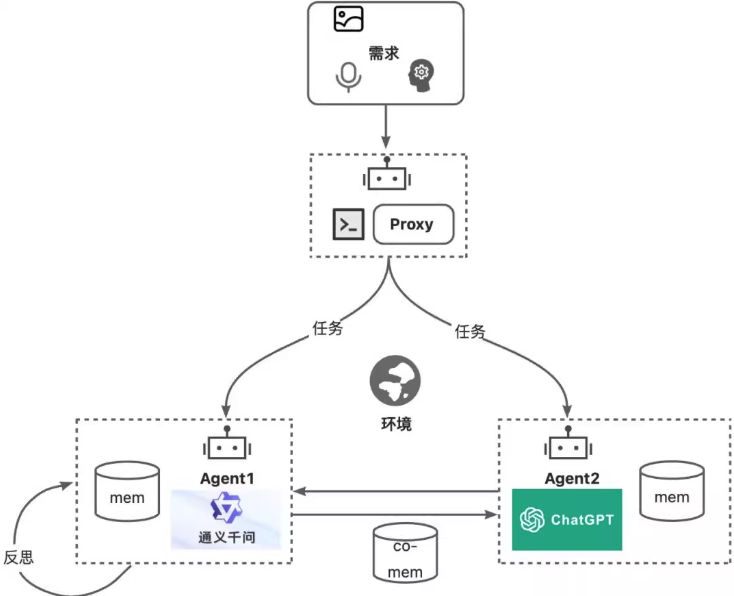

5.1 多智能体协同:从单体智能到群体智能

传统Agent往往聚焦于“单一智能体”的任务执行,如自动客服、文本总结、任务调度等。

而未来的趋势是多智能体协同系统(Multi-Agent System,MAS):多个Agent以不同角色协同工作,彼此间具备通信协议、任务划分与竞争机制,形成一种群体智能(Swarm Intelligence)。

(1)典型应用场景:

- AI科研团队:一个Agent负责文献检索,一个负责代码实验,一个负责结果总结。

- 企业任务分配:多个Agent协作完成项目管理、资源调度与数据分析。

- 虚拟社会模拟:多个Agent模拟不同个体的行为与互动,用于经济、城市规划或社会学研究。

(2)简单示例:两个Agent协作完成复杂任务

class ResearchAgent(SimpleAgent):

def act(self, topic):

return self.think(f"请检索与'{topic}'相关的最新研究方向,并简要总结。")

class SummaryAgent(SimpleAgent):

def act(self, content):

return self.think(f"请将以下研究内容精炼为一段总结:{content}")

# 多智能体协作

researcher = ResearchAgent()

summarizer = SummaryAgent()

topic = "可解释人工智能(XAI)"

research_result = researcher.act(topic)

summary = summarizer.act(research_result)

print("🔬研究内容:", research_result)

print("🧠总结结果:", summary)

此例中,ResearchAgent专注检索信息,SummaryAgent负责信息整合,体现了最基本的多Agent协同工作流。

5.2 长期记忆与自主学习:让Agent“有意识地成长”

当前大多数Agent仍属于无状态系统——任务完成后上下文丢失,导致难以持续学习。

而“长期记忆(Long-term Memory)”正成为智能体系统设计的关键突破点。

(1)技术实现思路:

- 使用 向量数据库(如FAISS、ChromaDB) 存储对话历史;

- 通过语义检索召回过去经验;

- 将记忆结果动态嵌入Prompt中,形成“记忆增强推理(Memory-Augmented Reasoning)”。

(2)简易记忆系统示例

from sklearn.metrics.pairwise import cosine_similarity

from sentence_transformers import SentenceTransformer

import numpy as np

class MemoryAgent(SimpleAgent):

def __init__(self):

super().__init__()

self.encoder = SentenceTransformer('all-MiniLM-L6-v2')

self.memory_vectors = []

self.memory_texts = []

def remember(self, text):

vec = self.encoder.encode([text])

self.memory_vectors.append(vec)

self.memory_texts.append(text)

def recall(self, query, top_k=1):

if not self.memory_vectors:

return "暂无记忆。"

query_vec = self.encoder.encode([query])

sims = cosine_similarity(query_vec, np.vstack(self.memory_vectors))

top_idx = np.argsort(-sims[0])[:top_k]

return self.memory_texts[top_idx[0]]

def act(self, prompt):

recall_info = self.recall(prompt)

full_prompt = f"历史记忆:{recall_info}\n当前任务:{prompt}"

reply = self.think(full_prompt)

self.remember(prompt + " -> " + reply)

return reply

# 测试记忆Agent

mem_agent = MemoryAgent()

print(mem_agent.act("今天我告诉你我喜欢Python"))

print(mem_agent.act("我昨天喜欢什么语言?"))

✅ 执行后,第二次提问会从记忆中自动召回“我喜欢Python”的信息,实现“上下文意识”。

这种架构使Agent从“对话体”跃升为具备认知连续性的学习体。

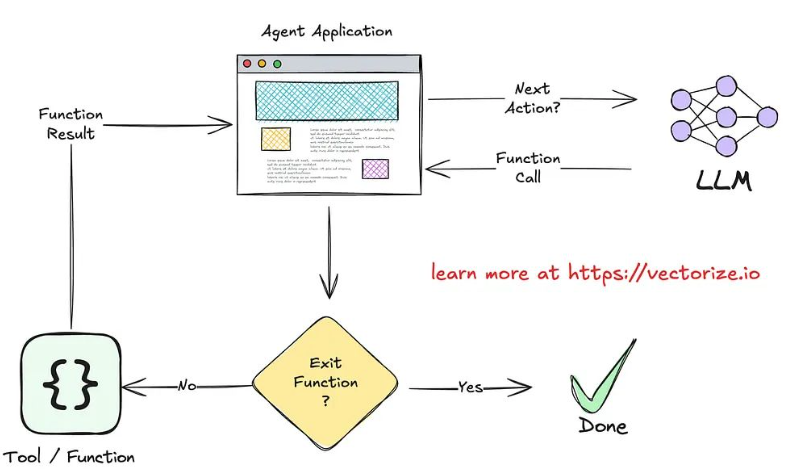

5.3 自主决策与行动规划:让Agent成为问题求解者

智能体的核心能力不仅在于响应,而在于决策(Decision Making)。

未来的智能体将能够在无人工干预的情况下,自行生成任务、评估计划、执行方案。

(1)典型机制:

- Chain-of-Thought (CoT) 推理链;

- Tree-of-Thought (ToT) 树形决策;

- ReAct 框架(Reason + Act);

- Self-Reflection(自我反思) 机制。

(2)示例:ReAct 模式简化实现

class ReActAgent(SimpleAgent):

def act(self, prompt):

thought = self.think(f"分析任务:{prompt}。请分步骤思考如何完成。")

print("💭 推理链:", thought)

if "计算" in prompt:

action = self.act("计算" + prompt.split("计算")[-1])

elif "搜索" in prompt:

action = self.act("搜索" + prompt.split("搜索")[-1])

else:

action = self.think("直接回答:" + prompt)

return f"推理: {thought}\n行动: {action}"

react_agent = ReActAgent()

print(react_agent.act("请计算今天美元对人民币的汇率大约是多少"))

此Agent具备初步的“思考+行动”链式结构,模仿了现代智能体系统(如AutoGPT)的执行逻辑。

5.4 外部工具集成:让Agent能操作世界

真正强大的Agent不仅限于语言推理,而是能够调用外部工具与API,与现实世界发生交互。

(1)常见工具类型:

- 数据分析工具(Pandas、NumPy)

- Web搜索与API调用(Requests、SerpAPI)

- 文件操作与系统命令(OS、Subprocess)

- 知识检索与数据库(FAISS、SQLite、Weaviate)

(2)代码示例:集成Python计算工具

import math

class ToolAgent(SimpleAgent):

def act(self, prompt):

if "平方根" in prompt:

num = int(''.join(filter(str.isdigit, prompt)))

return f"{num}的平方根是 {math.sqrt(num):.2f}"

else:

return self.think(prompt)

tool_agent = ToolAgent()

print(tool_agent.act("请帮我计算81的平方根"))

工具调用使Agent从“文本理解者”演化为“行动执行者”,具备跨系统协作与任务自动化能力。

5.5 开源生态与框架趋势

目前智能体系统的研发已形成多个主流生态:

| 框架 | 特点 |

|---|---|

| LangChain | 支持记忆、工具、链式推理与多Agent协同 |

| AutoGPT / BabyAGI | 自主任务分解与执行 |

| CrewAI / MetaGPT | 多Agent协作项目框架 |

| LlamaIndex | 智能数据检索与嵌入记忆系统 |

随着这些框架的发展,构建复杂的AI Agent系统将变得如搭积木般简单——开发者只需聚焦逻辑设计与任务定义,无需从零实现底层机制。

5.6 人机共生的下一步:Agent + 人类 = 混合智能(Hybrid Intelligence)

未来的AI不再是取代人类的系统,而是与人类**共创智能(Co-Creation Intelligence)**的伙伴。

Agent将成为人类的“数字副手(Digital Twin)”,持续学习使用者的偏好与知识风格,主动分担任务、协助决策。

潜在发展方向包括:

- 个人助理型Agent:管理日程、邮件、文档与工作流;

- 科研合作者Agent:协助论文撰写、实验推理与代码验证;

- 产业级多Agent生态:在制造业、金融风控、智慧城市中协同运行。

总结

从大型语言模型(LLM)到智能体(Agent),人工智能正在经历一次系统架构与认知能力的跨越式升级。本文通过技术分析与实战演示,总结如下核心观点:

-

LLM的优势与局限

- LLM在语言理解与生成上表现卓越,但缺乏持久记忆和自主行动能力。

- 仅依靠LLM,AI仍停留在“被动应答”的阶段,难以胜任复杂任务和多步骤决策。

-

Agent架构的价值

- Agent通过感知、记忆、推理与行动四大模块,实现“理解 → 计划 → 执行 → 反馈”的闭环。

- 集成工具调用、长期记忆和多智能体协作后,Agent能够跨任务、跨系统完成自主决策。

-

技术实战示例启示

- 简易Agent可通过Python实现任务识别、工具调用和记忆增强推理。

- ReAct、Memory-Agent、Tool-Agent等模式展示了Agent在多步骤任务、知识记忆与工具操作上的潜力。

- 多智能体协作示例表明,未来AI系统将趋向“群体智能”,实现复杂任务拆分与协同执行。

-

未来发展趋势

- 长期记忆与自主学习:Agent将逐步具备认知连续性和自我优化能力。

- 多Agent协同:复杂任务将由多智能体协作完成,实现专业分工与效率提升。

- 人机共生(Hybrid Intelligence):Agent不再替代人类,而是成为高效协作伙伴,实现任务辅助、决策支持和知识管理。

- 与现实世界深度连接:通过IoT、机器人、API调用等方式,Agent将从数字世界延伸到实体世界,具备行动能力。

总的来说,从LLM到Agent,是AI迈向自主智能与混合智能的关键演进路径。随着框架生态的完善与技术能力的提升,未来的Agent不仅能思考和执行,还将主动学习、跨系统协作,为人类社会提供更高效、智能的工作与生活方式。

🔮 展望:当智能体具备长期记忆、多Agent协作和现实世界操作能力时,真正意义上的通用人工智能(AGI)时代或将来临——AI将不只是工具,而是“智能伙伴”。

- 点赞

- 收藏

- 关注作者

评论(0)