最小二乘法的极大似然解释

【摘要】

最开始学习机器学习的时候,首先遇到的就是回归算法,回归算法里最最重要的就是最小二乘法,为什么损失函数要用平方和,而且还得是最小?仔细想想最小二乘法视乎很合理,但是合理在哪,怎么用数学方法来证明它合理。...

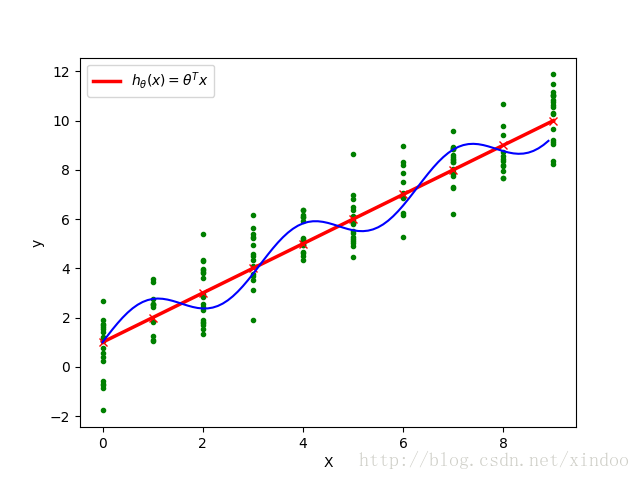

最开始学习机器学习的时候,首先遇到的就是回归算法,回归算法里最最重要的就是最小二乘法,为什么损失函数要用平方和,而且还得是最小?仔细想想最小二乘法视乎很合理,但是合理在哪,怎么用数学方法来证明它合理。

J(θ)=12∑i=1m(hθ(x(i))−y(i))2

hθ(x) hθ(x)

θ

ε(i)(1≤i≤m) σ2

y(i)=θTx(i)+ϵ(i)p(ϵ(i))=12π‾‾‾√σe−(ϵ(i))22σ2p(y(i)|x(i);θ)=12π‾‾‾√σe(−(y(i)−θTx(i))22σ2)

L(θ)=∏i=1mp(y(i)|x(i);θ)=∏i=1m12π‾‾‾√σe(−(y(i)−θTx(i))22σ2)

ℓ(θ)

ℓ(θ)=logL(θ)=log∏i=1m12π‾‾‾√σe(−(y(i)−θTx(i))22σ2)=∑i=1m12π‾‾‾√σe(−(y(i)−θTx(i))22σ2)=mlog12π‾‾‾√σ−1σ2⋅12∑i=1m(hθ(x(i))−y(i))2

σ 12∑mi=1(hθ(x(i))−y(i))2

J(θ)=12∑i=1m(hθ(x(i))−y(i))2

θ θ Θ(n3) θ

J(θ)=12∑i=1m(hθ(x(i))−y(i))2=12(Xθ−y)T(Xθ−y)

J(θ)

∇θJ(θ)=∇θ(12(Xθ−y)T(Xθ−y))=∇θ(12(θTXT−yT)(Xθ−y))=∇θ(12(θTXTXθ−θTXTy−yTXθ+yTy))=12(2XTXθ−XTy−(yTX)T)=XTXθ−XTy

J(θ)

XTXθ−XTy=0XTXθ=XTyθ=(XTX)−1XTy

文章来源: xindoo.blog.csdn.net,作者:xindoo,版权归原作者所有,如需转载,请联系作者。

原文链接:xindoo.blog.csdn.net/article/details/78004521

【版权声明】本文为华为云社区用户转载文章,如果您发现本社区中有涉嫌抄袭的内容,欢迎发送邮件进行举报,并提供相关证据,一经查实,本社区将立刻删除涉嫌侵权内容,举报邮箱:

cloudbbs@huaweicloud.com

- 点赞

- 收藏

- 关注作者

评论(0)