softsign激活函数

【摘要】

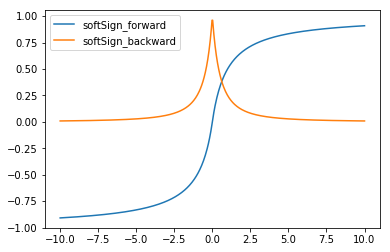

softsign激活函数

人脸识别中,尝试替代prelu和bn层,效果不好。

pytorch函数:

a_tensor=torch.Tensor([[-1,2,30],[4,5,60],[7,8,9]]) aaaaa=F.softsign(a_tensor) print(a_tensor)

class...

softsign激活函数

人脸识别中,尝试替代prelu和bn层,效果不好。

pytorch函数:

-

a_tensor=torch.Tensor([[-1,2,30],[4,5,60],[7,8,9]])

-

aaaaa=F.softsign(a_tensor)

-

-

print(a_tensor)

-

class SoftSign(Activation):

-

def __init__(self, x):

-

super(SoftSign, self).__init__(x)

-

-

def forward(self):

-

self.p = self.x / (1 + np.abs(self.x))

-

return self.p

-

-

def backward(self):

-

self.derivative = np.full_like(self.p, 0)

-

self.derivative[self.x >= 0] = np.power(1 - self.p[self.x >= 0], 2)

-

self.derivative[self.x < 0] = np.power(1 + self.p[self.x < 0], 2)

-

return self.derivative

-

if __name__ == "__main__":

-

x = np.linspace(-10, 10, 500)

-

plt.plot(x, SoftSign(x)()[0], label='softSign_forward')

-

plt.plot(x, SoftSign(x)()[1], label='softSign_backward')

-

plt.legend(loc='best')

-

plt.show()

效果图:

文章来源: blog.csdn.net,作者:AI视觉网奇,版权归原作者所有,如需转载,请联系作者。

原文链接:blog.csdn.net/jacke121/article/details/121284755

【版权声明】本文为华为云社区用户转载文章,如果您发现本社区中有涉嫌抄袭的内容,欢迎发送邮件进行举报,并提供相关证据,一经查实,本社区将立刻删除涉嫌侵权内容,举报邮箱:

cloudbbs@huaweicloud.com

- 点赞

- 收藏

- 关注作者

评论(0)