2021年大数据Spark(三十五):SparkStreaming数据抽象 DStream

目录

SparkStreaming数据抽象-DStream

DStream 是什么

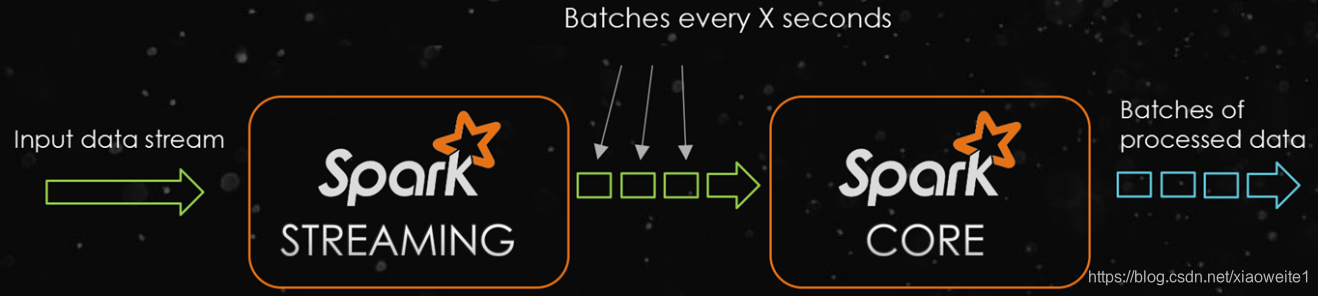

Spark Streaming的核心是DStream,DStream类似于RDD,它实质上一系列的RDD的集合,DStream可以按照秒、分等时间间隔将数据流进行批量的划分。

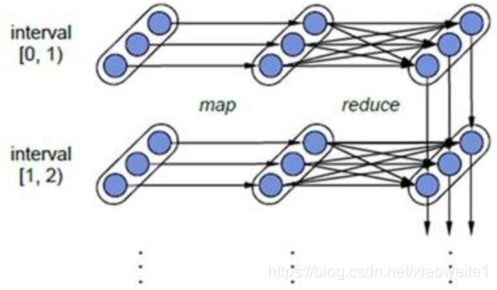

如下图所示:将流式数据按照【X seconds】划分很多批次Batch,每个Batch数据封装到RDD中进行处理分析,最后每批次数据进行输出。

对于目前版本的Spark Streaming而言,其最小的Batch Size的选取在0.5~5秒钟之间,所以Spark Streaming能够满足流式准实时计算场景,对实时性要求非常高的如高频实时交易场景则不太适合。

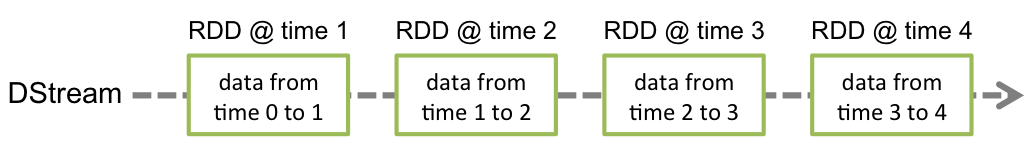

DStream代表了一种连续的数据流,要么从某种数据源提取数据,要么从其他数据流映射转换而来。DStream内部是由一系列连续的RDD组成的,每个RDD都包含了特定时间间隔内的一批数据,

DStream是不间断的 连续的数据对象(内容是无边界的)

如下图所示:

DStream本质上是一个:一系列时间上连续的RDD(Seq[RDD]),DStream = Seq[RDD]。

DStream = Seq[RDD]

DStream相当于一个序列(集合),里面存储的数据类型为RDD(Streaming按照时间间隔划分流式数据)

对DStream的数据进行操作也是按照RDD为单位进行的

。

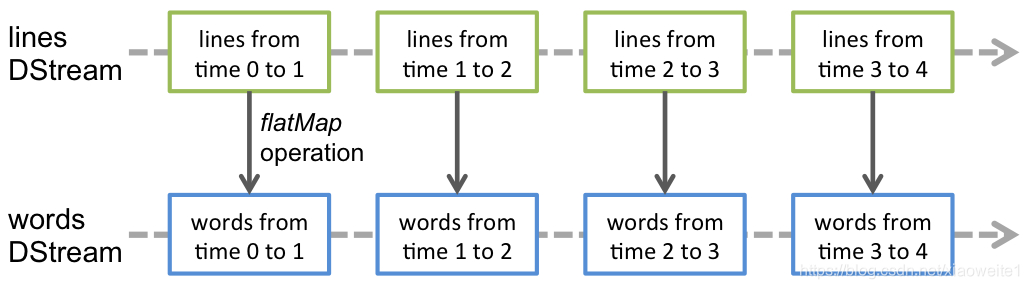

通过WEB UI界面可知,对DStream调用函数操作,底层就是对RDD进行操作,发现很多时候DStream中函数与RDD中函数一样的。

DStream中每批次数据RDD在处理时,各个RDD之间存在依赖关系,DStream直接也有依赖关系,RDD具有容错性,那么DStream也具有容错性。

上图相关说明:

1)、每一个椭圆形表示一个RDD

2)、椭圆形中的每个圆形代表一个RDD中的一个Partition分区

3)、每一列的多个RDD表示一个DStream(图中有三列所以有三个DStream)

4)、每一行最后一个RDD则表示每一个Batch Size所产生的中间结果RDD

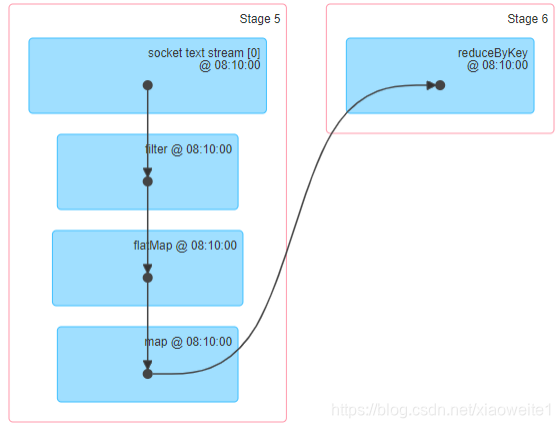

Spark Streaming将流式计算分解成多个Spark Job,对于每一时间段数据的处理都会经过Spark DAG图分解以及Spark的任务集的调度过程。

DStream Operations

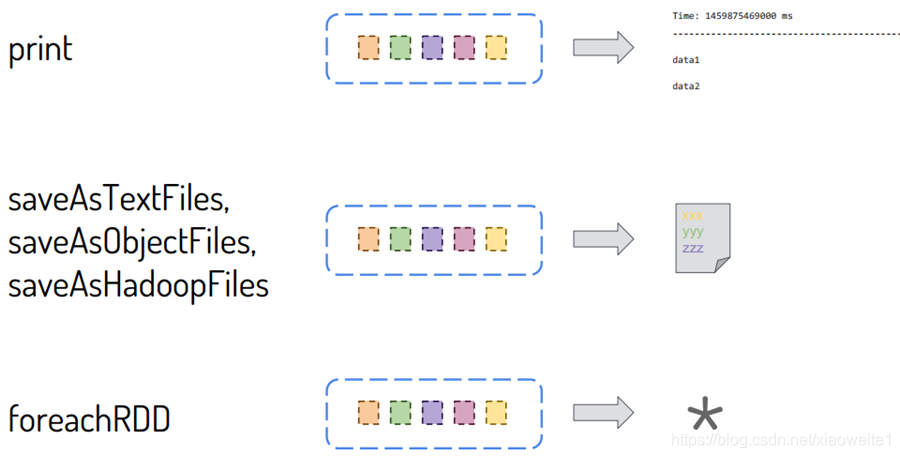

DStream#Output Operations:将DStream中每批次RDD处理结果resultRDD输出

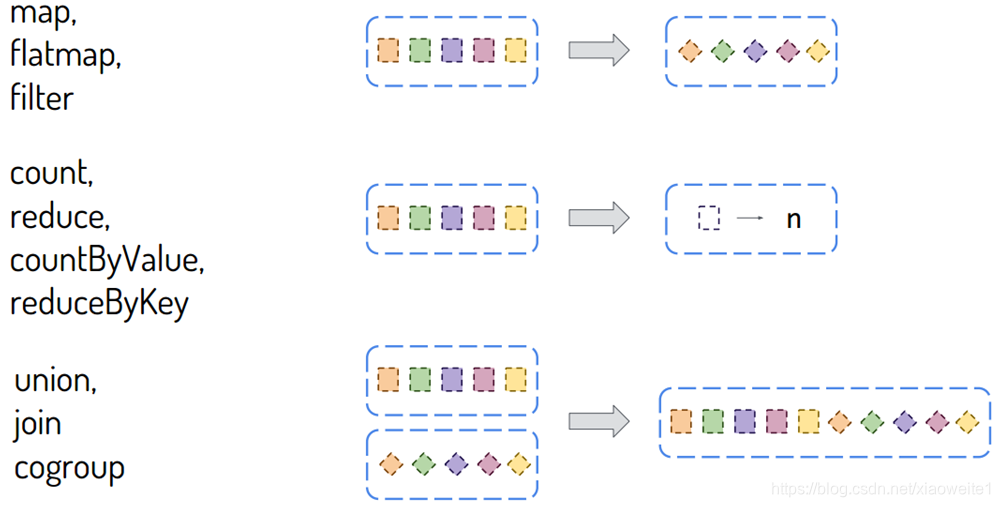

DStream类似RDD,里面包含很多函数,进行数据处理和输出操作,主要分为两大类:

Transformation

大多数和RDD中的类似,有一些特殊的针对特定类型应用使用的函数,比如updateStateByKey状态函数、window窗口函数等,后续具体结合案例讲解。

http://spark.apache.org/docs/2.4.5/streaming-programming-guide.html#transformations-on-dstreams

| Transformation |

Meaning |

| map(func) |

对DStream中的各个元素进行func函数操作,然后返回一个新的DStream |

| flatMap(func) |

与map方法类似,只不过各个输入项可以被输出为零个或多个输出项 |

| filter(func) |

过滤出所有函数func返回值为true的DStream元素并返回一个新的DStream |

| union(otherStream) |

将源DStream和输入参数为otherDStream的元素合并,并返回一个新的DStream. |

| reduceByKey(func, [numTasks]) |

利用func函数对源DStream中的key进行聚合操作,然后返回新的(K,V)对构成的DStream |

| join(otherStream, [numTasks]) |

输入为(K,V)、(K,W)类型的DStream,返回一个新的(K,(V,W)类型的DStream |

| transform(func) |

通过RDD-to-RDD函数作用于DStream中的各个RDD,可以是任意的操作,从而返回一个新的RDD |

Output函数

http://spark.apache.org/docs/2.4.5/streaming-programming-guide.html#output-operations-on-dstreams

| Output Operation |

Meaning |

| print() |

打印到控制台 |

| saveAsTextFiles(prefix, [suffix]) |

保存流的内容为文本文件,文件名为"prefix-TIME_IN_MS[.suffix]". |

| saveAsObjectFiles(prefix,[suffix]) |

保存流的内容为SequenceFile,文件名为 "prefix-TIME_IN_MS[.suffix]". |

| saveAsHadoopFiles(prefix,[suffix]) |

保存流的内容为hadoop文件,文件名为"prefix-TIME_IN_MS[.suffix]". |

| foreachRDD(func) |

对Dstream里面的每个RDD执行func |

文章来源: lansonli.blog.csdn.net,作者:Lansonli,版权归原作者所有,如需转载,请联系作者。

原文链接:lansonli.blog.csdn.net/article/details/115980879

- 点赞

- 收藏

- 关注作者

评论(0)