北大、字节跳动等利用增量学习提出超像素分割模型LNSNet

北大、字节跳动等利用增量学习提出超像素分割模型LNSNet

模型52k,cpu版,运行一张图片需要2.4s,速度挺慢。

网络结构值得学习。

因此为保证超像素分割既可以更好的借助深度学习进行有效的特征提取,又可以同时兼顾传统超像素分割方法高效、灵活、迁移性强的特点,本研究从持续学习的视角看待超像素分割问题,并提出了一种新型的超像素分割模型可以更好的支持无监督的在线训练模式 (online training)。考虑到超像素分割作为广义分割问题需要更关注图像的细节信息,本模型摒弃了其他超像素分割网络中采用的较深而复杂的卷积神经网络结构,而选用了较为轻量级的特征提取模块(FEM),并提出了非迭代聚类模块(NCM)通过自动选取种子节点,避免了超像素分割方法中的聚类中心的迭代更新,极大地降低了超像素分割的空间复杂度与时间复杂度(相比SSN参数量降低近20倍同时运算时间加快了近 4倍)。

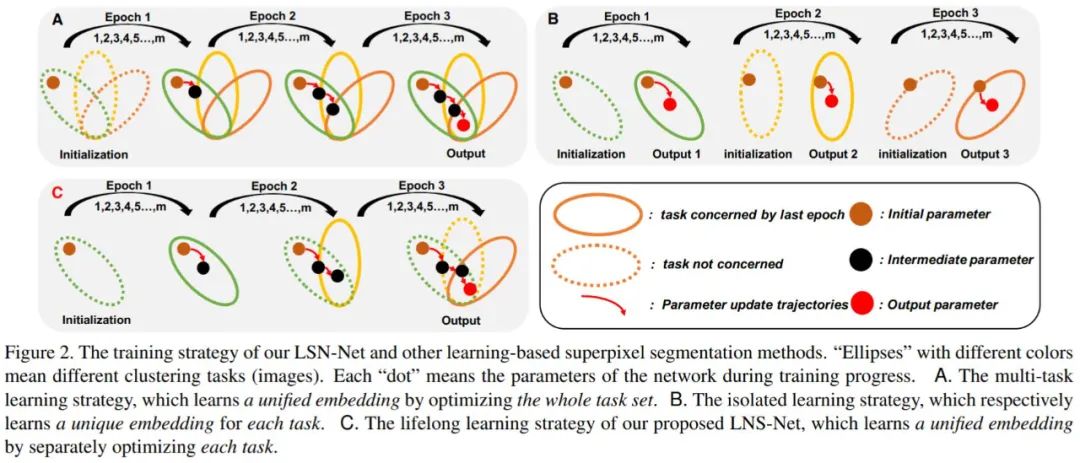

为解决在线学习所带来的灾难性遗忘问题,本模型采用了梯度调节模块(GRM),通过训练权重在特征重建时的作用效果及像素的空间位置先验,调节反向传播时各权重的梯度,以增强模型的记忆性及泛化性。

二、训练框架设计

总的来看,在特定图像 Ii 上进行广义超像素分割的本质,可以看作在该图像域中的进行像素聚类任务 Ti。因此,对于包含 n 张图像的图像集 I={I1, I

文章来源: blog.csdn.net,作者:网奇,版权归原作者所有,如需转载,请联系作者。

原文链接:blog.csdn.net/jacke121/article/details/116536658

- 点赞

- 收藏

- 关注作者

评论(0)