《百问机器学习》第二问:什么是类别型特征?数据预处理时怎样处理类别型特征?处理类别型特征的编码方式有哪几种

目录

2.2.1对于类别取值比较多的情况下,使用独热编码注意以下问题:

1. 什么是类别型特征?

类别型特征(Categorical Feature)主要指的是性别(男、女)、血型(A、B、AB、O)等只在有限选项内取值的特征。

类别型特征原始输入通常是字符串变量,除了决策树等少数模型能够直接处理字符串形式输入,对于逻辑回归、支持向量机模型而言,类别型特征必须经过处理转换成数值型特征才能正确工作。

2. 处理类别型特征的编码方式有哪几种?

- 序号编码(Ordinal Encoding)

- 独热编码(One-hot Encoding)

- 二进制编码(Binary Encoding)

2.1 序号编码

序号编码通常是处理具有大小关系的数据。

例如成绩:分为高、中、低,并且存在排序关系,这样编码赋值后,比如高3,中2,低1转换后依然保证了大小关系。

2.2 独热编码

独热编码用于处理类比之间不具有大小关系的特征。

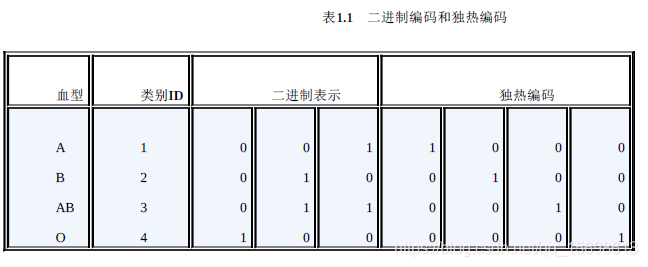

比如血型4种(A、B、AB、O);独热编码会把血型变成一个4维稀疏向量

A(1,0,0,0)、B(0,1,0,0)、AB(0,0,1,0)、O(0,0,0,1)

2.2.1对于类别取值比较多的情况下,使用独热编码注意以下问题:

(1)使用稀疏 向量来节省空间。独热编码下,特征向量只有某一维取值1,其他位置取值为0;这样可以有效节省空间,并且现在大部分算法均接受稀疏向量形式的输入

(2)配合特征选择来降低维度。高维度特征会带来几方面问题:一是K邻近算法中,高维度空间亮点之间的距离很难得到有效衡量;二是在逻辑回归 模型中,参数的数量会随着维度的增高而增加,容易引起过拟合;三是通常只有部分维度对分类、预测有帮助,因此可以考虑配合特征选择降低维度

2.3 二进制编码

二进制编码主要 分两步,选用序号编码给每个类别赋予一个类别ID, 然后将类别ID对应的二进制编码作为结果。

3除了这些编码还有哪些?

- Helmert Contrast

- Sum Contrast

- Polynomial Contrast

- Backward Difference Contrast

文章来源: kings.blog.csdn.net,作者:人工智能博士,版权归原作者所有,如需转载,请联系作者。

原文链接:kings.blog.csdn.net/article/details/96008250

- 点赞

- 收藏

- 关注作者

评论(0)