深度剖析知识图谱中的知识推理:方法与应用探究

察己则可以知人,察今则可以知古。 ——《吕氏春秋》

🍋知识推理的概述

定义: 知识推理是一项复杂的认知过程,通过建立新的关联和逻辑推断,从已知信息中产生新的知识。在知识图谱中,这一过程成为了解决实体之间关系、预测新事实的关键。

简单的例子就是:(研究所,是科研院所)和(科研院所,承担,教学任务)可以推断出(研究所,承担,教学任务)

🍋知识推理的方法

🍋基于逻辑规则的推理

基于逻辑规则的推理是一种传统而强大的知识推理方法,它建立在形式化的逻辑体系之上。这种推理方法依赖于先前定义的逻辑规则和事实,通过逻辑演绎推导新的知识。其中,谓词逻辑(Predicate Logic)是常用的逻辑形式,它允许我们用符号来表示事实、规则和关系。

逻辑规则的表示

在基于逻辑规则的推理中,我们使用谓词逻辑的形式化语言来表示知识。谓词逻辑中的基本元素包括:

常量(Constants): 代表具体的个体,如"John"、"Cat"。

变量(Variables): 代表一类个体,如"X"、"Y"。

谓词(Predicates): 描述个体之间的关系,如"IsFatherOf(X, Y)"表示X是Y的父亲。

逻辑连接词(Logical Connectives): 如AND(∧)、OR(∨)、NOT(¬),用于组合不同的逻辑表达式。

量词(Quantifiers): 包括全称量词(∀,表示对所有)和存在量词(∃,表示存在)。

逻辑规则的演绎推理

推理的基本过程是通过逻辑规则应用于已知的事实,得出新的结论。这涉及到逻辑规则的合成和推导。例如,如果我们知道"John是Bob的父亲"和"Bob是Alice的父亲",我们可以通过逻辑规则推断出"John是Alice的祖父"。

逻辑规则的公式表示

逻辑规则可以用公式表示,以谓词逻辑为例,推理规则的形式化描述如下:

Modus Ponens(摩得斯·波能斯)规则:

如果有一个条件陈述为真,那么可以得出其结论为真。

全称量化规则:

如果一个条件在所有情况下都成立,那么我们可以推断出该条件对某个特定个体成立。

存在量化规则:

如果一个条件对某个特定个体成立,我们可以推断存在一个个体满足该条件。

这些规则只是逻辑推理中的一小部分,而实际应用中可能涉及更复杂的规则和逻辑表达式。

🍋基于知识表示学习的推理

知识表示学习采用机器学习方法,通过将未标记的数据转化为结构化的知识表示。在知识图谱中,这意味着学习实体和关系的嵌入表示,以捕捉潜在的语义关系。这种方法具有更强的泛化能力,能够处理大规模知识图谱的不确定性。

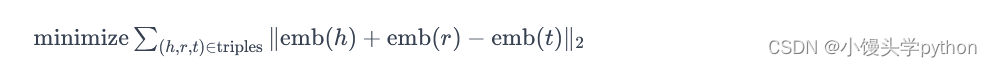

- TransE(Translation-based Embedding)

TransE是一种基于平移的知识表示学习方法,它假设关系是通过对实体之间的平移得到的。对于每个三元组(头实体,关系,尾实体),通过最小化头实体和尾实体之间的平移距离来学习嵌入表示。

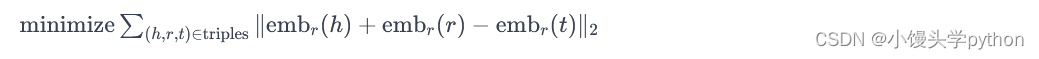

- TransR(Translation-based Relational)

TransR是TransE的扩展,它为每个关系和实体分别学习不同的嵌入空间。通过将头实体嵌入从实体空间映射到关系空间,再通过关系嵌入将其映射回实体空间,从而进行推理。

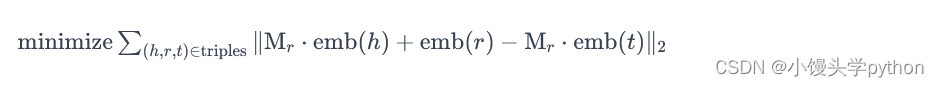

- TransD(Transformation-based Embedding)

TransD是基于变换的知识表示学习方法,它引入了关系特定的变换矩阵,通过对实体和关系进行线性变换来生成嵌入表示。这种方法可以更好地捕捉实体和关系之间的复杂关系。

🍋基于神经网络的推理

基于神经网络的推理方法是近年来在知识图谱领域崭露头角的一种创新方法。其中,Neural Tensor Network(NTN)和Interaction-aware Reasoning Network(IRN)是两个代表性的模型,它们通过神经网络对知识图谱中的实体和关系进行建模,实现了更复杂的推理能力。

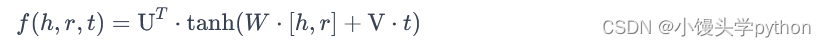

- Neural Tensor Network(NTN)

NTN是一种基于神经张量网络的模型,用于学习知识图谱中实体和关系的嵌入表示。该模型通过引入张量作为参数,能够捕捉实体和关系之间的高阶关系。其推理过程如下:

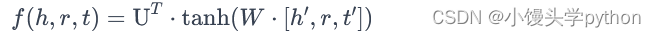

嵌入表示: 对于每个三元组(头实体,关系,尾实体),将头实体和关系的嵌入进行拼接,通过张量运算得到推断得分。

其中,U、W、V是可学习的参数矩阵。

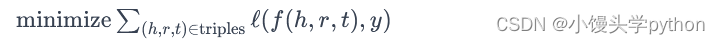

损失函数: 模型通过最小化损失函数,学习嵌入表示使得已知的三元组得分高,未知的三元组得分低。

其中,ℓ是损失函数,y是标签。

NTN的优势在于能够处理实体和关系之间的非线性关系,提高了模型对知识图谱复杂关系的建模能力。

- Interaction-aware Reasoning Network(IRN)

IRN是一种交互感知的推理网络,通过引入交互模块,使得模型能够更好地理解实体对之间的关系。推理过程如下:

交互模块: 对于每个三元组,将头实体和尾实体的嵌入表示进行交互,得到交互后的表示。

其中,InteractionInteraction是交互函数,通过学习实体之间的交互关系,增强模型的推理能力。

推断得分: 通过交互后的表示计算推断得分。

损失函数: 与NTN类似,通过最小化损失函数学习模型参数。

IRN的优势在于通过交互模块增强了模型对实体之间关系的敏感性,提高了推理的精度。

🍋混合推理

混合推理是一种结合多种推理方法的策略,以充分利用各种方法的优势,弥补彼此的不足。在知识图谱领域,混合推理通常涉及到融合基于逻辑规则、知识表示学习和神经网络的推理方法,从而在处理复杂的知识图谱推理任务时达到更全面、高效的效果。

混合推理的核心思想

混合推理的核心思想在于通过组合不同推理方法的优势,提高整体系统的性能。这可以包括同时使用多个推理方法,或者将不同方法的输出进行集成。混合推理的优势在于能够处理知识图谱中多样的关系、非线性结构以及不同领域知识的复杂性。

混合推理的实现策略

- 级联推理:

将不同的推理方法串联起来,按照一定的顺序进行推理。例如,首先使用基于逻辑规则的推理方法进行初步推理,然后利用知识表示学习或神经网络进行更深层次的推理。

- 并行推理:

同时使用多个推理方法,将它们的输出结合起来。这可以通过加权融合、投票机制等方式进行。例如,基于逻辑规则的推理和基于神经网络的推理可以并行进行,最后将它们的输出进行综合考虑。

- 逐步迭代优化:

利用不同推理方法的迭代优化,逐步提升推理结果的精度。这种策略可以在每一步中引入不同的推理方法,根据前一步的结果进行迭代优化。

下面是案例代码,感兴趣的小伙伴可以运行一下

import torch

import torch.nn as nn

import torch.optim as optim

import torch.nn.functional as F

import numpy as np

# 模拟知识图谱的数据

knowledge_graph = {

('Alice', 'isMotherOf', 'Bob'),

('Bob', 'isFatherOf', 'Charlie'),

('Charlie', 'hasSibling', 'David')

}

# 1. 基于逻辑规则的推理

def logical_inference(knowledge_graph, query_entity):

for triple in knowledge_graph:

head, relation, tail = triple

if head == query_entity and relation == 'isMotherOf':

# 根据逻辑规则推理:母亲的子女也是兄弟姐妹

sibling = [t for _, _, t in knowledge_graph if t != query_entity]

return sibling

return None

# 2. 基于神经网络的推理

class NeuralModel(nn.Module):

def __init__(self, input_size, hidden_size, output_size):

super(NeuralModel, self).__init__()

self.fc1 = nn.Linear(input_size, hidden_size)

self.fc2 = nn.Linear(hidden_size, output_size)

def forward(self, x):

x = F.relu(self.fc1(x))

x = F.relu(self.fc2(x))

return x

# 3. 混合推理

def hybrid_inference(query_entity, entity_embedding, relation_embedding, model):

# 基于逻辑规则的推理

logical_result = logical_inference(knowledge_graph, query_entity)

# 基于神经网络的推理

neural_input = torch.cat((torch.tensor(entity_embedding), torch.tensor(relation_embedding)))

neural_result = torch.sigmoid(model(neural_input.float()))

# 结合两种推理结果

if logical_result:

return set(logical_result) # 假设逻辑结果是一个集合

elif neural_result.item() > 0.5:

return ["Neural Inference"] # 临时输出一个示例结果

else:

return None

# 模拟实体和关系的嵌入表示

entity_embedding = np.random.rand(10, 32)

relation_embedding = np.random.rand(10, 32)

# 初始化神经网络模型

input_size = 64 # 假设实体和关系嵌入都是长度为32的向量

hidden_size = 64

output_size = 1

neural_model = NeuralModel(input_size, hidden_size, output_size)

# 示例查询

query_result = hybrid_inference('Alice', entity_embedding[0], relation_embedding[0], neural_model)

print("Hybrid Inference Result:", query_result)

🍋应用场景

知识推理在多个领域展现出强大的应用潜力:

-

智能问答系统: 基于推理的问答系统能够更深入地理解用户问题,提供更准确、有针对性的答案。

-

推荐系统: 知识推理带来更智能、个性化的推荐体验,通过深入理解用户和物品之间的关系,提高推荐的精准度。

-

医疗诊断: 在医学领域,知识推理可用于疾病诊断,通过结合病例历史和医学知识,辅助医生制定更精准的诊断方案。

🍋结语

知识推理在推动知识图谱技术发展方面发挥着关键作用。透过不同的推理方法,我们能够更全面、深入地理解知识图谱中的信息网络。未来,随着技术的不断创新,知识推理将在更广泛的应用领域发挥其强大的潜力,为我们提供更智能、高效的决策支持。

- 点赞

- 收藏

- 关注作者

评论(0)