信息论与编码之离散信源小结

目录

三、离散平稳信源(重点:定义,联合熵,条件熵,平均符号熵,极限熵)

2.N维离散平稳有记忆信源的联合熵(重点:熵的链规则的表达式,含义)

前言:

四个基本概念:

一个图:维拉图

一个基本原则:获取信息的过程就是减小不确定性的过程

一、信源的数学模型与分类

1.数学模型

单符号信源:

多符号信源:

2.分类

二、离散无记忆信源的N次扩展

1.数学模型

2.N次扩展信源的熵:

![]()

三、离散平稳信源(重点:定义,联合熵,条件熵,平均符号熵,极限熵)

1.离散平稳信源

一维平稳

当t=i,t=j时(i,j为任意整数)

二维平稳

离散平稳信源

当t=i,t=j时(i,j为 任意整数)

或

或

四、二维离散平稳信源的熵(重点:定义,各种熵的计算)

二维平稳信源:信源输出的随机序列中只有两相邻符号之间有依赖关系。

1.二维平稳有记忆信源X=X1X2的数学模型:

2.X=X1X2的联合熵

含义:二维离散平稳有记忆信源X=X1X2每发出一条消息提供的平均信息量,等于离散平稳有记忆信源X在第一时刻(即起始时刻)由起始概率空间决定的每发出一个符号所提供的平均信息量,再加上信源X第一时刻所发出的符号已知前提下,第二时刻每发出一个符号所提供的条件平均信息量。

3.后熵不增原则

含义:二维离散平稳有记忆信源X=X1X2每发出一条消息(2个符号)所提供的平均信息量总是小于二维离散平稳无记忆信源X²=X1X2每发出一条消息(2个符号)所提供的平均信息量。

4.平均符号熵

含义:表示N长信源每发一个符号提供的平均信息量。

含义:离散平稳有记忆信源X=X1X2每发出一个符号所提供的平均信息量,一定小于离散无记忆信源X²=X1X2每发一个符号所提供的平均信息量。

5.二维平稳信源H(X1X2),H(X2|X1)的计算

五、离散平稳信源的极限熵

1.N维离散平稳信源的信源空间

2.N维离散平稳有记忆信源的联合熵(重点:熵的链规则的表达式,含义)

含义:N维离散平稳有记忆信源X=X1X2...XN每发出一条消息(x1x2…xn)所提供的平均信息量,等于离散平稳有记忆信源X起始时刻每发出一个符号所提供的平均信息量H(X1),加上起始时刻所发出符号已知前提下,第二时刻每发出一个符号所提供的平均条件自信量H(X2|X1);再加上第一﹑第二时刻所发的符号已知的前提下,第三时刻每发一个符号所提供的条件平均信息量H(X3|X1X2),…最后加上第1,2,…(N-1)时刻所发符号已知前提下,第N时刻每发一个符号所提供的条件平均信息量H(XN|X1X2…XN-1)之和。

3.离散平稳信源的熵的性质(重点:掌握公式,意义,证明)

各维条件熵H(XN|X1X2…XN-1)随N的增加是非递增的

N给定时,平均符号熵大于等于条件熵

平均符号熵随着N的增加是非递增的,即

六.离散平稳信源的极限熵(重点:概念,计算)

说明:对于离散平稳信源,当N→∞时(即依赖关系为无限长时),平均符号熵和条件熵都非递增地一致趋于平稳信源的信息熵(极限熵)。

意义:对于记忆长度N足够长(N→∞)的离散平稳有记忆信源X,每发出一个符号提供的平均信息量,即极限熵H∞等于条件熵的极限值

说明:实际中常取有限N下的条件熵

作为H∞的近似值,N=7,8,9。

平稳信源的记忆长度有限时,如马尔科夫信源。设记忆长度为m。(会计算极限熵)

二维平稳有记忆信源X=X1X2的极限熵

七、信源的剩余度(概念,计算)

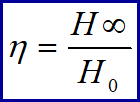

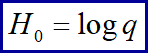

熵的相对率:

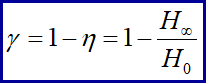

信源剩余度:

文章来源: blog.csdn.net,作者:渣渣ye,版权归原作者所有,如需转载,请联系作者。

原文链接:blog.csdn.net/yyfloveqcw/article/details/124391342

- 点赞

- 收藏

- 关注作者

评论(0)