一文读懂业界主流模型推理部署框架

【摘要】 模型推理框架一览

🎉 声明: 作为全网 AI 领域 干货最多的博主之一,❤️ 不负光阴不负卿 ❤️

📔 模型推理框架 【Intel的OpenVINO – CPU】

可以轻松的将预训练模型在Intel的CPU上快速部署起来

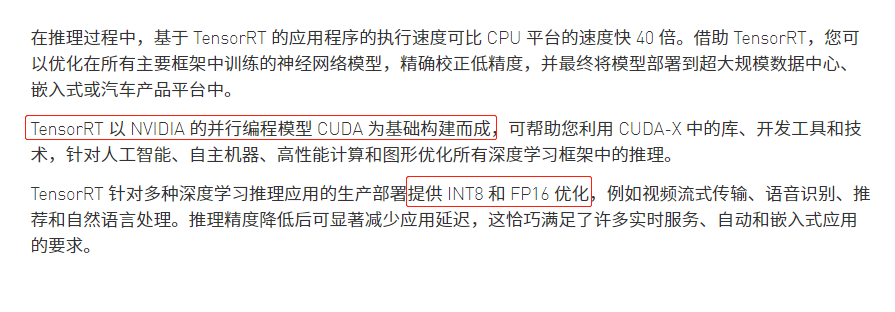

📕 模型推理框架 【Nvidia的TensorRT – GPU - 也支持 CPU】

NVIDIA TensorRT™ 是用于高性能深度学习推理的 SDK。此 SDK 包含深度学习推理优化器和运行时环境,可为深度学习推理应用提供低延迟和高吞吐量。

📗 腾讯 ncnn【移动端部署】

ncnn 是一个为手机端极致优化的高性能神经网络前向计算框架 【在腾讯系 App 有实例应用】

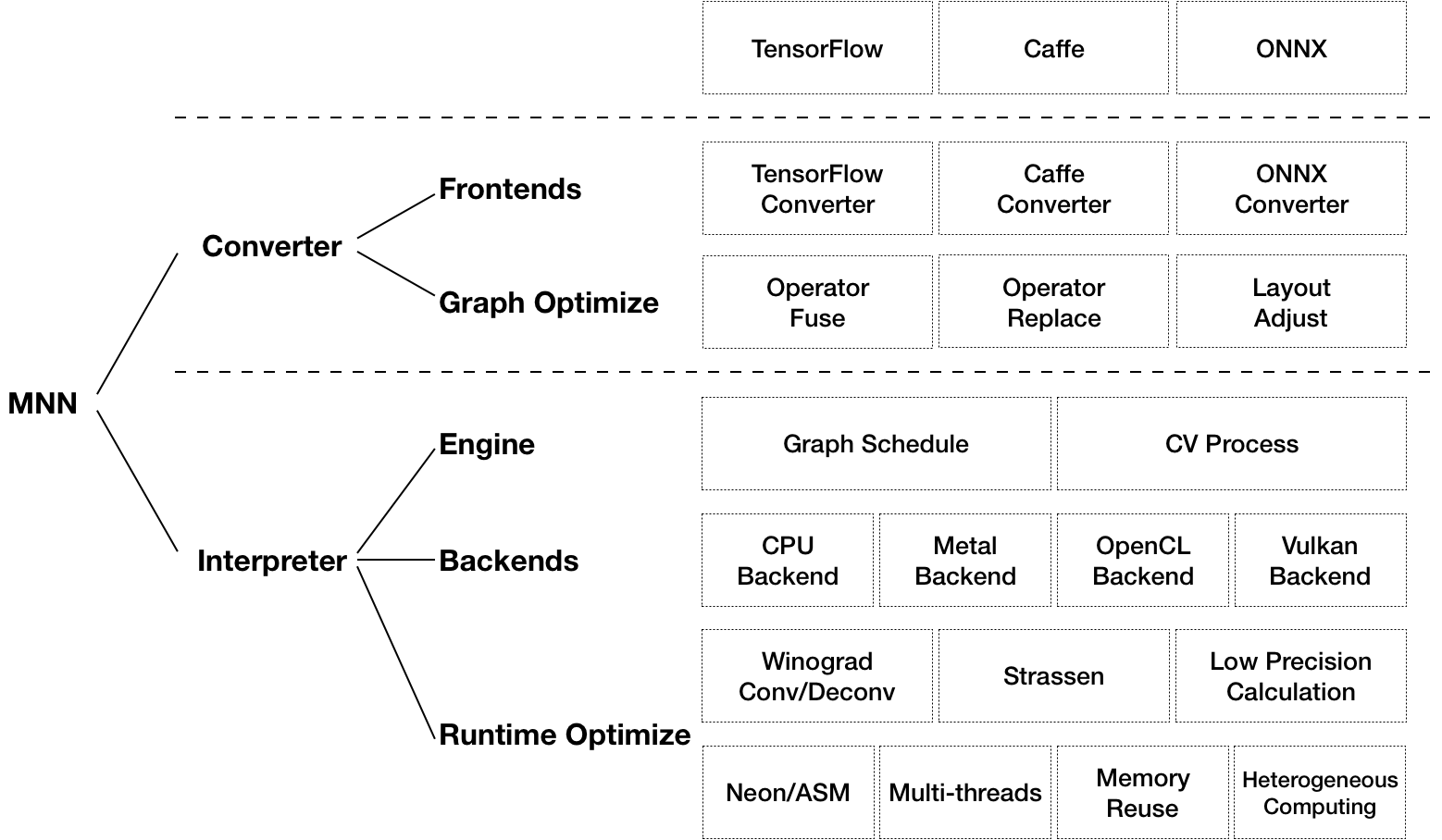

📘 阿里 MNN【移动端部署】

MNN 是一个高效轻量级的深度学习框架。 支持深度学习模型的推理和训练,在端端推理和训练方面具有行业领先的性能 【在阿里系 App 有实例应用】

https://github.com/alibaba/MNN

从热度上来说 和 ncnn 差一大截儿 【不吹不黑】

📙 华为 MindSpore 【 深度学习框架 】

MindSpore是一种适用于端边云场景的新型开源深度学习训练/推理框架 【受限于平台、热度不是那么高】

https://github.com/mindspore-ai/mindspore

还是希望 华为 越来越好,早日走出困境

📜 百度 PaddlePaddle【服务器端 | 移动端 皆可】

产业级深度学习框架 【百度 PaddlePaddle 得益于 百度学习团队的大力推广,值得支持】

- 百度 – 2021AI快车道服务器部署课

- 百度 – 目标检测7日打卡营

- 为了推广国产框架,也是很用心了

💬 简单总结

- 国内传统四巨头,均开源自家的 深度学习推理部署框架

- 也都基本做到各种主流模型【TensorFlow、pyTorch 】等模型转换、优化加速、部署端支持

- 结合 业务选择,理顺学通 各个框架成为 模型部署端 打工人必备技能

👋 不得不夸的YOLOX

除了模型指标的突破创新,更重要的是,工业界各种主流部署教程,官方也已经写的很清晰了

最新整理的 YOLOX 相关学习博文

- YOLOv5 COCO数据集 训练 | 【YOLOv5 训练】

- YOLOv5 环境搭建 | coco128 训练示例 | 详细记录 |【YOLOv5】

- YOLOX 环境搭建 | 测试 | COCO训练复现 【YOLOX 实战】

- YOLOX (pytorch)模型 ONNX export | 运行推理【YOLOX 实战二】

- YOLOX (pytorch)模型 转 ONNX 转 ncnn 之运行推理【YOLOX 实战三】

- YOLOX (pytorch)模型 转 tensorRT 之运行推理【YOLOX 实战四】

- YOLO专栏

我会回来的…

【版权声明】本文为华为云社区用户原创内容,转载时必须标注文章的来源(华为云社区)、文章链接、文章作者等基本信息, 否则作者和本社区有权追究责任。如果您发现本社区中有涉嫌抄袭的内容,欢迎发送邮件进行举报,并提供相关证据,一经查实,本社区将立刻删除涉嫌侵权内容,举报邮箱:

cloudbbs@huaweicloud.com

- 点赞

- 收藏

- 关注作者

评论(0)