保姆级丨Spark环境搭建

【摘要】 Apache Spark 是一种用于大数据工作负载的分布式开源处理系统。它使用内存中缓存和优化的查询执行方式,可针对任何规模的数据进行快速分析查询。

0x00 前言

Apache Spark 是一种用于大数据工作负载的分布式开源处理系统。它使用内存中缓存和优化的查询执行方式,可针对任何规模的数据进行快速分析查询。

0x01 环境说明

| Xshell 7 |

| Spark-3.3.0 |

| centos-a(主节点) |

0x02 准备工作

基于前期已经完成Hadoop部署,本文演示Spark安装过程。文中使用CentOS-7系统在三个虚拟机环境下进行示范,过程使用本地主机与虚拟机交互。首先要在Windows主机下载实验过程需要使用的环境。

ⅠSpark-3.3.0:

https://mirrors.tuna.tsinghua.edu.cn/apache/spark/spark-3.3.0/spark-3.3.0-bin-hadoop3.tgz0x03 Spark安装

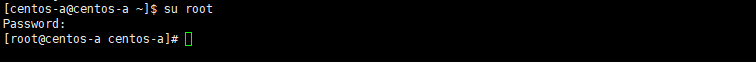

Ⅰroot运行终端

su root

Ⅱ创建spark文件夹

mkdir /usr/local/spark

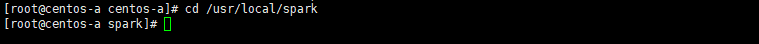

Ⅲ打开spark文件夹

cd /usr/local/spark

Ⅳ利用lrzsz文件互传工具

rz

Ⅴ上传spark-3.3.0-bin-hadoop3.tgz文件

Ⅵ打开Spark文件夹

cd /usr/local/sparkⅦ解压Spark文件

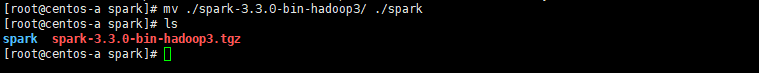

tar -zxvf spark-3.3.0-bin-hadoop3.tgzⅧ重命名Spark解压后的文件

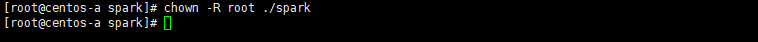

mv ./spark-3.3.0-bin-hadoop3/ ./sparkⅨ给Spark管理员权限

chown -R root ./spark0x04 Spark配置

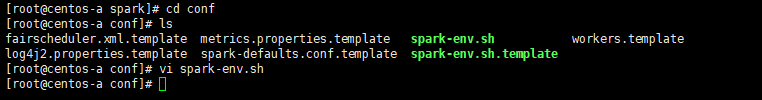

Ⅰ复制一个去掉后缀名的文件,以编辑spark-env.sh文件

cd spark

cp ./conf/spark-env.sh.template ./conf/spark-env.shⅡ打开spark-env.sh文件

cd conf

vi spark-env.sh

Ⅲ编辑spark-env.sh文件

export SPARK_DIST_CLASSPATH=$(/usr/local/hadoop/hadoop-3.3.3/bin/hadoop classpath) #--$(Hadoop路径+classpath)0x04 启动Spark

Ⅰ在spark的bin目录下启动spark

cd /usr/local/spark/spark/bin

./spark-shell0x05 总结

至此Spark环境搭建完成。由于作者水平有限,文中若有错误与不足欢迎留言,便于及时更正。

【声明】本内容来自华为云开发者社区博主,不代表华为云及华为云开发者社区的观点和立场。转载时必须标注文章的来源(华为云社区)、文章链接、文章作者等基本信息,否则作者和本社区有权追究责任。如果您发现本社区中有涉嫌抄袭的内容,欢迎发送邮件进行举报,并提供相关证据,一经查实,本社区将立刻删除涉嫌侵权内容,举报邮箱:

cloudbbs@huaweicloud.com

- 点赞

- 收藏

- 关注作者

评论(0)