Hive基础09、HQL查询语句

Hive基础09、HQL查询语句

目录

hive当中的lateral view 与 explode以及reflect

使用explode函数将hive表中的Map和Array字段数据进行拆分

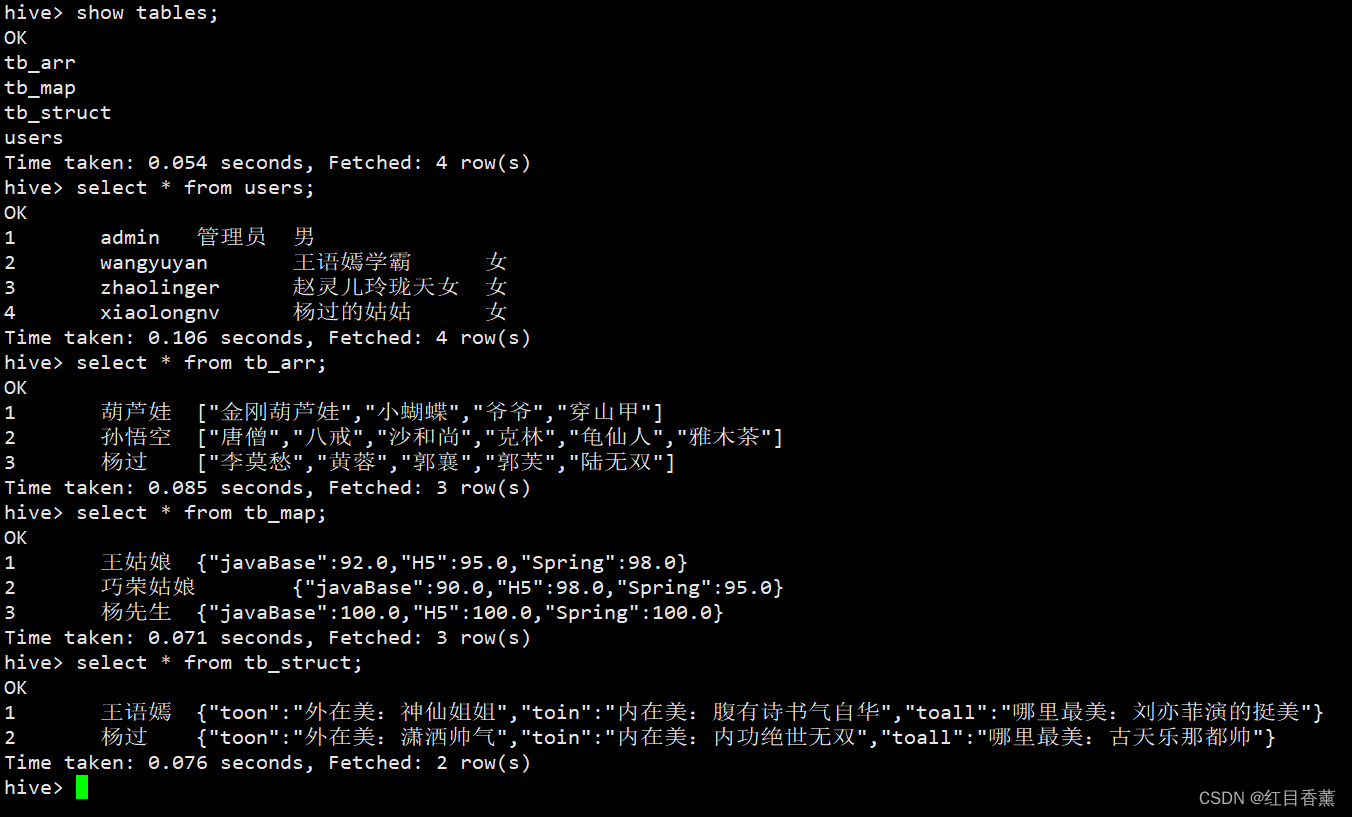

1、基础查询语句

那么,可以根据它来查询任何表,都会显示数据的。

2、数组查询

通过下标的方式处理数据

where筛选

like模糊查询

between……and……

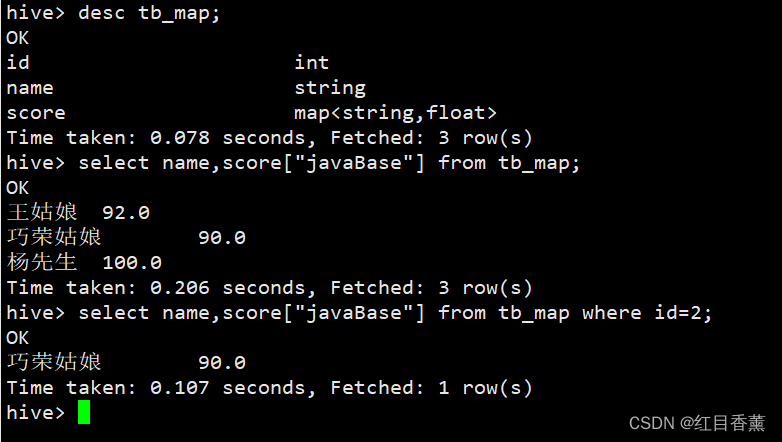

3、map

语法就是【列名】["keyName"]就可以获取值了。

结构查询

map查询

where查询

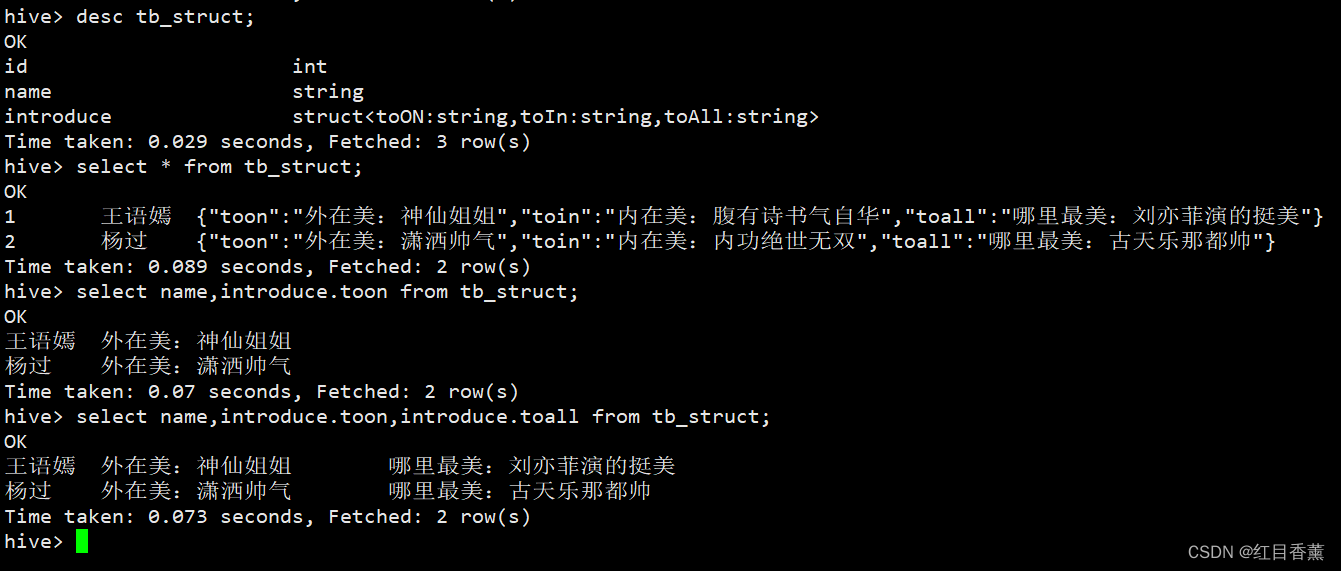

4、struct

struct获取信息需要使用【.】来处理,以下是示例:

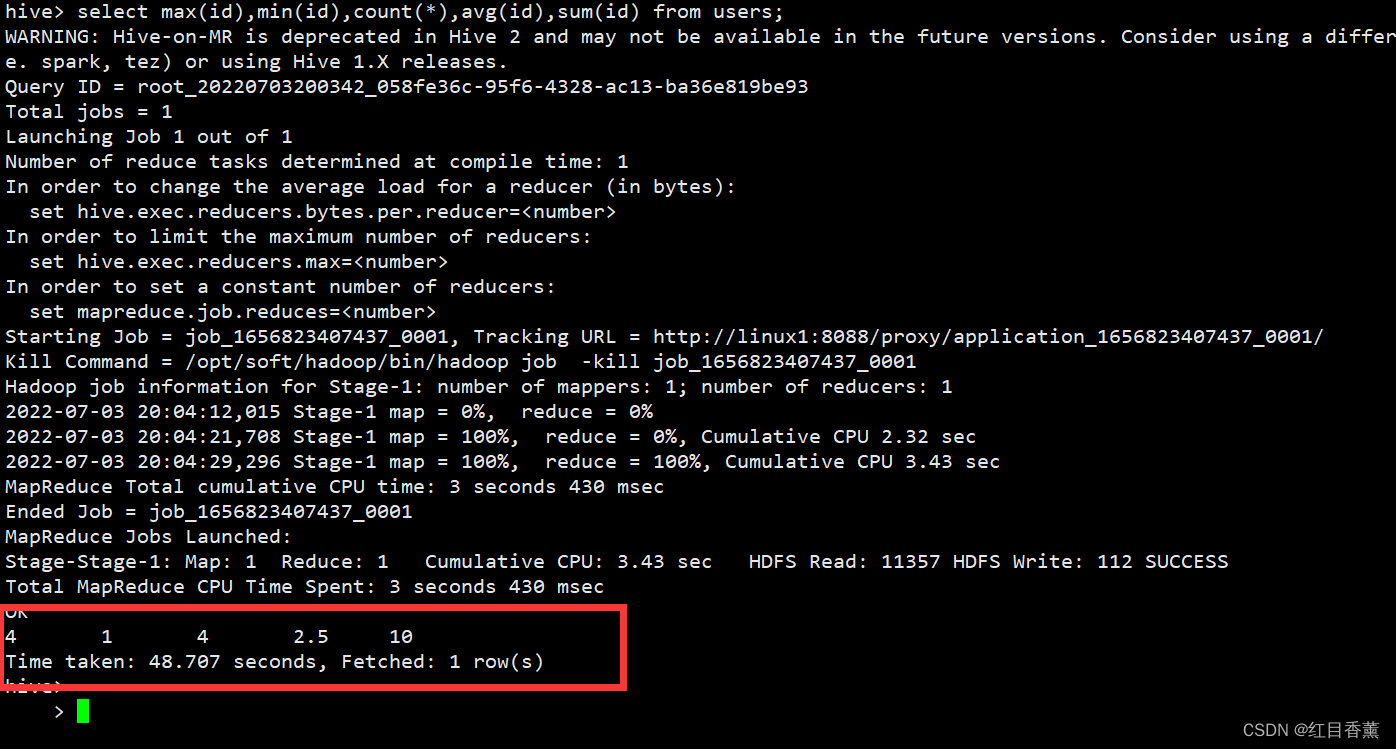

5、聚合查询语句

max/min/count/avg/sum

HQL查询内容全:

第一部分:

- hive模糊搜索表:

show tables like '*name*'; - 查看表结构信息:

desc table_name; - 查看分区信息:

show partitions table_name; - 加载本地文件:

load data local inpath '/xxx/test.txt' overwrite into table dm.table_name; - 从查询语句给table插入数据:

insert overwrite table table_name partition(dt) select * from table_name; - 导出数据到本地系统:

insert overwrite local directory '/tmp/text' select a.* from table_name a order by 1; - 创建表时指定的一些属性:

- 字段分隔符:

row format delimited fields terminated by '\t' - 行分隔符:

row format delimited lines terminated by '\n' - 文件格式为文本型存储:

stored as textfile

- 命令行操作:

hive -e 'select table_cloum from table'执行一个查询,在终端上显示mapreduce的进度,执行完毕后,最后把查询结果输出到终端上,接着hive进程退出,不会进入交互模式

hive -S -e 'select table_cloum from table' -S,终端上的输出不会有mapreduce的进度,执行完毕,只会把查询结果输出到终端上。

- hive修改表名:

alter table old_table_name rename to new_table_name; - hive复制表结构:

create table new_table_name like table_name; - hive添加字段:

alter table table_name add columns(columns_values bigint comment 'comm_text'); - hive修改字段:

alter table table_name change old_column new_column string comment 'comm_text'; - 删除分区:

alter table table_name drop partition(dt='2021-11-30'); - 添加分区:

alter table table_name add partition (dt='2021-11-30'); - 删除空数据库:

drop database myhive2; - 强制删除数据库:

drop database myhive2 cascade; - 删除表:

drop table score5; - 清空表:

truncate table score6; - 向hive表中加载数据

- 直接向分区表中插入数据:

insert into table score partition(month ='202107') values ('001','002','100'); - 通过load方式加载数据:

load data local inpath '/export/servers/hivedatas/score.csv' overwrite into table score partition(month='201806'); - 通过查询方式加载数据:

insert overwrite table score2 partition(month = '202106') select s_id,c_id,s_score from score1; - 查询语句中创建表并加载数据:

create table score2 as select * from score1; - 在创建表是通过location指定加载数据的路径:

create external table score6 (s_id string,c_id string,s_score int) row format delimited fields terminated by ',' location '/myscore'; - export导出与import 导入 hive表数据(内部表操作):

create table techer2 like techer; --依据已有表结构创建表

export table techer to '/export/techer';

import table techer2 from '/export/techer';

20. hive表中数据导出

- insert导出

将查询的结果导出到本地: insert overwrite local directory '/export/servers/exporthive' select * from score;

将查询的结果格式化导出到本地:insert overwrite local directory '/export/servers/exporthive' row format delimited fields terminated by '\t' collection items terminated by '#' select * from student;

将查询的结果导出到HDFS上(没有local):insert overwrite directory '/export/servers/exporthive' row format delimited fields terminated by '\t' collection items terminated by '#' select * from score;

- Hadoop命令导出到本地:

dfs -get /export/servers/exporthive/000000_0 /export/servers/exporthive/local.txt; - hive shell 命令导出

基本语法:(hive -f/-e 执行语句或者脚本 > file) hive -e "select * from myhive.score;" > /export/servers/exporthive/score.txt

hive -f export.sh > /export/servers/exporthive/score.txt

- export导出到HDFS上:

export table score to '/export/exporthive/score';

Hive查询语句

- GROUP BY 分组:

select s_id ,avg(s_score) avgscore from score group by s_id having avgscore > 85;对分组后的数据进行筛选,使用 having - join 连接:inner join 内连接;left join 左连接;right join 右链接;full join 全外链接。

- order by 排序:ASC(ascend): 升序(默认) DESC(descend): 降序

- sort by 局部排序:每个MapReduce内部进行排序,对全局结果集来说不是排序。

- distribute by 分区排序:类似MR中partition,进行分区,结合sort by使用

Hive函数

1. 聚合函数

- 指定列值的数目:count()

- 指定列值求和:sum()

- 指定列的最大值:max()

- 指定列的最小值:min()

- 指定列的平均值:avg()

- 非空集合总体变量函数:var_pop(col)

- 非空集合样本变量函数:var_samp (col)

- 总体标准偏离函数:stddev_pop(col)

- 分位数函数:percentile(BIGINT col, p)

- 中位数函数:percentile(BIGINT col, 0.5)

2. 关系运算

- A LIKE B: LIKE比较,如果字符串A符合表达式B 的正则语法,则为TRUE

- A RLIKE B:JAVA的LIKE操作,如果字符串A符合JAVA正则表达式B的正则语法,则为TRUE

- A REGEXP B:功能与RLIKE相同

3. 数学运算

支持所有数值类型:加(+)、减(-)、乘(*)、除(/)、取余(%)、位与(&)、位或(|)、位异或(^)、位取反(~)

4. 逻辑运算

支持:逻辑与(and)、逻辑或(or)、逻辑非(not)

5. 数值运算

- 取整函数:round(double a)

- 指定精度取整函数:round(double a, int d)

- 向下取整函数:floor(double a)

- 向上取整函数:ceil(double a)

- 取随机数函数:rand(),rand(int seed)

- 自然指数函数:exp(double a)

- 以10为底对数函数:log10(double a)

- 以2为底对数函数:log2()

- 对数函数:log()

- 幂运算函数:pow(double a, double p)

- 开平方函数:sqrt(double a)

- 二进制函数:bin(BIGINT a)

- 十六进制函数:hex()

- 绝对值函数:abs()

- 正取余函数:pmod()

6. 条件函数

- if

- case when

- coalesce(c1,c2,c3)

- nvl(c1,c2)

7. 日期函数

- 获得当前时区的UNIX时间戳: unix_timestamp()

- 时间戳转日期函数:from_unixtime()

- 日期转时间戳:unix_timestamp(string date)

- 日期时间转日期函数:to_date(string timestamp)

- 日期转年函数:year(string date)

- 日期转月函数:month (string date)

- 日期转天函数: day (string date)

- 日期转小时函数: hour (string date)

- 日期转分钟函数:minute (string date)

- 日期转秒函数: second (string date)

- 日期转周函数: weekofyear (string date)

- 日期比较函数: datediff(string enddate, string startdate)

- 日期增加函数: date_add(string startdate, int days)

- 日期减少函数:date_sub (string startdate, int days)

8. 字符串函数

- 字符串长度函数:length(string A)

- 字符串反转函数:reverse(string A)

- 字符串连接函数: concat(string A, string B…)

- 带分隔符字符串连接函数:concat_ws(string SEP, string A, string B…)

- 字符串截取函数: substr(string A, int start, int len)

- 字符串转大写函数: upper(string A)

- 字符串转小写函数:lower(string A)

- 去空格函数:trim(string A)

- 左边去空格函数:ltrim(string A)

- 右边去空格函数:rtrim(string A)

- 正则表达式替换函数: regexp_replace(string A, string B, string C)

- 正则表达式解析函数: regexp_extract(string subject, string pattern, int index)

- URL解析函数:parse_url(string urlString, string partToExtract [, string keyToExtract]) 返回值: string

- json解析函数:get_json_object(string json_string, string path)

- 空格字符串函数:space(int n)

- 重复字符串函数:repeat(string str, int n)

- 首字符ascii函数:ascii(string str)

- 左补足函数:lpad(string str, int len, string pad)

- 右补足函数:rpad(string str, int len, string pad)

- 分割字符串函数: split(string str, string pat)

- 集合查找函数: find_in_set(string str, string strList)

9. 窗口函数

- 分组求和函数:

sum(pv) over(partition by cookieid order by createtime)有坑,加不加 order by 差别很大,具体详情在下面第二部分。 - 分组内排序,从1开始顺序排:ROW_NUMBER() 如:1234567

- 分组内排序,排名相等会在名次中留下空位:RANK() 如:1233567

- 分组内排序,排名相等不会在名次中留下空位:DENSE_RANK() 如:1233456

- 有序的数据集合平均分配到指定的数量(num)个桶中:NTILE()

- 统计窗口内往上第n行值:LAG(col,n,DEFAULT)

- 统计窗口内往下第n行值:LEAD(col,n,DEFAULT)

- 分组内排序后,截止到当前行,第一个值:FIRST_VALUE(col)

- 分组内排序后,截止到当前行,最后一个值: LAST_VALUE(col)

- 小于等于当前值的行数/分组内总行数:CUME_DIST()

以下函数建议看第二部分详细理解下,此处仅简写,!

- 将多个group by 逻辑写在一个sql语句中: GROUPING SETS

- 根据GROUP BY的维度的所有组合进行聚合:CUBE

- CUBE的子集,以最左侧的维度为主,从该维度进行层级聚合:ROLLUP

第二部分

1. 对数据库的操作

- 创建数据库:

- 修改数据库:

说明:可以使用alter database 命令来修改数据库的一些属性。但是数据库的元数据信息是不可更改的,包括数据库的名称以及数据库所在的位置

- 查看数据库详细信息

- 删除数据库

2. 对数据表的操作

对管理表(内部表)的操作:

- 建内部表:

- hive建表时候的字段类型:

| 分类 | 类型 | 描述 | 字面量示例 |

|---|

对decimal类型简单解释下:

用法:decimal(11,2) 代表最多有11位数字,其中后2位是小数,整数部分是9位;如果整数部分超过9位,则这个字段就会变成null;如果小数部分不足2位,则后面用0补齐两位,如果小数部分超过两位,则超出部分四舍五入

也可直接写 decimal,后面不指定位数,默认是 decimal(10,0) 整数10位,没有小数

- 创建表并指定字段之间的分隔符

row format delimited fields terminated by '\t' 指定字段分隔符,默认分隔符为 '\001'

stored as 指定存储格式

location 指定存储位置

- 根据查询结果创建表

- 根据已经存在的表结构创建表

- 查询表的结构

- 查询创建表的语句

对外部表操作

外部表因为是指定其他的hdfs路径的数据加载到表当中来,所以hive表会认为自己不完全独占这份数据,所以删除hive表的时候,数据仍然存放在hdfs当中,不会删掉,只会删除表的元数据

- 构建外部表

- 从本地文件系统向表中加载数据

- 从hdfs文件系统向表中加载数据

- 注意:

1.使用 load data local 表示从本地文件系统加载,文件会拷贝到hdfs上

2.使用 load data 表示从hdfs文件系统加载,文件会直接移动到hive相关目录下,注意不是拷贝过去,因为hive认为hdfs文件已经有3副本了,没必要再次拷贝了

3.如果表是分区表,load 时不指定分区会报错

4.如果加载相同文件名的文件,会被自动重命名

对分区表的操作

- 创建分区表的语法

- 创建一个表带多个分区

注意:

hive表创建的时候可以用 location 指定一个文件或者文件夹,当指定文件夹时,hive会加载文件夹下的所有文件,当表中无分区时,这个文件夹下不能再有文件夹,否则报错

当表是分区表时,比如 partitioned by (day string), 则这个文件夹下的每一个文件夹就是一个分区,且文件夹名为 day=20201123 这种格式,然后使用:msck repair table score; 修复表结构,成功之后即可看到数据已经全部加载到表当中去了

- 加载数据到一个分区的表中

- 加载数据到一个多分区的表中去

- 查看分区

- 添加一个分区

- 同时添加多个分区

注意:添加分区之后就可以在hdfs文件系统当中看到表下面多了一个文件夹

- 删除分区

对分桶表操作

将数据按照指定的字段进行分成多个桶中去,就是按照分桶字段进行哈希划分到多个文件当中去

分区就是分文件夹,分桶就是分文件

分桶优点:

1. 提高join查询效率

2. 提高抽样效率

- 开启hive的捅表功能

- 设置reduce的个数

- 创建桶表

桶表的数据加载:由于桶表的数据加载通过hdfs dfs -put文件或者通过load data均不可以,只能通过insert overwrite 进行加载

所以把文件加载到桶表中,需要先创建普通表,并通过insert overwrite的方式将普通表的数据通过查询的方式加载到桶表当中去

- 通过insert overwrite给桶表中加载数据

修改表和删除表

- 修改表名称

- 增加/修改列信息

- 删除表操作

- 清空表操作

注意:truncate 和 drop:

如果 hdfs 开启了回收站,drop 删除的表数据是可以从回收站恢复的,表结构恢复不了,需要自己重新创建;truncate 清空的表是不进回收站的,所以无法恢复truncate清空的表

所以 truncate 一定慎用,一旦清空将无力回天

向hive表中加载数据

- 直接向分区表中插入数据

- 通过load方式加载数据

- 通过查询方式加载数据

- 查询语句中创建表并加载数据

- 在创建表是通过location指定加载数据的路径

- export导出与import 导入 hive表数据(内部表操作)

hive表中数据导出

- insert导出

- Hadoop命令导出到本地

- hive shell 命令导出

- export导出到HDFS上

hive的DQL查询语法

单表查询

注意:

1、order by 会对输入做全局排序,因此只有一个reducer,会导致当输入规模较大时,需要较长的计算时间。

2、sort by不是全局排序,其在数据进入reducer前完成排序。因此,如果用sort by进行排序,并且设置mapred.reduce.tasks>1,则sort by只保证每个reducer的输出有序,不保证全局有序。

3、distribute by(字段)根据指定的字段将数据分到不同的reducer,且分发算法是hash散列。

4、Cluster by(字段) 除了具有Distribute by的功能外,还会对该字段进行排序。

因此,如果分桶和sort字段是同一个时,此时,cluster by = distribute by + sort by

- WHERE语句

注意:

小于某个值是不包含null的,如上查询结果是把 s_score 为 null 的行剔除的

- GROUP BY 分组

注意:

如果使用 group by 分组,则 select 后面只能写分组的字段或者聚合函数

where和having区别:

1 having是在 group by 分完组之后再对数据进行筛选,所以having 要筛选的字段只能是分组字段或者聚合函数

2 where 是从数据表中的字段直接进行的筛选的,所以不能跟在gruop by后面,也不能使用聚合函数

- join 连接

注:1. hive2版本已经支持不等值连接,就是 join on条件后面可以使用大于小于符号了;并且也支持 join on 条件后跟or (早前版本 on 后只支持 = 和 and,不支持 > < 和 or)

2.如hive执行引擎使用MapReduce,一个join就会启动一个job,一条sql语句中如有多个join,则会启动多个job

注意:表之间用逗号(,)连接和 inner join 是一样的

select * from table_a,table_b where table_a.id=table_b.id;

它们的执行效率没有区别,只是书写方式不同,用逗号是sql 89标准,join 是sql 92标准。用逗号连接后面过滤条件用 where ,用 join 连接后面过滤条件是 on。

- order by 排序

注意:order by 是全局排序,所以最后只有一个reduce,也就是在一个节点执行,如果数据量太大,就会耗费较长时间

- sort by 局部排序

- distribute by 分区排序

注意:Hive要求 distribute by 语句要写在 sort by 语句之前

- cluster by

Hive函数

聚合函数

注意:

聚合操作时要注意null值

count(*) 包含null值,统计所有行数

count(id) 不包含null值

min 求最小值是不包含null,除非所有值都是null

avg 求平均值也是不包含null

- 非空集合总体变量函数: var_pop

- 非空集合样本变量函数: var_samp

- 总体标准偏离函数: stddev_pop

- 中位数函数: percentile

关系运算

- LIKE比较: LIKE

- JAVA的LIKE操作: RLIKE

- REGEXP操作: REGEXP

数学运算

逻辑运算

数值运算

- 取整函数: round

- 指定精度取整函数: round

- 向下取整函数: floor

- 向上取整函数: ceil

- 取随机数函数: rand

- 自然指数函数: exp

- 以10为底对数函数: log10

此外还有:以2为底对数函数: log2()、对数函数: log()

- 幂运算函数: pow

- 开平方函数: sqrt

- 二进制函数: bin

十六进制函数: hex()、将十六进制转化为字符串函数: unhex()

进制转换函数: conv(bigint num, int from_base, int to_base) 说明: 将数值num从from_base进制转化到to_base进制

此外还有很多数学函数: 绝对值函数: abs()、正取余函数: pmod()、正弦函数: sin()、反正弦函数: asin()、余弦函数: cos()、反余弦函数: acos()、positive函数: positive()、negative函数: negative()

条件函数

- If函数: if

- 非空查找函数: coalesce

- 条件判断函数:case when (两种写法,其一)

- 条件判断函数:case when (两种写法,其二)

日期函数

注:以下SQL语句中的 from tableName 可去掉,不影响查询结果

- 获取当前UNIX时间戳函数: unix_timestamp

- UNIX时间戳转日期函数: from_unixtime

- 日期转UNIX时间戳函数: unix_timestamp

- 指定格式日期转UNIX时间戳函数: unix_timestamp

- 日期时间转日期函数: to_date

- 日期转年函数: year

- 日期转月函数: month

- 日期转天函数: day

- 日期转小时函数: hour

- 日期转分钟函数: minute

- 日期转秒函数: second

- 日期转周函数: weekofyear

- 日期比较函数: datediff

- 日期增加函数: date_add

- 日期减少函数: date_sub

字符串函数

- 字符串长度函数:length

- 字符串反转函数:reverse

- 字符串连接函数:concat

- 带分隔符字符串连接函数:concat_ws

- 字符串截取函数:substr,substring

- 字符串截取函数:substr,substring

- 字符串转大写函数:upper,ucase

- 字符串转小写函数:lower,lcase

- 去空格函数:trim

- 左边去空格函数:ltrim

- 右边去空格函数:rtrim

- 正则表达式替换函数:regexp_replace

- 正则表达式解析函数:regexp_extract

- URL解析函数:parse_url

- json解析函数:get_json_object

- 空格字符串函数:space

- 重复字符串函数:repeat

- 首字符ascii函数:ascii

- 左补足函数:lpad

- 右补足函数:rpad

- 分割字符串函数: split

- 集合查找函数: find_in_set

复合类型构建操作

- Map类型构建: map

- Struct类型构建: struct

- array类型构建: array

复杂类型访问操作

- array类型访问: A[n]

- map类型访问: M[key]

- struct类型访问: S.x

复杂类型长度统计函数

- Map类型长度函数: size(Map<k .V>)

- array类型长度函数: size(Array)

- 类型转换函数 ***

hive当中的lateral view 与 explode以及reflect

使用explode函数将hive表中的Map和Array字段数据进行拆分

lateral view用于和split、explode等UDTF一起使用的,能将一行数据拆分成多行数据,在此基础上可以对拆分的数据进行聚合,lateral view首先为原始表的每行调用UDTF,UDTF会把一行拆分成一行或者多行,lateral view在把结果组合,产生一个支持别名表的虚拟表。

其中explode还可以用于将hive一列中复杂的array或者map结构拆分成多行

需求:现在有数据格式如下

字段之间使用\t分割,需求将所有的child进行拆开成为一列

将map的key和value也进行拆开,成为如下结果

- 创建hive数据库

- 创建hive表,然后使用explode拆分map和array

- 加载数据

- 使用explode将hive当中数据拆开

使用explode拆分json字符串

需求: 需求:现在有一些数据格式如下:

其中字段与字段之间的分隔符是 |

我们要解析得到所有的monthSales对应的值为以下这一列(行转列)

4900

2090

6987

- 创建hive表

- 准备数据并加载数据

- 使用explode拆分Array

- 使用explode拆解Map

- 拆解json字段

配合LATERAL VIEW使用

配合lateral view查询多个字段

也可以多重使用

最终,我们可以通过下面的句子,把这个json格式的一行数据,完全转换成二维表的方式展现

总结:

Lateral View通常和UDTF一起出现,为了解决UDTF不允许在select字段的问题。 Multiple Lateral View可以实现类似笛卡尔乘积。 Outer关键字可以把不输出的UDTF的空结果,输出成NULL,防止丢失数据。

行转列

相关参数说明:

CONCAT(string A/col, string B/col…):返回输入字符串连接后的结果,支持任意个输入字符串;

CONCAT_WS(separator, str1, str2,...):它是一个特殊形式的 CONCAT()。第一个参数剩余参数间的分隔符。分隔符可以是与剩余参数一样的字符串。如果分隔符是 NULL,返回值也将为 NULL。这个函数会跳过分隔符参数后的任何 NULL 和空字符串。分隔符将被加到被连接的字符串之间;

COLLECT_SET(col):函数只接受基本数据类型,它的主要作用是将某字段的值进行去重汇总,产生array类型字段。

数据准备:

| name | constellation | blood_type |

|---|

需求: 把星座和血型一样的人归类到一起。结果如下:

实现步骤:

- 创建本地constellation.txt,导入数据

- 创建hive表并导入数据

- 按需求查询数据

列转行

所需函数:

EXPLODE(col):将hive一列中复杂的array或者map结构拆分成多行。

LATERAL VIEW

用法:LATERAL VIEW udtf(expression) tableAlias AS columnAlias

解释:用于和split, explode等UDTF一起使用,它能够将一列数据拆成多行数据,在此基础上可以对拆分后的数据进行聚合。

数据准备:

需求: 将电影分类中的数组数据展开。结果如下:

实现步骤:

- 创建hive表

- 加载数据

- 按需求查询数据

reflect函数

reflect函数可以支持在sql中调用java中的自带函数,秒杀一切udf函数。

需求1: 使用java.lang.Math当中的Max求两列中最大值

实现步骤:

- 创建hive表

- 准备数据并加载数据

- 加载数据

- 使用java.lang.Math当中的Max求两列当中的最大值

需求2: 文件中不同的记录来执行不同的java的内置函数

实现步骤:

- 创建hive表

- 准备数据

- 加载数据

- 执行查询

需求3: 判断是否为数字

实现方式:

使用apache commons中的函数,commons下的jar已经包含在hadoop的classpath中,所以可以直接使用。

Hive 窗口函数

窗口函数最重要的关键字是 partition by 和 order by

具体语法如下:XXX over (partition by xxx order by xxx)

特别注意:over()里面的 partition by 和 order by 都不是必选的,over()里面可以只有partition by,也可以只有order by,也可以两个都没有,大家需根据需求灵活运用。

窗口函数我划分了几个大类,我们一类一类的讲解。

1. SUM、AVG、MIN、MAX

讲解这几个窗口函数前,先创建一个表,以实际例子讲解大家更容易理解。

首先创建用户访问页面表:user_pv

给上面这个表加上如下数据:

- SUM()使用

执行如下查询语句:

- 点赞

- 收藏

- 关注作者

评论(0)