GPU — 分布式训练

【摘要】

目录

文章目录

目录

分布式训练的挑战

算法挑战

工程挑战

NCCL

MPI

分布式训练的挑战

算法挑战

数...

目录

分布式训练的挑战

算法挑战

- 数据并行或模型并行

- 同步或异步

- 批量较大,影响模型精度

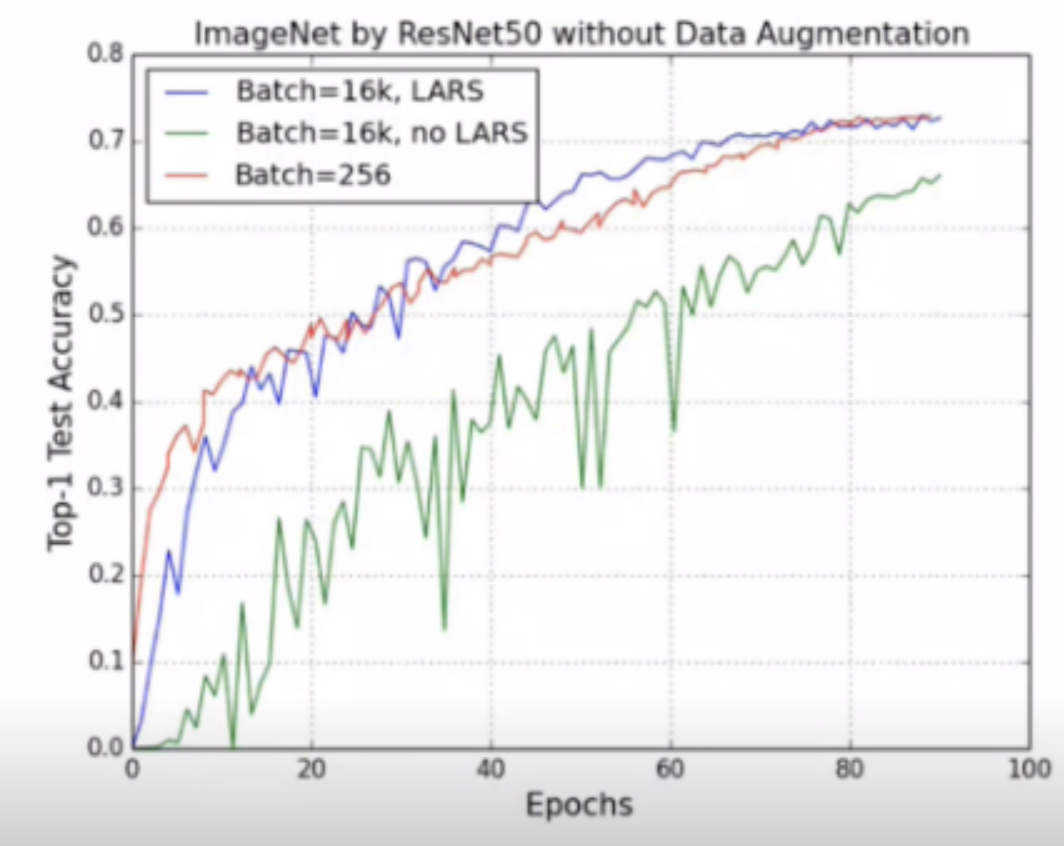

- 热身,调整学习速率(线性上升,LARC/LARS)

- 给渐变添加噪声

- 优化器的选择(SGD,Momentum,Adam,Rmsprop)

- 平衡速度和准确性

工程挑战

- CPU 和 GPU 性能提升不平衡

- 先纵向扩展,再横向扩展

- GPU 型号,NVLink,NVSwitch,DGX,10G/25G/100G/200G 的匹配和选择

- 混合精度

- GPU Direct RDMA(Infiniband)

- 从 CPU 中卸载一些操作到 GPU(e.g. 数据预

文章来源: is-cloud.blog.csdn.net,作者:范桂飓,版权归原作者所有,如需转载,请联系作者。

原文链接:is-cloud.blog.csdn.net/article/details/125775165

【版权声明】本文为华为云社区用户转载文章,如果您发现本社区中有涉嫌抄袭的内容,欢迎发送邮件进行举报,并提供相关证据,一经查实,本社区将立刻删除涉嫌侵权内容,举报邮箱:

cloudbbs@huaweicloud.com

- 点赞

- 收藏

- 关注作者

评论(0)