激活函数

【摘要】

一,激活函数

我们用激活函数,来表示不同强度的信号是否激活了神经元,这是这个名字的来由。

主要作用是提供网络的非线性建模能力。

也就是说,需要一个递增函数,定义域是R,值域是0到1的区间(开区间还是闭区间不重要)。

这个激活函数是用来把特征值转化成0-1的数的,这样,整个网络就不是简单的线性计算了。

然而实际上,激活函数本...

一,激活函数

我们用激活函数,来表示不同强度的信号是否激活了神经元,这是这个名字的来由。

主要作用是提供网络的非线性建模能力。

也就是说,需要一个递增函数,定义域是R,值域是0到1的区间(开区间还是闭区间不重要)。

这个激活函数是用来把特征值转化成0-1的数的,这样,整个网络就不是简单的线性计算了。

然而实际上,激活函数本质上就是用于特征值的转化,值域是不是0-1的区间并不是关键。

二,线性整流函数

线性整流函数即修正线性单元(Rectified Linear Unit, ReLU)

1,斜坡函数

数学表达式:![]()

神经网络中的表达式:![]()

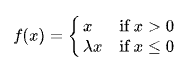

2,带泄露线性整流函数(Leaky ReLU)

3,噪声线性整流(Noisy ReLU)

噪声线性整流(Noisy ReLU)是修正线性单元在考虑高斯噪声的基础上进行改进的变种激活函数,加上了一定程度的正态分布的不确定性。

![]()

三,Sigmoid

四,tanh

文章来源: blog.csdn.net,作者:csuzhucong,版权归原作者所有,如需转载,请联系作者。

原文链接:blog.csdn.net/nameofcsdn/article/details/120973587

【版权声明】本文为华为云社区用户转载文章,如果您发现本社区中有涉嫌抄袭的内容,欢迎发送邮件进行举报,并提供相关证据,一经查实,本社区将立刻删除涉嫌侵权内容,举报邮箱:

cloudbbs@huaweicloud.com

- 点赞

- 收藏

- 关注作者

评论(0)