决策树和随机森林(下)

【摘要】 上次探究了深度对决策树的影响,发现深度越大,容易发生过拟合 没错今天来说所谓的剪枝和随机森林

剪枝总体思路:

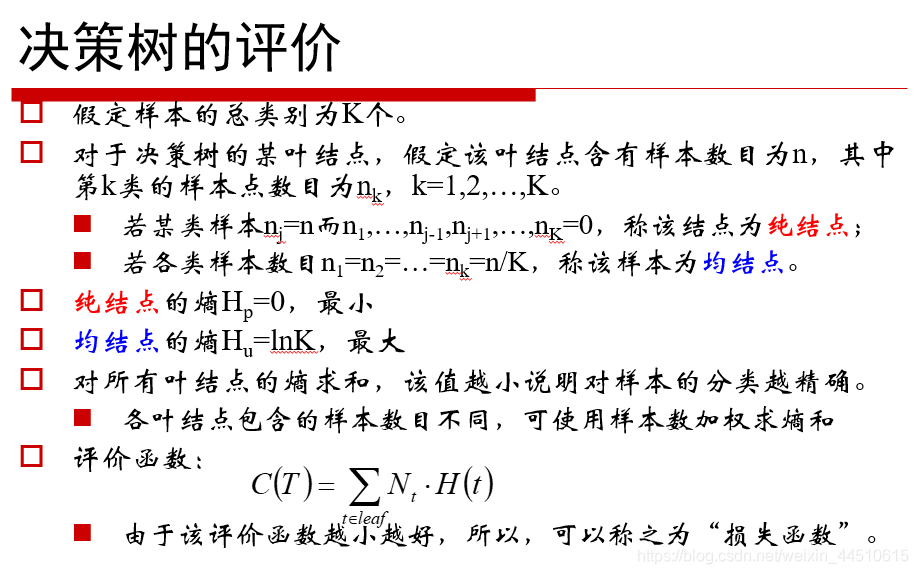

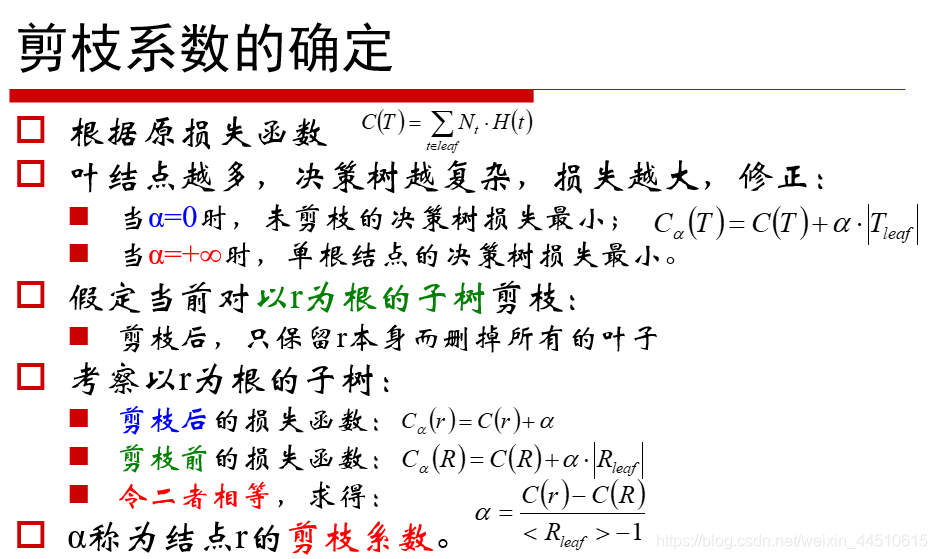

由完全树T0开始,剪枝部分结点得到T1,再次剪 枝部分结点得到T2…直到仅剩树根的树Tk;

在验证数据集上对这k个树分别评价,选择损失 函数最小的树Tα

首先了解上面是剪枝系数 但是主要用随机森林算法来防止过拟合,也是决策树的加强版

那什么...

上次探究了深度对决策树的影响,发现深度越大,容易发生过拟合

没错今天来说所谓的剪枝和随机森林

剪枝总体思路:

- 由完全树T0开始,剪枝部分结点得到T1,再次剪 枝部分结点得到T2…直到仅剩树根的树Tk;

- 在验证数据集上对这k个树分别评价,选择损失 函数最小的树Tα

首先了解上面是剪枝系数

但是主要用随机森林算法来防止过拟合,也是决策树的加强版

那什么是随机森林,就是多棵决策树组成,对样本和特征随便抽取,其实也是有放回抽样

探究深度对随机森林的影响

import numpy as np

import ma

- 1

文章来源: maoli.blog.csdn.net,作者:刘润森!,版权归原作者所有,如需转载,请联系作者。

原文链接:maoli.blog.csdn.net/article/details/89010914

【版权声明】本文为华为云社区用户转载文章,如果您发现本社区中有涉嫌抄袭的内容,欢迎发送邮件进行举报,并提供相关证据,一经查实,本社区将立刻删除涉嫌侵权内容,举报邮箱:

cloudbbs@huaweicloud.com

- 点赞

- 收藏

- 关注作者

评论(0)