[深度学习]CNN网络架构

【摘要】 系列内容深度学习CNN

文章目录

CNN网络架构图展示的卷积神经网络:卷积神经网络的层结构和全连接神经网络的层结构不同:卷积计算池化全连接

CNN网络架构

一个卷积神经网络由若干卷积层、Pooling层、全连接层组成。你可以构建各种不同的卷积神经网络,它的常用架构模式

INPUT -> [[CONV]*N -> POOL?]*M ...

| 系列 | 内容 |

|---|---|

| 深度学习 | CNN |

CNN网络架构

一个卷积神经网络由若干卷积层、Pooling层、全连接层组成。你可以构建各种不同的卷积神经网络,它的常用架构模式

INPUT -> [[CONV]*N -> POOL?]*M -> [FC]*K

也就是N个卷积层叠加,然后(可选)叠加一个Pooling层,重复这个结构M次,最后叠加K个全连接层。

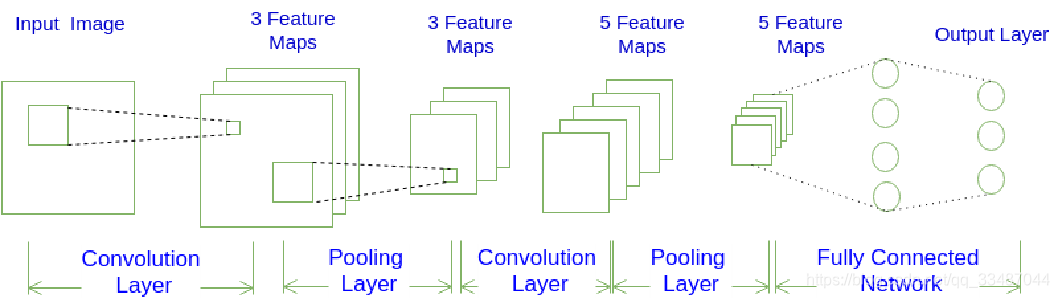

图展示的卷积神经网络:

- INPUT -> CONV -> POOL -> CONV -> POOL -> FC -> FC

按照上述模式可以表示为:

- INPUT -> [[CONV]*1 -> POOL]*2 -> [FC]*2

也就是:N=1, M=2, K=2。

卷积神经网络的层结构和全连接神经网络的层结构不同:

- 全连接神经网络每层的神经元是按照一维排列的,也就是排成一条线的样子

- 而卷积神经网络每层的神经元是按照三维排列的,也就是排成一个长方体的样子,有宽度、高度和深度

卷积计算

- 输入层的宽度和高度对应于输入图像的宽度和高度,而它的深度为1。

- 第一个卷积层对这幅图像进行了卷积操作,得到了三个Feature Map。这里的“3”是指这个卷积层包含三个Filter(也就是三套参数),每个Filter都可以把原始输入图像卷积得到一个Feature Map,三个Filter就可以得到三个Feature Map。

- 至于一个卷积层可以有多少个Filter,那是可以自由设定的。也就是说,卷积层的Filter个数也是一个超参数。我们可以把Feature Map可以看做是通过卷积变换提取到的图像特征,三个Filter就对原始图像提取出三组不同的特征,也就是得到了三个Feature Map,也称做三个通道(channel)。

池化

- 在第一个卷积层之后,Pooling层对三个Feature Map做了下采样,得到了三个更小的Feature Map。

- 接着,是第二个卷积层,它有5个Filter。每个Fitler都把前面下采样之后的3个**Feature Map卷积在一起,得到一个新的Feature Map。这样,5个Filter就得到了5个Feature Map。

- 接着,是第二个Pooling,继续对5个Feature Map进行下采样**,得到了5个更小的Feature Map。

全连接

图所示网络的最后两层是全连接层;

- 第一个全连接层的每个神经元,和上一层5个Feature Map中的每个神经元相连;

- 第二个全连接层(也就是输出层)的每个神经元,则和第一个全连接层的每个神经元相连,这样得到了整个网络的输出。

文章来源: xuesong.blog.csdn.net,作者:内核笔记,版权归原作者所有,如需转载,请联系作者。

原文链接:xuesong.blog.csdn.net/article/details/91355222

【版权声明】本文为华为云社区用户转载文章,如果您发现本社区中有涉嫌抄袭的内容,欢迎发送邮件进行举报,并提供相关证据,一经查实,本社区将立刻删除涉嫌侵权内容,举报邮箱:

cloudbbs@huaweicloud.com

- 点赞

- 收藏

- 关注作者

评论(0)