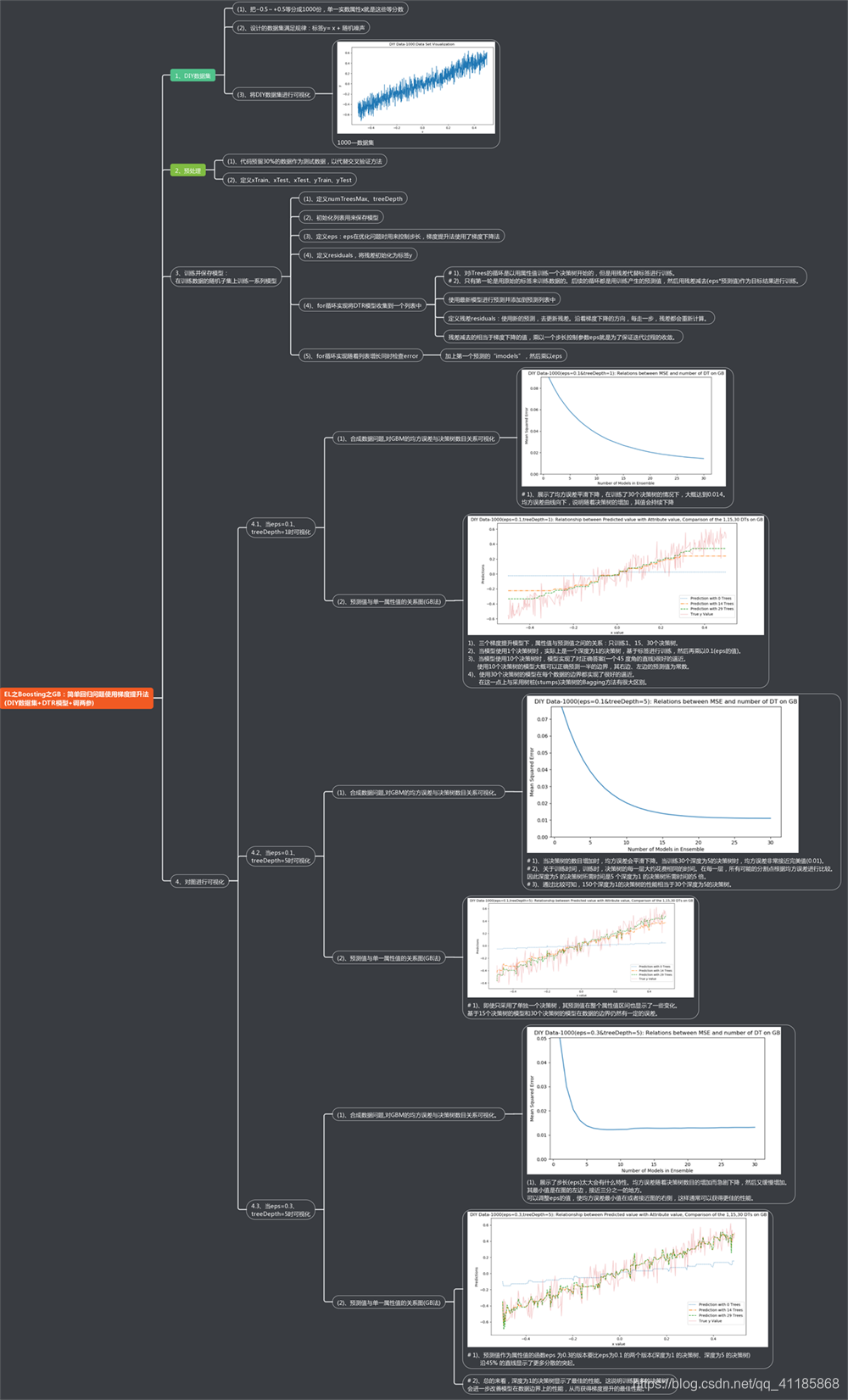

EL之Boosting之GB(DTR):简单回归问题使用梯度提升法(DIY数据集+DTR模型+调两参)

【摘要】 EL之Boosting之GB(DTR):简单回归问题使用梯度提升法(DIY数据集+DTR模型+调两参)

目录

输出结果

设计思路

核心代码

输出结果

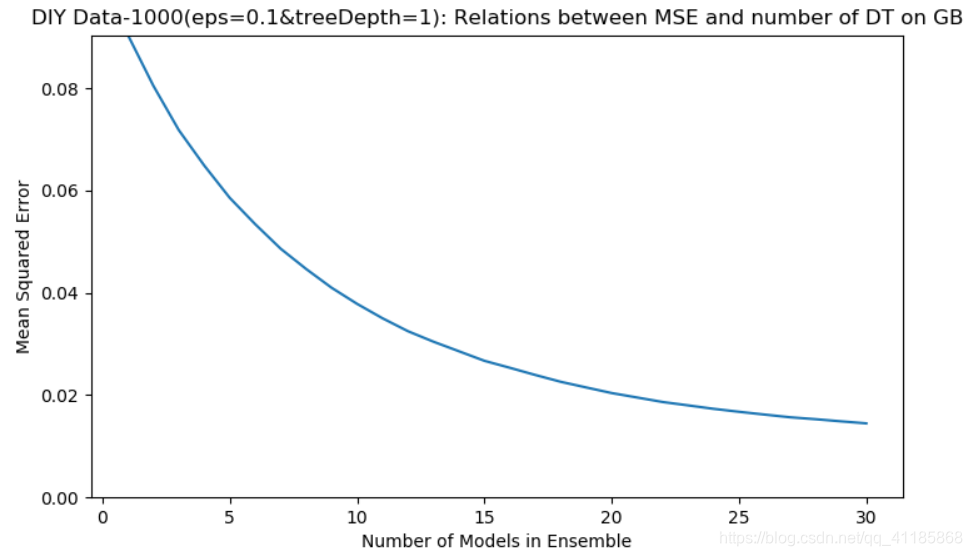

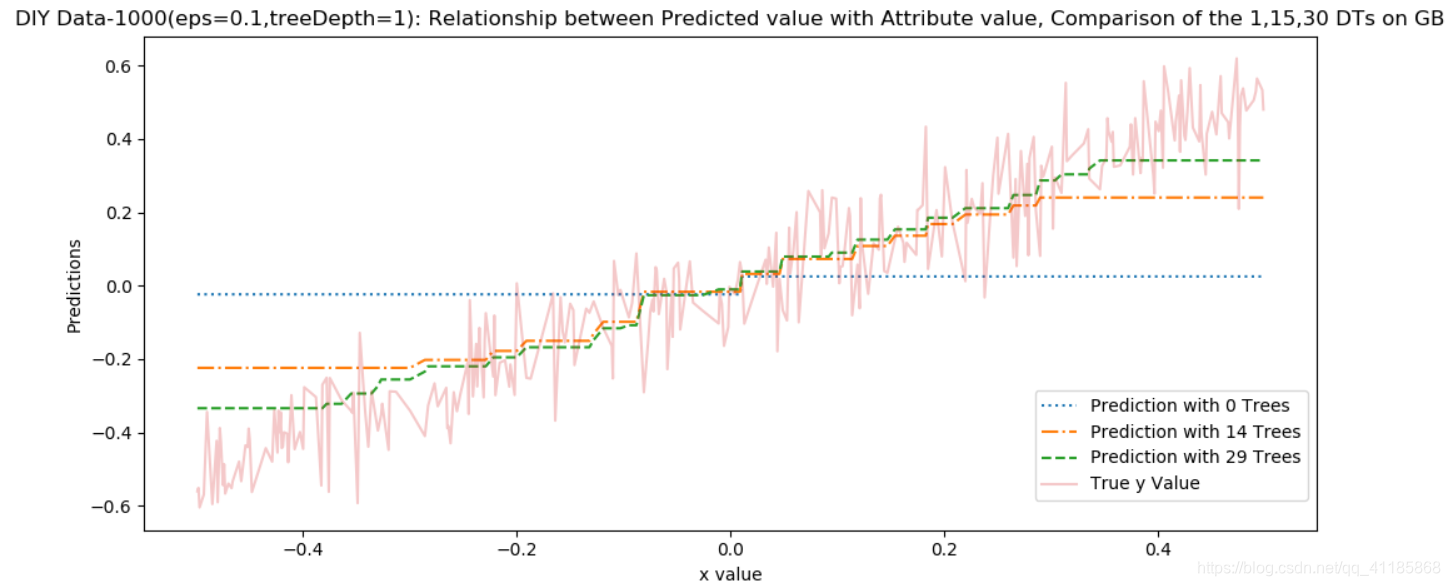

1、eps=0.1,treeDepth=1

2、eps=0.1,treeDepth=5

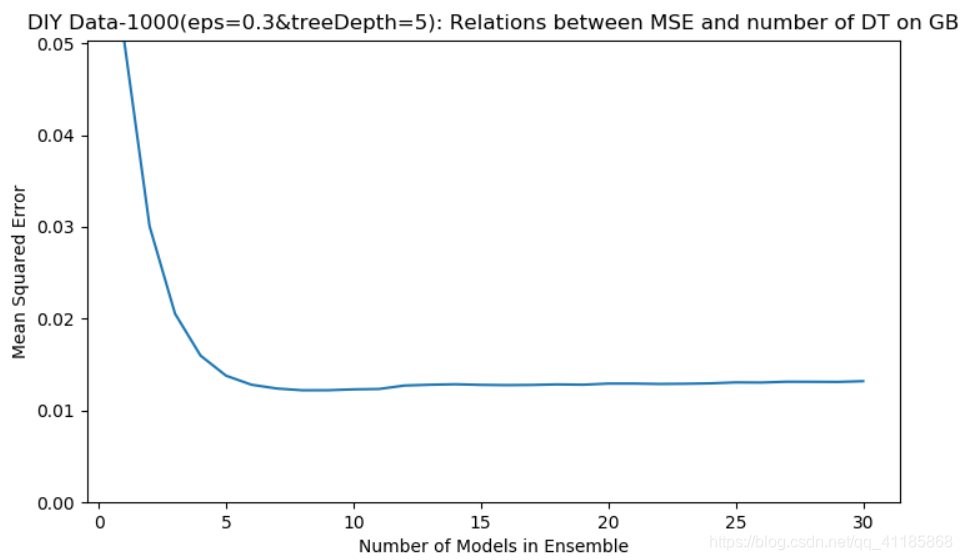

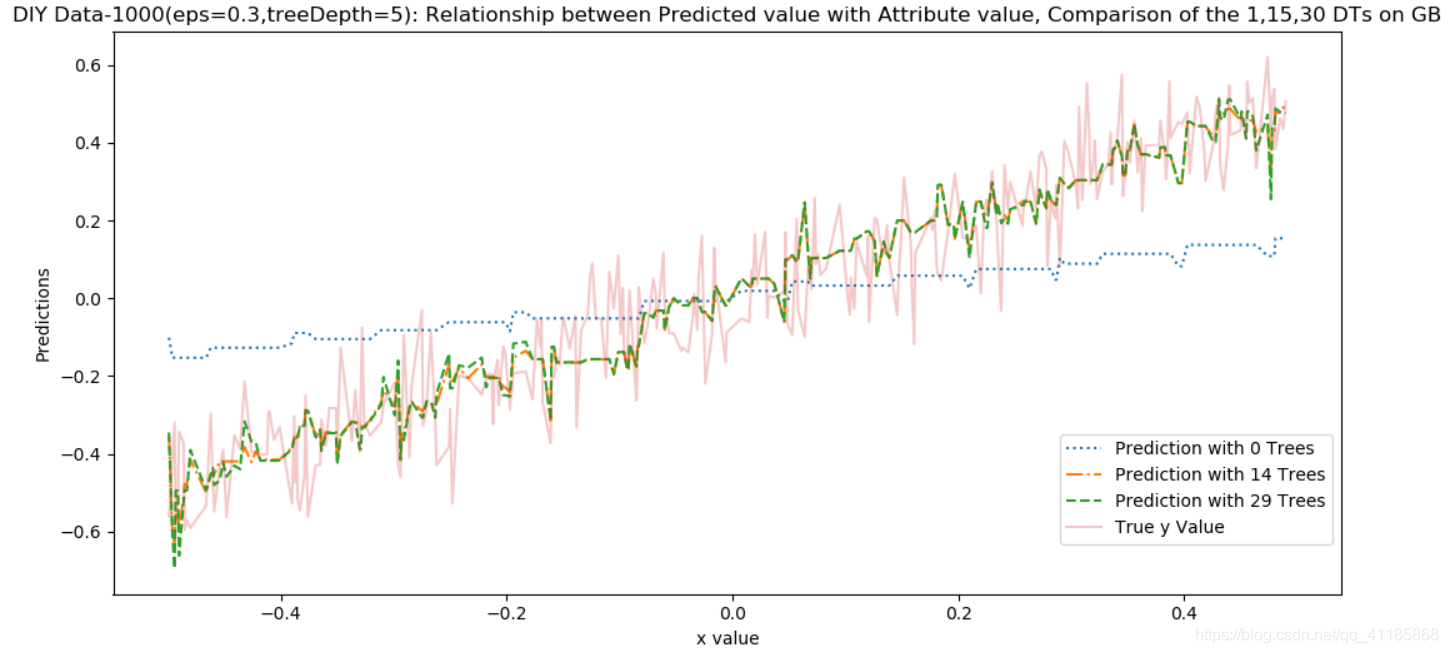

2、eps=0.3,treeDepth=5

设计思路

核心代码

f...

EL之Boosting之GB(DTR):简单回归问题使用梯度提升法(DIY数据集+DTR模型+调两参)

目录

输出结果

1、eps=0.1,treeDepth=1

2、eps=0.1,treeDepth=5

2、eps=0.3,treeDepth=5

设计思路

核心代码

-

for iTrees in range(numTreesMax):

-

-

modelList.append(DecisionTreeRegressor(max_depth=treeDepth))

-

modelList[-1].fit(xTrain, residuals)

-

-

latestInSamplePrediction = modelList[-1].predict(xTrain)

-

-

residuals = [residuals[i] - eps * latestInSamplePrediction[i] for i in range(len(residuals))]

-

-

latestOutSamplePrediction = modelList[-1].predict(xTest)

-

predList.append(list(latestOutSamplePrediction))

-

-

-

mse = []

-

allPredictions = []

-

for iModels in range(len(modelList)):

-

-

prediction = []

-

for iPred in range(len(xTest)):

-

prediction.append(sum([predList[i][iPred] for i in range(iModels + 1)]) * eps)

-

-

allPredictions.append(prediction)

-

errors = [(yTest[i] - prediction[i]) for i in range(len(yTest))]

-

mse.append(sum([e * e for e in errors]) / len(yTest))

文章来源: yunyaniu.blog.csdn.net,作者:一个处女座的程序猿,版权归原作者所有,如需转载,请联系作者。

原文链接:yunyaniu.blog.csdn.net/article/details/86033971

【版权声明】本文为华为云社区用户转载文章,如果您发现本社区中有涉嫌抄袭的内容,欢迎发送邮件进行举报,并提供相关证据,一经查实,本社区将立刻删除涉嫌侵权内容,举报邮箱:

cloudbbs@huaweicloud.com

- 点赞

- 收藏

- 关注作者

评论(0)