Sqoop快速入门系列(2) | Sqoop数据导入与导出

大家好,我是不温卜火,是一名计算机学院大数据专业大二的学生,昵称来源于成语—

不温不火,本意是希望自己性情温和。作为一名互联网行业的小白,博主写博客一方面是为了记录自己的学习过程,另一方面是总结自己所犯的错误希望能够帮助到很多和自己一样处于起步阶段的萌新。但由于水平有限,博客中难免会有一些错误出现,有纰漏之处恳请各位大佬不吝赐教!暂时只有csdn这一个平台,博客主页:https://buwenbuhuo.blog.csdn.net/

此篇为大家带来的是Sqoop数据导入与导出。

一. 导入数据

在Sqoop中,“导入”概念指:从非大数据集群(RDBMS)向大数据集群(HDFS,HIVE,HBASE)中传输数据,叫做:导入,即使用import关键字。

1. RDBMS到HDFS

- 确定Mysql服务开启正常

[bigdata@hadoop002 sqoop]$ mysql -uroot -p199712

- 1

- 在Mysql中新建一张表并插入一些数据

// 创建脚本

[bigdata@hadoop002 datas]$ vim company.sql

create database company;

use company;

create table staff(id int(4) primary key not null auto_increment, name varchar(255), sex varchar(255));

insert into staff(name, sex) values('Thomas', 'Male');

insert into staff(name, sex) values('Catalina', 'FeMale');

insert into staff(name, sex) values('Thomas', 'Male');

insert into staff(name, sex) values('Catalina', 'FeMale');

insert into staff(name, sex) values('Thomas', 'Male');

insert into staff(name, sex) values('Catalina', 'FeMale');

insert into staff(name, sex) values('Thomas', 'Male');

insert into staff(name, sex) values('Catalina', 'FeMale');

insert into staff(name, sex) values('Thomas', 'Male');

insert into staff(name, sex) values('Catalina', 'FeMale');

insert into staff(name, sex) values('Thomas', 'Male');

insert into staff(name, sex) values('Catalina', 'FeMale');

insert into staff(name, sex) values('Thomas', 'Male');

insert into staff(name, sex) values('Catalina', 'FeMale');

insert into staff(name, sex) values('Thomas', 'Male');

insert into staff(name, sex) values('Catalina', 'FeMale');

insert into staff(name, sex) values('Thomas', 'Male');

insert into staff(name, sex) values('Catalina', 'FeMale');

insert into staff(name, sex) values('Thomas', 'Male');

insert into staff(name, sex) values('Catalina', 'FeMale');

insert into staff(name, sex) values('Thomas', 'Male');

insert into staff(name, sex) values('Catalina', 'FeMale');

insert into staff(name, sex) values('Thomas', 'Male');

insert into staff(name, sex) values('Catalina', 'FeMale');

insert into staff(name, sex) values('Thomas', 'Male');

insert into staff(name, sex) values('Catalina', 'FeMale');

insert into staff(name, sex) values('Thomas', 'Male');

insert into staff(name, sex) values('Catalina', 'FeMale');

insert into staff(name, sex) values('Thomas', 'Male');

insert into staff(name, sex) values('Catalina', 'FeMale');

insert into staff(name, sex) values('Thomas', 'Male');

insert into staff(name, sex) values('Catalina', 'FeMale');

// 批量执行脚本

mysql> source /opt/module/datas/company.sql

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

- 15

- 16

- 17

- 18

- 19

- 20

- 21

- 22

- 23

- 24

- 25

- 26

- 27

- 28

- 29

- 30

- 31

- 32

- 33

- 34

- 35

- 36

- 37

- 38

- 39

- 40

- 41

- 42

// 查看是否成功

mysql> use company;

mysql> select * from staff;

- 1

- 2

- 3

- 4

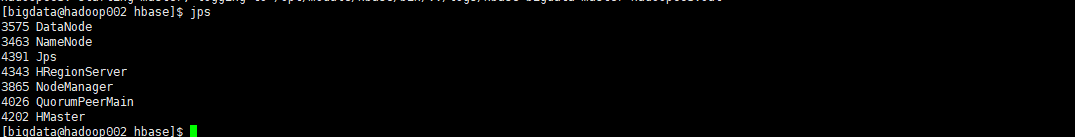

- 开启所需要的组件

[bigdata@hadoop002 datas]$ start-dfs.sh

[bigdata@hadoop003 module]$ start-yarn.sh

[bigdata@hadoop002 zookeeper-3.4.10]$ bin/start-allzk.sh

[bigdata@hadoop002 hbase]$ bin/start-hbase.sh

// 要起的服务和下图一样

- 1

- 2

- 3

- 4

- 5

- 6

- 导入数据

// (1)全表导入

[bigdata@hadoop002 sqoop]$ bin/sqoop import \

--connect jdbc:mysql://hadoop002:3306/company \

--username root \

--password 199712 \

--table staff \

--target-dir company \

--delete-target-dir \

--num-mappers 2 \

--split-by id \

--fields-terminated-by "\t"

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

运行成功:

在web端查看

// (2)查询导入sqoop_query

[bigdata@hadoop002 sqoop]$ bin/sqoop import \

--connect jdbc:mysql://hadoop002:3306/company \

--username root \

--password 199712 \

--target-dir company \

--delete-target-dir \

--num-mappers 2 \

--split-by id \

--fields-terminated-by "\t" \

--query 'select * from staff where $CONDITIONS'

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

提示:must contain '$CONDITIONS' in WHERE clause.

如果query后使用的是双引号,则$CONDITIONS前必须加转移符,防止shell识别为自己的变量。

//(3)部分导入

[bigdata@hadoop002 sqoop]$ bin/sqoop import \

--connect jdbc:mysql://hadoop002:3306/company \

--username root \

--password 199712 \

--table staff \

--columns id,name \

--where 'id>=10 and id<=20' \

--target-dir company \

--delete-target-dir \

--num-mappers 2 \

--split-by id \

--fields-terminated-by "\t"

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

提示:columns中如果涉及到多列,用逗号分隔,分隔时不要添加空格

查看web端并下载查看内容:

//(4)使用sqoop关键字筛选查询导入数据

[bigdata@hadoop002 sqoop]$ bin/sqoop import \

--connect jdbc:mysql://hadoop002:3306/company \

--username root \

--password 199712 \

--target-dir company \

--delete-target-dir \

--num-mappers 2 \

--fields-terminated-by "\t" \

--table staff \

--where "id=1"

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

2. RDBMS到Hive

$ bin/sqoop import \

--connect jdbc:mysql://hadoop002:3306/company \

--username root \

--password 199712 \

--hive-import \

--hive-overwrite \

--hive-table staff_hive \

--target-dir company \

--delete-target-dir \

--num-mappers 2 \

--split-by id \

--fields-terminated-by "\t" \

--query 'select * from staff where $CONDITIONS'

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

- 15

提示:该过程分为两步,第一步将数据导入到HDFS,第二步将导入到HDFS的数据迁移到Hive仓库,第一步默认的临时目录是/user/bigdata/表名

如果运行成功结果如图:

启动hive并查看是否成功

[bigdata@hadoop002 module]$ cd hive/

[bigdata@hadoop002 hive]$ bin/hive

hive> show tables;

// 查看数据

hive> select * from staff_hive;

- 1

- 2

- 3

- 4

- 5

- 6

3. RDBMS到Hbase

$ bin/sqoop import \

--connect jdbc:mysql://hadoop002:3306/company \

--username root \

--password 199712 \

--hbase-table staff_hbase \

--hbase-row-key "id" \

--column-family "info" \

--target-dir company \

--delete-target-dir \

--num-mappers 2 \

--split-by id \

--fields-terminated-by "\t" \

--query 'select * from staff where $CONDITIONS'

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

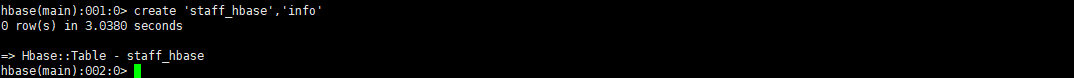

提示:sqoop1.4.6只支持HBase1.0.1之前的版本的自动创建HBase表的功能

解决方案:手动创建HBase表

hbase> create 'staff_hbase','info'

- 1

- 在HBase中scan这张表得到如下内容

hbase(main):001:0> scan 'staff_hbase'

- 1

二. 导出数据

在Sqoop中,“导出”概念指:从大数据集群(HDFS,HIVE,HBASE)向非大数据集群(RDBMS)中传输数据,叫做:导出,即使用export关键字。

HIVE/HDFS到RDBMS

- 1. 先登录mysql

[bigdata@hadoop002 hbase]$ mysql -uroot -p199712

mysql> use company;

mysql> show tables;

// 存在数据先把数据清空

mysql> truncate table staff;

- 1

- 2

- 3

- 4

- 5

- 6

- 2.运行脚本

$ bin/sqoop export \

--connect jdbc:mysql://hadoop002:3306/company \

--username root \

--password 199712 \

--table staff \

--num-mappers 2 \

--export-dir /user/hive/warehouse/staff_hive \

--input-fields-terminated-by "\t"

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

提示:Mysql中如果表不存在,不会自动创建

在Mysql中查看

三. 脚本打包

使用opt格式的文件打包sqoop命令,然后执行

- 1. 创建一个.opt文件

[bigdata@hadoop002 sqoop]$ vim opt.txt

- 1

- 2. 编写sqoop脚本

--connect

jdbc:mysql://hadoop002:3306/company

--username

root

--password

199712

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 3. 执行该脚本

[bigdata@hadoop002 sqoop]$ bin/sqoop list-databases --options-file opt.txt

- 1

本次的分享就到这里了,

好书不厌读百回,熟读课思子自知。而我想要成为全场最靓的仔,就必须坚持通过学习来获取更多知识,用知识改变命运,用博客见证成长,用行动证明我在努力。

如果我的博客对你有帮助、如果你喜欢我的博客内容,请“点赞” “评论”“收藏”一键三连哦!听说点赞的人运气不会太差,每一天都会元气满满呦!如果实在要白嫖的话,那祝你开心每一天,欢迎常来我博客看看。

码字不易,大家的支持就是我坚持下去的动力。点赞后不要忘了关注我哦!

文章来源: buwenbuhuo.blog.csdn.net,作者:不温卜火,版权归原作者所有,如需转载,请联系作者。

原文链接:buwenbuhuo.blog.csdn.net/article/details/106139286

- 点赞

- 收藏

- 关注作者

评论(0)